Que dites-vous ?

![]()

Tour d’horizon des mesures numériques envisagées par les différentes forces politiques.

Les candidatures ont été déposées à la préfecture, les professions de foi sont parties en impression… Ce lundi 17 juin s’ouvrent les deux semaines de campagne pure. Le premier tour des élections législatives, lui, est prévu pour le 30 juin prochain.

En matière de numériques, quelles mesures prévoient les principales forces politiques en présence ? Comme souvent, la moisson de mesures spécifiques au domaine est maigre. Si Ensemble promet d’investir, le Rassemblement National ne formule rien de spécifique, mais a pris position à plusieurs reprises en faveur de la souveraineté numérique. Quant au Nouveau Front Populaire (alliance des principaux partis de gauche), il déclare s’engager en faveur des libertés numériques, et chercher à « réindustrialiser » la France, notamment sur des sujets technologiques.

Le Rassemblement National promeut la souveraineté numérique

Le Rassemblement National n’a pas publié de programme précis. Cela dit, les mesures qu’il proposait en amont des présidentielles de 2022 et diverses prises de parole permettent de dessiner sa position sur divers sujets numériques.

Comme il y a deux ans, le parti d’extrême-droite propose de supprimer l’impôt sur la fortune immobilière (IFI) pour créer à la place un impôt sur la fortune financière (IFF). Si à l’échelle mondiale (ou, au minimum, états-unienne), la taxation des plus grandes fortunes toucherait bon nombre de fortunes de l’industrie numérique, c’est moins le cas en France.

Soulignons tout de même, parmi la liste des plus grandes fortunes de l’Hexagone, la présence de Xavier Niel, patron d’Iliad (Free), instigateur de l’École 42 et de Station F, de la Famille Dassault qui détient notamment des parts dans Thales, ou encore d’Olivier Pomel et Alexis Lê-Quôc, cofondateurs de Datadog.

Autre mesure proposée par le député RN De la Somme Jean-Philippe Tanguy : modifier le financement de La Poste pour le tirer d’une augmentation de la taxe GAFAM. Une proposition qui a pu être détournée pour laisser entendre que le RN souhaitait confier les services de La Poste au géant Amazon. Globalement, le Rassemblement national prône une forte régulation des géants numériques étrangers et une recherche de souveraineté numérique, y compris dans le domaine du cloud.

En amont des européennes, Jordan Bardella s’est, cela dit, exprimé sur un ton quasiment technophile, critiquant notamment d’éventuels excès de régulation en matière d’intelligence artificielle.

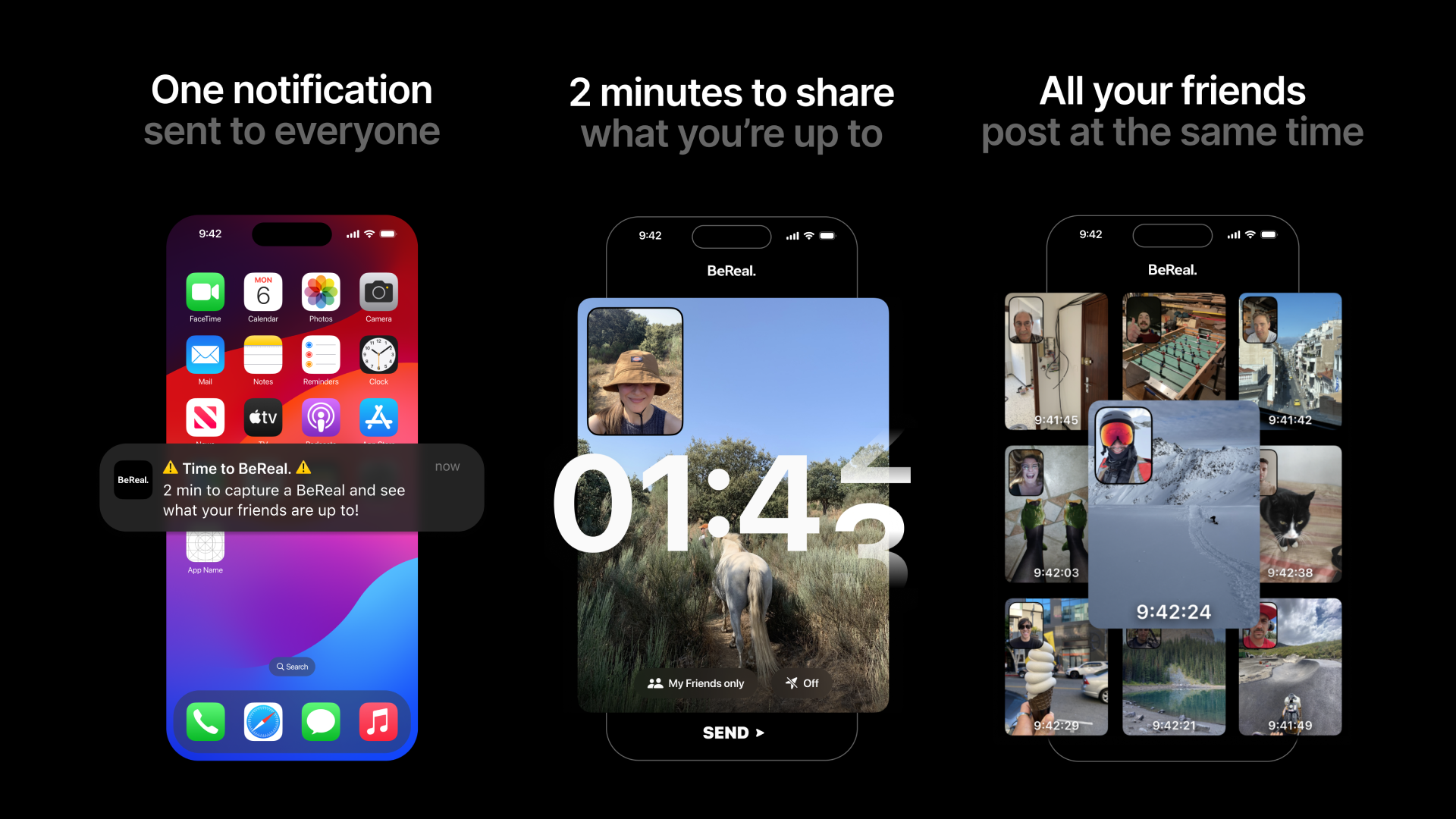

Ensemble promet d’investir

Sur son site, Ensemble ne donne pas beaucoup plus d’information que la promesse, pour « l’avenir », d’« investissements dans la recherche et les technologies ». Les détails du programme sont plus nombreux dans les pages du Parisien et des journaux régionaux auxquels s’est adressé le Premier ministre Gabriel Attal.

Au-delà des promesses d’une mutuelle « à un euro par jour », des exonérations de frais de notaires pour les primo-accédants et d‘une promesse de « sursaut d’autorité » pour faire face à l’« addiction à la violence » que présenteraient certains jeunes, aucun détail ne filtre, cela dit, sur d’éventuelles mesures numériques.

Les politiques passées, notamment en faveur de l’investissement dans l’intelligence artificielle, laissent néanmoins présager d’une poursuite des efforts dans le domaine.

Sur l’utilisation intensive des « écrans », Renaissance a une position plutôt ambivalente, reprenant à son compte le rapport de la Commission sur les écrans et les enfants tout en prônant des solutions numériques comme l’outil MIA pour l’aide scolaire et l’approfondissement des cours.

Le Nouveau Front Populaire met l’accent sur les libertés numériques et la réindustrialisation

Le Nouveau Front Populaire a, lui, rendu public un programme de 24 pages (.pdf) et 150 mesures. Dès le préambule, il indique lutter « contre la multiplication des discours de haine et contre la prolifération des menaces et des violences qui abîment notre démocratie ». Il traduit cet axe par l’engagement de sa majorité et de ses parlementaires « en refusant la diffusion de fausses informations, la calomnie, le cyberharcèlement, et les incitations à la haine », en ligne comme hors ligne.

Sur les questions de droits numériques, le Nouveau Front Populaire prévoir d’« interdire la reconnaissance faciale » et d’évaluer les dispositifs de vidéosurveillance « de manière indépendante », « en lien avec la défenseure des droits ».

Parmi les mesures que le Nouveau Front Populaire prévoit de déployer dans le temps long, la « réindustrialisation » est citée à plusieurs reprises, tant dans le contexte de mesures pour la France que des sujets européens. Le NFP prévoit d’« engager un plan de reconstruction industrielle pour mettre fin à la dépendance de la France et de l’Europe dans les domaines stratégiques », parmi lesquels celui des semi-conducteurs et ceux des technologies de pointes, des voitures électriques, des panneaux solaires, « etc ».

Comme le Rassemblement National, le Nouveau Front Populaire est très critique envers les traités de libre-échange, auxquels il propose de « mettre fin ». Sans plus de précision, difficile de savoir dans quelle mesure cet axe concernera les accords dédiés au commerce des services numériques.

Un expert cyber en candidat libre

Signalons enfin un « électron libre » dans les candidatures : Baptiste Robert, hacker éthique et spécialiste en cybersécurité. Il se présente dans la 3ᵉ circonscription de Haute-Garonne, sans aucune étiquette politique, un choix assumé et revendiqué.

Sa motivation tient en deux phrases : « Les parlementaires manquent souvent de compétences numériques. Ils ne sont qu’une poignée à maîtriser le sujet. Il est urgent de combler ce retard. Je veux prendre le lead sur la question numérique à l’Assemblée nationale ». Sa proposition politique prend la forme d’une courte vidéo.