Microsoft Employee Disrupts 50th Anniversary and Calls AI Boss 'War Profiteer'

Read more of this story at Slashdot.

Read more of this story at Slashdot.

Au mois de février, AMD officialisait la nouvelle définition de "GRE". Terminé le "Golden Rabbit Edition" et bienvenue au "Great Radeon Edition" plus facile à justifier alors que l'année du lapin est passée depuis un moment et ne reviendra que dans dix ans maintenant. Au passage, la firme annonçait...

Au mois de février, AMD officialisait la nouvelle définition de "GRE". Terminé le "Golden Rabbit Edition" et bienvenue au "Great Radeon Edition" plus facile à justifier alors que l'année du lapin est passée depuis un moment et ne reviendra que dans dix ans maintenant. Au passage, la firme annonçait...

Read more of this story at Slashdot.

Read more of this story at Slashdot.

L’agence américaine NOAA, qui a en charge notamment des données sur le climat et la météorologie, s’apprête à supprimer une quantité importante de sites internet via une simple annulation d’un contrat avec des hébergeurs cloud.

De nombreux sites de la NOAA, l’agence d’observation océanique et atmosphérique qui s’occupe aussi des données météorologiques aux États-Unis, vont sans doute devenir inaccessible dès ce week-end. En cause ? Un contrat de prestations d’hébergement dans divers cloud a été annulé par sa direction, selon Bloomberg.

Cette agence est, comme de nombreuses agences fédérales américaines et notamment les agences scientifiques, visée par le DOGE et l’administration de Donald Trump depuis son retour au pouvoir. Elle s’est déjà séparée de certains de ses locaux et par deux fois d’une partie de son personnel.

Elle semble aussi particulièrement visée pour son rôle extrêmement important dans l’information sur le climat et la météorologie. Bloomberg explique qu’un contrat signé pour l’ensemble du bureau de la recherche océanique et atmosphérique de l’agence a été visé pour une « résiliation anticipée », selon des documents internes que le média a pu consulter.

« En conséquence, la quasi-totalité des sites web externes dépendant des services d’Amazon, de Google et de WordPress sont sur le point de disparaître tôt samedi matin à Washington, effaçant ainsi de la vue du public l’essentiel du travail de l’unité, qui comprend la recherche en sciences du climat et de l’environnement », explique notre consœur Lauren Rosenthal. La NOAA n’a pas répondu à sa demande de commentaire.

Cette information fait mouche avec une alerte lancée sur le forum du projet Safeguarding Research & Culture. Celui-ci émane de la volonté de certains chercheurs, notamment l’historien allemand Henrik Schönemann de l’université de Humboldt à Berlin, de créer « une infrastructure alternative pour l’archivage et la diffusion du patrimoine culturel et des connaissances scientifiques ». L’alerte concerne une cinquantaine de sites de la NOAA et on y retrouve rien de moins que le site de l’agence dédié à la recherche : https://research.noaa.gov/.

« Ce qui est prévu d’être supprimé, ce sont les services basés sur AWS pour la NOAA », expliquent les chercheurs, évoquant une mise hors-ligne dès ce vendredi soir. Mais des questions se posent aussi sur les données ouvertes hébergées elles aussi sur AWS.

Selon une note interne obtenue par Bloomberg, la résiliation du contrat pourrait aussi affecter d’autres activités de recherche de l’agence : le laboratoire qui surveille les tempêtes « sévères » pour le pays (le National Severe Storms Laboratory) et celui chargé de l’innovation en climatologie (le Earth Prediction Innovation Center) utilisent des services de cloud computing externes pour un système de prévisions météorologiques à grande échelle.

Les chercheurs de l’agence ont d’autres raisons d’être préoccupés : deux autres contrats arrivent à leurs fins concernant le support de N-Wave, son réseau national qui « s’étend sur toute la zone contiguë des États-Unis jusqu’à l’Alaska et Hawaï, atteignant les sites de terrain éloignés, les grands campus, les centres de données et les installations de supercalculateurs ». Ils sont déjà sous le coup d’une extension très brève de cinq jours qui doit se terminer samedi pour l’un et lundi pour l’autre, selon Bloomberg.

L’agence américaine NOAA, qui a en charge notamment des données sur le climat et la météorologie, s’apprête à supprimer une quantité importante de sites internet via une simple annulation d’un contrat avec des hébergeurs cloud.

De nombreux sites de la NOAA, l’agence d’observation océanique et atmosphérique qui s’occupe aussi des données météorologiques aux États-Unis, vont sans doute devenir inaccessible dès ce week-end. En cause ? Un contrat de prestations d’hébergement dans divers cloud a été annulé par sa direction, selon Bloomberg.

Cette agence est, comme de nombreuses agences fédérales américaines et notamment les agences scientifiques, visée par le DOGE et l’administration de Donald Trump depuis son retour au pouvoir. Elle s’est déjà séparée de certains de ses locaux et par deux fois d’une partie de son personnel.

Elle semble aussi particulièrement visée pour son rôle extrêmement important dans l’information sur le climat et la météorologie. Bloomberg explique qu’un contrat signé pour l’ensemble du bureau de la recherche océanique et atmosphérique de l’agence a été visé pour une « résiliation anticipée », selon des documents internes que le média a pu consulter.

« En conséquence, la quasi-totalité des sites web externes dépendant des services d’Amazon, de Google et de WordPress sont sur le point de disparaître tôt samedi matin à Washington, effaçant ainsi de la vue du public l’essentiel du travail de l’unité, qui comprend la recherche en sciences du climat et de l’environnement », explique notre consœur Lauren Rosenthal. La NOAA n’a pas répondu à sa demande de commentaire.

Cette information fait mouche avec une alerte lancée sur le forum du projet Safeguarding Research & Culture. Celui-ci émane de la volonté de certains chercheurs, notamment l’historien allemand Henrik Schönemann de l’université de Humboldt à Berlin, de créer « une infrastructure alternative pour l’archivage et la diffusion du patrimoine culturel et des connaissances scientifiques ». L’alerte concerne une cinquantaine de sites de la NOAA et on y retrouve rien de moins que le site de l’agence dédié à la recherche : https://research.noaa.gov/.

« Ce qui est prévu d’être supprimé, ce sont les services basés sur AWS pour la NOAA », expliquent les chercheurs, évoquant une mise hors-ligne dès ce vendredi soir. Mais des questions se posent aussi sur les données ouvertes hébergées elles aussi sur AWS.

Selon une note interne obtenue par Bloomberg, la résiliation du contrat pourrait aussi affecter d’autres activités de recherche de l’agence : le laboratoire qui surveille les tempêtes « sévères » pour le pays (le National Severe Storms Laboratory) et celui chargé de l’innovation en climatologie (le Earth Prediction Innovation Center) utilisent des services de cloud computing externes pour un système de prévisions météorologiques à grande échelle.

Les chercheurs de l’agence ont d’autres raisons d’être préoccupés : deux autres contrats arrivent à leurs fins concernant le support de N-Wave, son réseau national qui « s’étend sur toute la zone contiguë des États-Unis jusqu’à l’Alaska et Hawaï, atteignant les sites de terrain éloignés, les grands campus, les centres de données et les installations de supercalculateurs ». Ils sont déjà sous le coup d’une extension très brève de cinq jours qui doit se terminer samedi pour l’un et lundi pour l’autre, selon Bloomberg.

Read more of this story at Slashdot.

Amazon a présenté hier soir une fonction nommée « Buy for me », destinée à simplifier encore un peu plus les achats. Contrairement à d’autres agents IA que l’on a pu voir jusqu’à présent, notamment chez Opera, il n’est pas question cette fois d’écrire une demande et de laisser l’intégralité du processus de découverte et d’achat à un agent.

Cette fonction, disponible en bêta pour un petit groupe de personnes aux États-Unis, a un périmètre nettement plus restreint. Comme l’indique Amazon dans son billet, « Buy for me » veut simplifier les achats pour des produits présentés par la boutique Amazon, mais disponibles depuis d’autres, notamment les sites officiels des entreprises concernées.

La fonction, présente dans les applications Android et iOS, s’affiche sous forme d’un bouton dédié, accompagnant certains résultats. S’il est actionné par l’internaute, il lance une procédure d’achat sur le site officiel du fabricant, de manière automatisée.

Mais si cette fonction est plus restreinte dans ses cas d’usage, elle demande une grande confiance en Amazon. Car contrairement à ce que l’on a déjà pu voir, c’est toute la procédure d’achat qui se retrouve gérée par l’agent, y compris le paiement. Ce qui suppose que l’IA accède aux informations de la carte bancaire. L’achat est considéré comme externe. « La livraison, les retours et les échanges, ainsi que le service client sont gérés par la boutique de la marque », précise Amazon.

Le géant du commerce en ligne précise dans son billet que ces opérations sont chiffrées et qu’il n’accède pas aux données des autres sites. Il affirme qu’il ne tient aucun historique de ces actions et qu’il s’agit simplement d’apporter une commodité. En outre, la présence de cette fonction sur des produits se fait à la demande des fabricants et Amazon assure que les clients peuvent observer toutes les étapes d’un processus décrit comme « transparent ». Le tout repose sur Amazon Bedrock et utilise le modèle Nova maison, ainsi que les modèles Claude d’Anthropic (dont la version 3.7 est sortie fin février), sans plus de précision.

« Gagner la confiance est la pierre angulaire du succès des agents d’IA », déclare Amazon dans son billet. À voir désormais si la clientèle se laissera séduire par un processus automatisé impliquant des informations bancaires. Ajoutons que ce n’est pas la première fois qu’Amazon tente ce type d’approche automatisée. En 2018, nous avions ainsi testé la commande de pizza via Alexa, avec des résultats particulièrement décevants.

Il n’y a pas que les datacenters qui façonnent le monde à cause de leur consommation électrique. La climatisation aussi est fortement consommatrice d’électricité… et cela ne va pas aller en s’arrangeant.

L’arrivée de l’IA générative a bousculé le numérique et soulève de nombreuses questions (droit d’auteur, éthique, biais, hallucinations…). Se pose aussi la question de l’empreinte écologique de datacenter toujours plus gros, partout dans le monde, avec des GPU toujours plus puissants.

Le tout avec une consommation électrique toujours plus importante, sur des zones bien précises. L’augmentation de la densité électrique par baie et l’expansion des datacenters posent d’ailleurs des contraintes sur le choix de l’emplacement physique alloué à ces derniers.

Avec les images et les vidéos de l’IA générative, on passe encore dans une autre dimension. Les chiffres de l’utilisation des IA peuvent donner le tournis, preuve en est encore récemment avec un tweet de Brad Lightcap (COO d’OpenAI) : « Première semaine de folie pour les images dans ChatGPT : plus de 130 millions d’utilisateurs ont généré plus de 700 millions (!) d’images ». Il se garde d’ailleurs bien de détailler l’empreinte environnementale d’une telle utilisation.

Dans un rapport publié fin 2024, l’Agence internationale de l’énergie atomique (IAEA, sous l’égide de l’ONU) expliquait que « les datacenters avaient consommé environ 460 TWh d’électricité en 2022. Cette consommation pourrait s’élever à plus de 1 000 TWh d’ici 2026, soit plus d’un tiers de l’électricité produite par les centrales nucléaires du monde entier l’année dernière, et à peu près l’équivalent de la consommation d’électricité du Japon ». À titre de comparaison, en 2023, la consommation d’électricité en France était de 445,4 TWh.

L’Agence donne quelques chiffres d’anticipation. En Chine, la demande devrait doubler pour atteindre 400 TWh en 2030. En Irlande, la consommation des datacenters (5,3 TWh) représentait 17 % du total du pays et devrait atteindre 32 % d’ici fin 2026. Elle ajoute au passage que la consommation cumulée d’Amazon, Microsoft, Google et Meta « a plus que doublé entre 2017 et 2021 pour s’établir à environ 72 térawattheures (TWh) ».

Par exemple, pour Meta, la consommation des datacenters était de 14,975 TWh en 2023, contre 6,966 TWh en 2020. Elle a donc quasiment doublé en trois ans.

Dans un article publié sur MIT Review, Casey Crownhart (journaliste spécialisée sur le climat et l’énergie) explique que l’on « devrait parler davantage de climatisation ». Elle met cette problématique (bien moins médiatisée) en balance avec la consommation des datacenters largement plus présente dans les débats. Avec ce sous-titre volontairement provocateur : « oubliez les datacenters, la climatisation est la véritable bête noire »

Elle commence par rappeler le cercle vicieux de la climatisation et du réchauffement climatique : « À mesure que les températures augmentent, le besoin en refroidissement augmente. De plus en plus de centrales électriques à combustibles fossiles sont alors mises en service pour répondre à cette demande, augmentant ainsi la température de la planète ».

Selon une étude publiée mi-2024 par l’organisation à but non lucratif Our World in Data (qui travaille en partenariat avec l’université d’Oxford), sur l’année 2022 « la climatisation représentait 7 % de l’électricité mondiale et 3 % des émissions de carbone ». Sur la base d’une consommation mondiale de 29 000 TWh en 2022, la climatisation représenterait un peu plus de 2 000 TWh. À mettre en face des 460 TWh des datacenters.

Selon une projection de l’Agence internationale de l’énergie (IEA, une organisation internationale fondée à l’OCDE), le nombre de climatiseurs devrait fortement augmenter dans les années à venir. De 2 milliards d’unités à la fin des années 2010, elle prévoit près de 3 milliards en 2030 et plus de 5 milliards en 2050. À ce moment-là, la consommation électrique pourrait grimper entre 3 500 et 5 000 TWh.

Comme le rappelle Le Monde, les évolutions sont variables selon les continents : « Le nombre de ménages africains équipés en climatisation n’a enregistré qu’une très faible hausse au cours des vingt dernières années, passant de 4 % à 6 % aujourd’hui. Dopée par la Chine, l’Asie a en revanche vu son taux d’équipement exploser de 19 % à 47 % sur la même période ». En Europe, la proportion de ménages équipés d’une climatisation pourrait doubler et atteindre 40 % (55 % en France) d’ici 2050.

Les climatiseurs, contrairement aux datacenters, ont tendance à s’allumer à peu près en même temps dans une zone. « Dans certaines régions des États-Unis, par exemple, les climatiseurs peuvent représenter plus de 70 % de la demande d’énergie résidentielle aux moments où le réseau est le plus sollicité », affirme Casey Crownhart. Les climatiseurs sont répartis un peu partout alors que les datacenters concentrent la consommation en certains points précis (nécessitant des lignes dédiées). Signalons aussi que certains datacenters ont recours à la climatisation.

Notre consœur termine quand même par une bonne nouvelle : « nous assistons à des innovations dans la technologie de refroidissement ». Elle explique que certains proposent par exemple un stockage de l’énergie pour se recharger lorsque l’énergie est disponible à bas coût, et de nouvelles technologies de refroidissement. Cela ne suffira certainement pas à combler la hausse prévue de la consommation de la climatisation.

Amazon a présenté hier soir une fonction nommée « Buy for me », destinée à simplifier encore un peu plus les achats. Contrairement à d’autres agents IA que l’on a pu voir jusqu’à présent, notamment chez Opera, il n’est pas question cette fois d’écrire une demande et de laisser l’intégralité du processus de découverte et d’achat à un agent.

Cette fonction, disponible en bêta pour un petit groupe de personnes aux États-Unis, a un périmètre nettement plus restreint. Comme l’indique Amazon dans son billet, « Buy for me » veut simplifier les achats pour des produits présentés par la boutique Amazon, mais disponibles depuis d’autres, notamment les sites officiels des entreprises concernées.

La fonction, présente dans les applications Android et iOS, s’affiche sous forme d’un bouton dédié, accompagnant certains résultats. S’il est actionné par l’internaute, il lance une procédure d’achat sur le site officiel du fabricant, de manière automatisée.

Mais si cette fonction est plus restreinte dans ses cas d’usage, elle demande une grande confiance en Amazon. Car contrairement à ce que l’on a déjà pu voir, c’est toute la procédure d’achat qui se retrouve gérée par l’agent, y compris le paiement. Ce qui suppose que l’IA accède aux informations de la carte bancaire. L’achat est considéré comme externe. « La livraison, les retours et les échanges, ainsi que le service client sont gérés par la boutique de la marque », précise Amazon.

Le géant du commerce en ligne précise dans son billet que ces opérations sont chiffrées et qu’il n’accède pas aux données des autres sites. Il affirme qu’il ne tient aucun historique de ces actions et qu’il s’agit simplement d’apporter une commodité. En outre, la présence de cette fonction sur des produits se fait à la demande des fabricants et Amazon assure que les clients peuvent observer toutes les étapes d’un processus décrit comme « transparent ». Le tout repose sur Amazon Bedrock et utilise le modèle Nova maison, ainsi que les modèles Claude d’Anthropic (dont la version 3.7 est sortie fin février), sans plus de précision.

« Gagner la confiance est la pierre angulaire du succès des agents d’IA », déclare Amazon dans son billet. À voir désormais si la clientèle se laissera séduire par un processus automatisé impliquant des informations bancaires. Ajoutons que ce n’est pas la première fois qu’Amazon tente ce type d’approche automatisée. En 2018, nous avions ainsi testé la commande de pizza via Alexa, avec des résultats particulièrement décevants.

Il n’y a pas que les datacenters qui façonnent le monde à cause de leur consommation électrique. La climatisation aussi est fortement consommatrice d’électricité… et cela ne va pas aller en s’arrangeant.

L’arrivée de l’IA générative a bousculé le numérique et soulève de nombreuses questions (droit d’auteur, éthique, biais, hallucinations…). Se pose aussi la question de l’empreinte écologique de datacenter toujours plus gros, partout dans le monde, avec des GPU toujours plus puissants.

Le tout avec une consommation électrique toujours plus importante, sur des zones bien précises. L’augmentation de la densité électrique par baie et l’expansion des datacenters posent d’ailleurs des contraintes sur le choix de l’emplacement physique alloué à ces derniers.

Avec les images et les vidéos de l’IA générative, on passe encore dans une autre dimension. Les chiffres de l’utilisation des IA peuvent donner le tournis, preuve en est encore récemment avec un tweet de Brad Lightcap (COO d’OpenAI) : « Première semaine de folie pour les images dans ChatGPT : plus de 130 millions d’utilisateurs ont généré plus de 700 millions (!) d’images ». Il se garde d’ailleurs bien de détailler l’empreinte environnementale d’une telle utilisation.

Dans un rapport publié fin 2024, l’Agence internationale de l’énergie atomique (IAEA, sous l’égide de l’ONU) expliquait que « les datacenters avaient consommé environ 460 TWh d’électricité en 2022. Cette consommation pourrait s’élever à plus de 1 000 TWh d’ici 2026, soit plus d’un tiers de l’électricité produite par les centrales nucléaires du monde entier l’année dernière, et à peu près l’équivalent de la consommation d’électricité du Japon ». À titre de comparaison, en 2023, la consommation d’électricité en France était de 445,4 TWh.

L’Agence donne quelques chiffres d’anticipation. En Chine, la demande devrait doubler pour atteindre 400 TWh en 2030. En Irlande, la consommation des datacenters (5,3 TWh) représentait 17 % du total du pays et devrait atteindre 32 % d’ici fin 2026. Elle ajoute au passage que la consommation cumulée d’Amazon, Microsoft, Google et Meta « a plus que doublé entre 2017 et 2021 pour s’établir à environ 72 térawattheures (TWh) ».

Par exemple, pour Meta, la consommation des datacenters était de 14,975 TWh en 2023, contre 6,966 TWh en 2020. Elle a donc quasiment doublé en trois ans.

Dans un article publié sur MIT Review, Casey Crownhart (journaliste spécialisée sur le climat et l’énergie) explique que l’on « devrait parler davantage de climatisation ». Elle met cette problématique (bien moins médiatisée) en balance avec la consommation des datacenters largement plus présente dans les débats. Avec ce sous-titre volontairement provocateur : « oubliez les datacenters, la climatisation est la véritable bête noire »

Elle commence par rappeler le cercle vicieux de la climatisation et du réchauffement climatique : « À mesure que les températures augmentent, le besoin en refroidissement augmente. De plus en plus de centrales électriques à combustibles fossiles sont alors mises en service pour répondre à cette demande, augmentant ainsi la température de la planète ».

Selon une étude publiée mi-2024 par l’organisation à but non lucratif Our World in Data (qui travaille en partenariat avec l’université d’Oxford), sur l’année 2022 « la climatisation représentait 7 % de l’électricité mondiale et 3 % des émissions de carbone ». Sur la base d’une consommation mondiale de 29 000 TWh en 2022, la climatisation représenterait un peu plus de 2 000 TWh. À mettre en face des 460 TWh des datacenters.

Selon une projection de l’Agence internationale de l’énergie (IEA, une organisation internationale fondée à l’OCDE), le nombre de climatiseurs devrait fortement augmenter dans les années à venir. De 2 milliards d’unités à la fin des années 2010, elle prévoit près de 3 milliards en 2030 et plus de 5 milliards en 2050. À ce moment-là, la consommation électrique pourrait grimper entre 3 500 et 5 000 TWh.

Comme le rappelle Le Monde, les évolutions sont variables selon les continents : « Le nombre de ménages africains équipés en climatisation n’a enregistré qu’une très faible hausse au cours des vingt dernières années, passant de 4 % à 6 % aujourd’hui. Dopée par la Chine, l’Asie a en revanche vu son taux d’équipement exploser de 19 % à 47 % sur la même période ». En Europe, la proportion de ménages équipés d’une climatisation pourrait doubler et atteindre 40 % (55 % en France) d’ici 2050.

Les climatiseurs, contrairement aux datacenters, ont tendance à s’allumer à peu près en même temps dans une zone. « Dans certaines régions des États-Unis, par exemple, les climatiseurs peuvent représenter plus de 70 % de la demande d’énergie résidentielle aux moments où le réseau est le plus sollicité », affirme Casey Crownhart. Les climatiseurs sont répartis un peu partout alors que les datacenters concentrent la consommation en certains points précis (nécessitant des lignes dédiées). Signalons aussi que certains datacenters ont recours à la climatisation.

Notre consœur termine quand même par une bonne nouvelle : « nous assistons à des innovations dans la technologie de refroidissement ». Elle explique que certains proposent par exemple un stockage de l’énergie pour se recharger lorsque l’énergie est disponible à bas coût, et de nouvelles technologies de refroidissement. Cela ne suffira certainement pas à combler la hausse prévue de la consommation de la climatisation.

Read more of this story at Slashdot.

Ces derniers temps, on parle beaucoup d’une initiative baptisée « EU OS ». Il s’agirait d’une distribution Linux développée par l’Union européenne pour ses propres besoins. EU OS n’est cependant pas un système existant, ni même un projet de l’Union.

EU OS est un nom générique, choisi à dessein par Robert Riemann, auteur de l’initiative. Ce physicien et informaticien travaille actuellement dans l’équipe du Contrôleur européen de la protection des données (CEPD), un organe indépendant établi par le Règlement général sur la protection des données (RGPD) pour veiller à son application cohérente au sein de l’Union. Riemann est en quelque sorte aux premières loges sur les questions de souveraineté numérique.

Son initiative est centrée sur ce thème. Elle est personnelle – dans le sens où elle n’émane pas officiellement d’une instance européenne – mais est conçue pour attirer l’attention. Elle est en outre suffisamment étoffée dans sa vision pour interroger les éventuelles bonnes volontés. Même si certains choix peuvent sembler curieux, voire bloquants.

EU OS est présenté comme un projet. L’auteur est cependant transparent sur les objectifs : c’est un proof-of-concept (démonstration de faisabilité) visant à explorer l’idée d’un système d’exploitation souverain pour les instances publiques de l’Union européenne. Comme Robert Riemann l’indique, EU OS « n’est techniquement pas un nouveau système d’exploitation »

Les motivations à lancer un tel projet ne manquent pas, selon lui. L’expression « argent public – code public » est au cœur de sa démarche. L’investissement public doit ainsi profiter au plus grand nombre, l’argent des contribuables ne devant pas servir à payer des licences de produits propriétaires. Il estime que les « effets de synergie » permettront des économies puisqu’il ne sera plus question de payer des coûts de licence par siège.

Il est également beaucoup question d’indépendance. D’abord, à l’égard des entreprises du privé, qui ne pourraient plus dicter leurs conditions. Ensuite sur la manière dont les migrations sont envisagées, sur le logiciel comme sur le matériel. Bien que le cas ne soit pas nommé, il est probable que la fin de vie de Windows 10 serve ici d’exemple emblématique du problème pointé. Un organisme public pourra ainsi choisir quand et comment migrer.

Bien sûr, l’ouverture du code est centrale, permettant à chacun de se lancer dans sa propre analyse. Même chose pour l’utilisation de normes ouvertes. L’initiative bénéficierait aussi de la communauté mondiale du logiciel libre.

Le site du projet rappelle que ce type d’initiative n’a rien de nouveau, même si l’aventure n’a encore jamais été tentée au niveau européen. La distribution française Gendbuntu, basée sur Ubuntu et utilisée par la gendarmerie française, est citée en exemple. D’autres sont citées, comme LiMux à Munich, mais dont l’aventure s’est terminée en 2017, quand la municipalité a décidé de revenir à Windows.+ 1 Linux est également dans la liste, distribution développée par le land allemand Schleswig-Holstein, de même qu’Astra Linux pour la Russie et Kylin pour la Chine. Pour l’auteur de l’initiative, c’est la preuve évidente qu’un déploiement de Linux à grande échelle n’a rien d’impossible.

Et pour l’Europe, que propose Robert Riemann ? Une base Fedora accompagnée de l’environnement KDE. Le choix a de quoi surprendre : quitte à viser la souveraineté et donc l’indépendance, pourquoi promouvoir une distribution qui, si elle est effectivement libre, est le laboratoire à ciel ouvert de Red Hat, une société américaine ?

Robert Riemann s’en explique dans une FAQ. De 2007 à 2024, il a lui-même utilisé openSUSE, distribution soutenue par SUSE, une société allemande. Il indique également s’être servi de Debian au département universitaire, et de Scientific Linux dans un département de recherche. Pour son utilisation personnelle, il s’est penché en 2024 sur openSUSE Kalpa, mais a finalement choisi une variante spécifique de Fedora : Kinoite.

Kinoite, dont nous avons déjà parlé, est un système Linux immuable. Il estime que cet aspect du système est essentiel dans le cadre d’une distribution publique, car elle permet une sécurité accrue et offre une plus grande fiabilité dans la gestion des mises à jour. Les images déployées peuvent être signées, avec possibilité de contrôler finement ce qui est installé et quand.

Le choix de Fedora tient compte d’un ensemble de paramètres, dont l’utilisation de rpm-ostree, un système hybride images/paquets. On le retrouve dans des distributions immuables basées sur Fedora comme les spins Atomic, CentOS Stream, Alma Linux et Rocky Linux. Robert Riemann dit également avoir reçu des conseils de la communauté, du CERN, de la Commission européenne, du centre allemand pour la souveraineté numérique ou encore d’openSUSE (qui en a d’ailleurs fait un billet de blog le 26 mars).

Ce billet est intéressant, car l’équipe y estime le projet EU OS comme « mature » par son approche et la liste des caractéristiques. Le choix de Fedora Kinoite est à la fois considéré comme argumenté et présentant des risques. Pour openSUSE, il serait plus judicieux de prendre tout de suite en compte des alternatives comme Aeon (GNOME) ou sa propre distribution Kalpa, qui poursuit les mêmes objectifs que Kinoite. Le critère commun ? L’immuabilité.

Sur le site d’EU OS, d’autres spécifications sont d’ailleurs données. Il faut pouvoir par exemple proposer des dossiers synchronisés, qu’ils soient partagés ou spécifiques à l’utilisateur. Une attention particulière doit être portée à la gestion des e-mails et calendriers. Ce peut être à travers le tandem KOrganizer-Kmail (donc KDE), Thunderbird ou un webmail comme OpenExchange.

Parmi les autres spécifications, il y a également l’intégration avec des services d’impression, une gestion des mots de passe avec intégration dans le navigateur, un outil de compression multiformat (7zip est proposé), la possibilité de déployer des applications depuis un catalogue (comme Flathub), une gestion centralisée des appareils (notamment pour le traitement des correctifs), une intégration avec un service d’annuaire, un déploiement automatique des certificats personnalisés, un système automatisé pour les sauvegardes, la prise en charge du chiffrement intégral du disque, la compatibilité avec SELinux, et ainsi de suite.

La liste est longue, d’autant qu’elle contient aussi des exigences non fonctionnelles. Elles concernent surtout la philosophie du projet, avec des conséquences concrètes sur la sécurité. Par exemple, le caractère open source du projet ou l’utilisation de méthodes DevOps modernes, « pour des constructions reproductibles ». Le système doit répondre aux besoins de l’Union européenne et doit pouvoir fonctionner sur du matériel datant de Windows 7.

Et, bien sûr, EU OS doit prendre en compte dès le départ l’ensemble des cadres juridiques européens pertinents et normes associées : RGPD, NIS 2, Cyber Resilience Act, ISO 27001. SecNumCloud, la certification de l’ANSSI, est même mentionnée, « si applicable ».

Il semble que l’ouverture du dépôt GitLab associé ait été faite aux alentours de Noël dernier. Pourquoi à ce moment-là ? Une question de contexte, sans doute, entre les dernières élections européennes et la pétition lancée en novembre dernier pour faire réagir les instances européennes.

Cette pétition, enregistrée sur le site du Parlement européen, enjoignait l’Europe à se doter de sa propre distribution souveraine. Les avantages d’une telle solution étaient considérés comme « évidents », comme l’indépendance, les économies réalisées, la transparence du processus, la sécurité associée, etc. Pour en finir avec la dépendance aux solutions propriétaires. Sujet relancé en France ces derniers temps, notamment avec le contrat signé par Polytechnique avec Microsoft.

Pour autant, comme nous le rappelait alors l’ingénieur Stéphane Bortzmeyer, la souveraineté par le système d’exploitation est un vieux sujet, sans que rien n’ait jamais vraiment bougé au niveau étatique. Et ce, malgré des réussites comme la migration de la gendarmerie française vers une version modifiée d’Ubuntu pour 70 000 postes.

L’initiative, cette fois, émane d’une personne clairement identifiée et ayant une expérience réelle avec le monde Linux. Le site donne de nombreux détails et pose une vision claire. Dans un contexte de guerre commerciale ouverte avec les États-Unis, déclenchée par le gouvernement américain via des droits de douane massifs, le projet est à suivre de près. Sinon, il aura eu le mérite de donner un aperçu plus précis de ce que devrait être une distribution européenne.

Ces derniers temps, on parle beaucoup d’une initiative baptisée « EU OS ». Il s’agirait d’une distribution Linux développée par l’Union européenne pour ses propres besoins. EU OS n’est cependant pas un système existant, ni même un projet de l’Union.

EU OS est un nom générique, choisi à dessein par Robert Riemann, auteur de l’initiative. Ce physicien et informaticien travaille actuellement dans l’équipe du Contrôleur européen de la protection des données (CEPD), un organe indépendant établi par le Règlement général sur la protection des données (RGPD) pour veiller à son application cohérente au sein de l’Union. Riemann est en quelque sorte aux premières loges sur les questions de souveraineté numérique.

Son initiative est centrée sur ce thème. Elle est personnelle – dans le sens où elle n’émane pas officiellement d’une instance européenne – mais est conçue pour attirer l’attention. Elle est en outre suffisamment étoffée dans sa vision pour interroger les éventuelles bonnes volontés. Même si certains choix peuvent sembler curieux, voire bloquants.

EU OS est présenté comme un projet. L’auteur est cependant transparent sur les objectifs : c’est un proof-of-concept (démonstration de faisabilité) visant à explorer l’idée d’un système d’exploitation souverain pour les instances publiques de l’Union européenne. Comme Robert Riemann l’indique, EU OS « n’est techniquement pas un nouveau système d’exploitation »

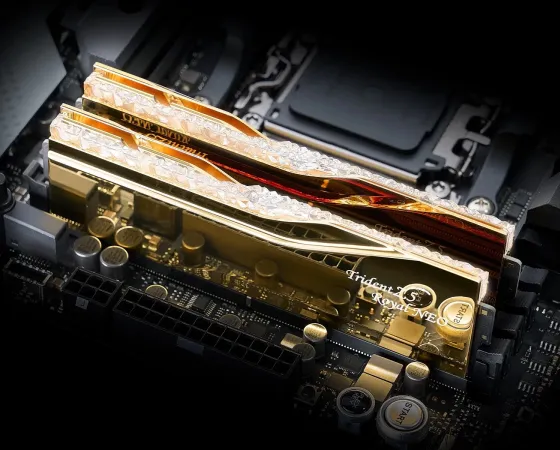

G.Skill vient de frapper un grand coup pour tous ceux qui veulent beaucoup de RAM DDR5 en un minimum de barrettes. Jusqu'à présent, il fallait compter sur des kits de 2 x 48 Go non binaires pour se gaver avec 2 barrettes, tandis que les kits de 128 Go étaient constitués de 4 barrettes de 32 Go pièce...

G.Skill vient de frapper un grand coup pour tous ceux qui veulent beaucoup de RAM DDR5 en un minimum de barrettes. Jusqu'à présent, il fallait compter sur des kits de 2 x 48 Go non binaires pour se gaver avec 2 barrettes, tandis que les kits de 128 Go étaient constitués de 4 barrettes de 32 Go pièce...

Read more of this story at Slashdot.