☕️ #Flock : Microslop Corporation

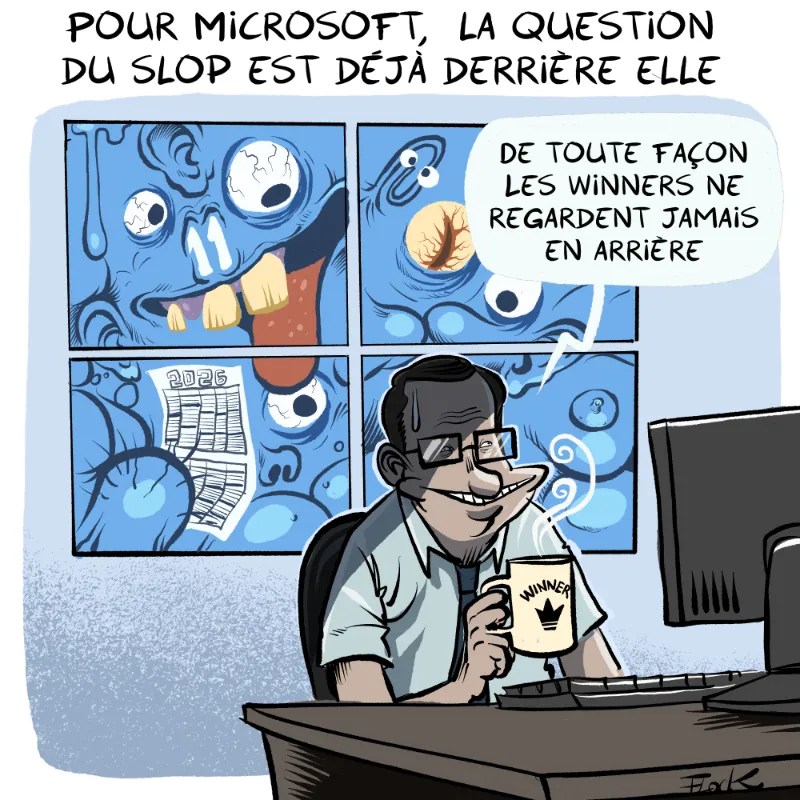

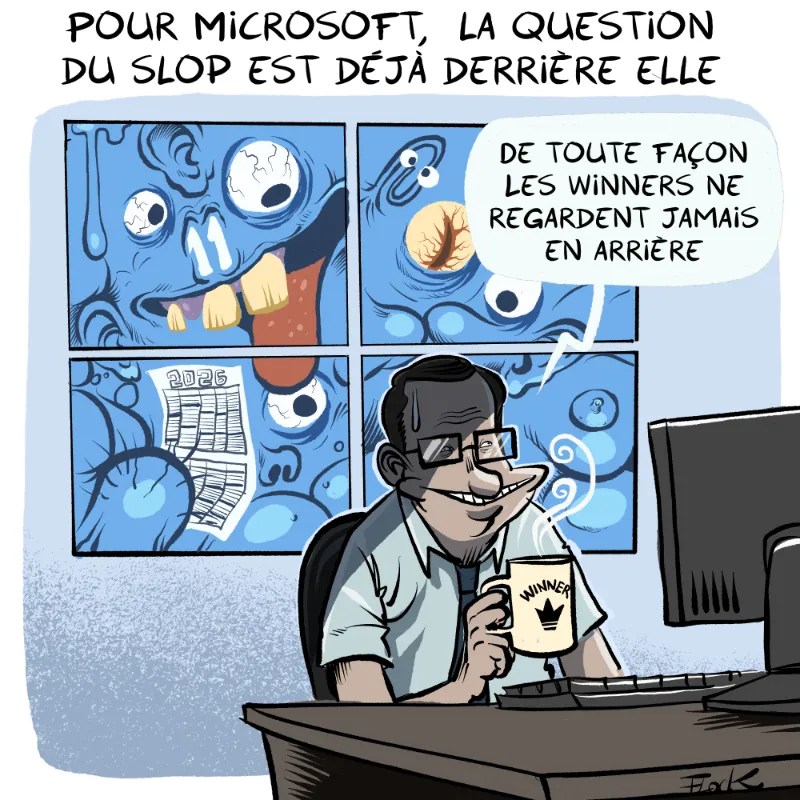

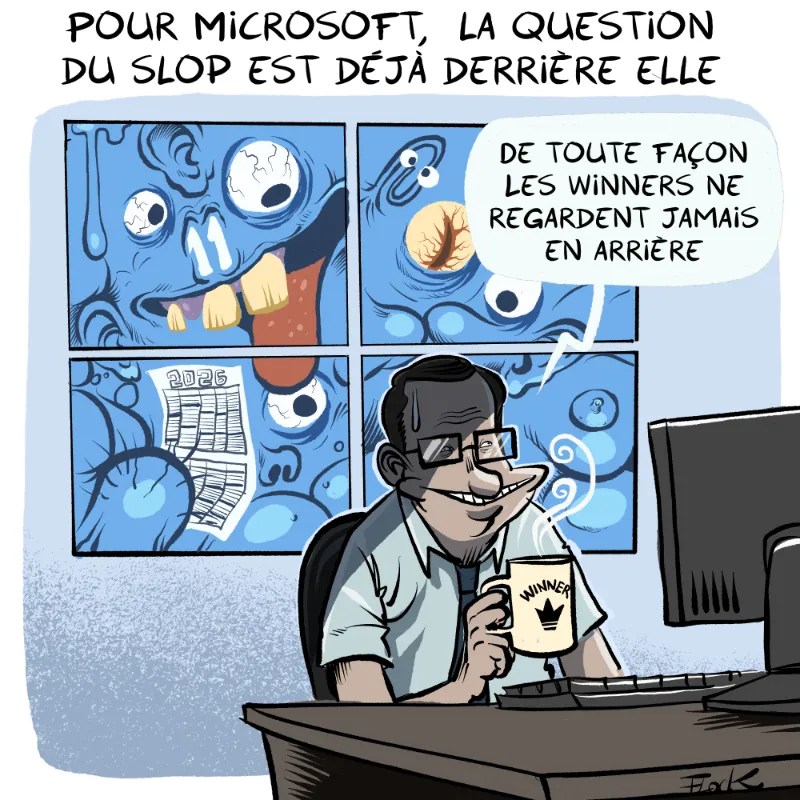

Au sujet de Windows, Microsoft est dans une bulle. À mon avis ce n’est pas du savon.

Au sujet de Windows, Microsoft est dans une bulle. À mon avis ce n’est pas du savon.

Par un mémorandum présidentiel signé par Donald Trump, les États-Unis se retirent d’une liste de 68 organisations, collaborations et traités internationaux dont le GIEC, la Freedom Online Coalition, le Global Counterterrorism Forum ou encore le Global Forum on Cyber Expertise.

Dans cette liste, 31 organisations appartiennent à l’ONU dont, par exemple, l’Université des Nations unies, le Centre du commerce international, l’Agence d’information sur l’énergie ou encore l’Institut des Nations unies pour la formation et la recherche.

Or ONU, y figurent aussi la Commission for Environmental Cooperation, l’European Centre of Excellence for Countering Hybrid Threats, l’Intergovernmental Forum on Mining, Minerals, Metals, and Sustainable Development ou l’Intergovernmental Panel on Climate Change.

Le mémorandum précise que « j’ai déterminé qu’il était contraire aux intérêts des États-Unis de rester membre, de participer ou d’apporter un soutien » à ces organisations.

Google et Character.AI ont trouvé de premiers accords dans diverses plaintes relatives à des suicides ou des blessures de mineurs après l’usage de robots conversationnels.

La start-up de création de chatbot Character.AI et Google ont conclu des accords avec plusieurs familles dont les enfants se sont blessés ou suicidés après des échanges avec leurs robots conversationnels.

En octobre 2024, Megan Garcia avait déposé une plainte contre Character.AI, accusant l’entreprise d’être responsable du suicide de son fils Sewell Setzer III, 14 ans au moment des faits. Ce dernier avait discuté longuement avec l’un des chatbots de l’entreprise avant de se donner la mort.

Megan Garcia accusait l’entreprise de ne pas avoir déployé les garde-fous nécessaires sur ses outils pour empêcher son fils de développer une relation intime et problématique avec les robots. Selon la plainte, les outils auraient notamment généré des textes à connotation sexuelle, et n’auraient pas formulé de réaction lorsque le garçon a commencé à évoquer des formes d’automutilation.

Ce 7 janvier, relève Business Insider, une nouvelle requête judiciaire indique que la famille Garcia, les fondateurs de Character.AI, Noam Shaker et Daniel de Freitas, et Google ont trouvé un accord. En 2024, Google avait embauché les deux fondateurs de Character.AI et signé un accord non exclusif d’accès aux technologies de la start-up.

Character.AI et Google ont par ailleurs conclu des accords dans au moins quatre autres affaires similaires, dans les États de New York, du Colorado et du Texas.

La plainte de la famille Garcia fait partie d’une série plus large déposée contre différents constructeurs de robots conversationnels, dont OpenAI ou Meta.

Le premier est notamment poursuivi depuis l’été 2025 par la famille Raine, dont le fils s’est suicidé à 16 ans, et par au moins six autres familles. La seconde est accusée d’avoir laissé ses agents conversationnels produire des conversations « sensuelles » avec des enfants, y compris de moins de 13 ans.

Ces multiplications de plaintes ont conduit la Federal Trade Commission (FTC) à ouvrir une enquête sur les conséquences générales que créent l’exposition de mineurs à des robots conversationnels.

Au sujet de Windows, Microsoft est dans une bulle. À mon avis ce n’est pas du savon.

Par un mémorandum présidentiel signé par Donald Trump, les États-Unis se retirent d’une liste de 68 organisations, collaborations et traités internationaux dont le GIEC, la Freedom Online Coalition, le Global Counterterrorism Forum ou encore le Global Forum on Cyber Expertise.

Dans cette liste, 31 organisations appartiennent à l’ONU dont, par exemple, l’Université des Nations unies, le Centre du commerce international, l’Agence d’information sur l’énergie ou encore l’Institut des Nations unies pour la formation et la recherche.

Or ONU, y figurent aussi la Commission for Environmental Cooperation, l’European Centre of Excellence for Countering Hybrid Threats, l’Intergovernmental Forum on Mining, Minerals, Metals, and Sustainable Development ou l’Intergovernmental Panel on Climate Change.

Le mémorandum précise que « j’ai déterminé qu’il était contraire aux intérêts des États-Unis de rester membre, de participer ou d’apporter un soutien » à ces organisations.

Google et Character.AI ont trouvé de premiers accords dans diverses plaintes relatives à des suicides ou des blessures de mineurs après l’usage de robots conversationnels.

La start-up de création de chatbot Character.AI et Google ont conclu des accords avec plusieurs familles dont les enfants se sont blessés ou suicidés après des échanges avec leurs robots conversationnels.

En octobre 2024, Megan Garcia avait déposé une plainte contre Character.AI, accusant l’entreprise d’être responsable du suicide de son fils Sewell Setzer III, 14 ans au moment des faits. Ce dernier avait discuté longuement avec l’un des chatbots de l’entreprise avant de se donner la mort.

Megan Garcia accusait l’entreprise de ne pas avoir déployé les garde-fous nécessaires sur ses outils pour empêcher son fils de développer une relation intime et problématique avec les robots. Selon la plainte, les outils auraient notamment généré des textes à connotation sexuelle, et n’auraient pas formulé de réaction lorsque le garçon a commencé à évoquer des formes d’automutilation.

Ce 7 janvier, relève Business Insider, une nouvelle requête judiciaire indique que la famille Garcia, les fondateurs de Character.AI, Noam Shaker et Daniel de Freitas, et Google ont trouvé un accord. En 2024, Google avait embauché les deux fondateurs de Character.AI et signé un accord non exclusif d’accès aux technologies de la start-up.

Character.AI et Google ont par ailleurs conclu des accords dans au moins quatre autres affaires similaires, dans les États de New York, du Colorado et du Texas.

La plainte de la famille Garcia fait partie d’une série plus large déposée contre différents constructeurs de robots conversationnels, dont OpenAI ou Meta.

Le premier est notamment poursuivi depuis l’été 2025 par la famille Raine, dont le fils s’est suicidé à 16 ans, et par au moins six autres familles. La seconde est accusée d’avoir laissé ses agents conversationnels produire des conversations « sensuelles » avec des enfants, y compris de moins de 13 ans.

Ces multiplications de plaintes ont conduit la Federal Trade Commission (FTC) à ouvrir une enquête sur les conséquences générales que créent l’exposition de mineurs à des robots conversationnels.

Read more of this story at Slashdot.

Le CES 2026 fut l'occasion pour MSI de refaire vivre sa gamme LIGHTNING, après sept années de jachère ! L'annonce a de quoi charmer, avec cette RTX 5090 32G LIGHTNING et son écran de 8 pouces ! Nous vous renvoyons au communiqué officiel du constructeur qui explicite les détails de ce nouveau composant, nous allons nous attarder sur le fait de vous dévoiler nos propres clichés et vous présenter certaines spécifications de cette carte, qui s'annonce comme une référence pour les overclockeurs en herbes ! La carte dispose de 40 phases d'alimentation, d'une plaque arrière en fibre de carbone, d'une plaque froide avant, totalement couvrante, en cuivre et d'un radiateur de 360 mm, à ailettes hybrides, recouvert de trois ventilateurs LIGHTNING, de 120 mm. MSI a développé un Bios XOC 2500W, réservé aux overclokeurs chevronnés, son activation désactive, automatiquement, la garantie constructeur. Enfin, deux modèles sont prévus au catalogue de MSI, la RTX 5090 32G LIGHTNING X et la RTX 5090 32G LIGHTNING Z. […]

Lire la suiteMicrosoft prévoyait depuis avril 2024 d’imposer graduellement une limite de 2 000 e-mails par jour et par personne dans les entreprises clientes d’Exchange Online. Un changement radical de l’External Recipient Rate, puisque la limite était alors fixée à 10 000. Microsoft justifiait la mesure par des abus constatés, l’éditeur expliquant que son service n’était pas conçu pour les envois de masse.

Ce changement devait initialement prendre effet au 1er janvier 2026. Comme le rappelle notamment Neowin, il avait été repoussé à avril pour les nouveaux clients et les comptes d’essais, et à octobre pour les comptes existants. Il n’en sera finalement rien.

Dans un billet de blog publié le 6 janvier, Microsoft explique avoir renoncé à ce changement « indéfiniment pour le moment ». La raison ? Les retours négatifs de la clientèle : « Les clients ont indiqué que cette limite pose d’importants défis opérationnels, surtout compte tenu des capacités limitées des offres d’envoi en masse disponibles aujourd’hui. Vos retours comptent, et nous nous engageons à trouver des solutions qui équilibrent sécurité et ergonomie sans provoquer de perturbations inutiles ».

Microsoft ajoute vouloir toujours combattre les abus du service, « comme le spam et les e-mails malveillants ». Elle aimerait également limiter les mésusages d’Exchange Online, dont les applications line-of-business (LOB) qui se servent du service pour les envois de masse. « Cependant, nous prévoyons de traiter ces problèmes de manière à moins perturber les flux de travail de votre entreprise. Cela signifie des approches plus intelligentes et adaptatives qui protègent le service tout en respectant vos besoins opérationnels », ajoute l’entreprise.

La limite reste donc de 10 000 e-mails envoyés par jour et par personne, en tout cas pour l’instant.

Discord travaille avec Goldman Sachs et JP Morgan Chase à une entrée en bourse prévue pour mars, d’après Bloomberg.

Populaire chez les adeptes de jeux vidéo et les programmeurs, la plateforme affirme compter plus de 200 millions d’utilisateurs mensuels dans le monde. En 2022, elle en comptait 7,6 millions en France.

Les discussions ne viennent toutefois pas de commencer : en mars 2025, Discord était déjà en discussion pour ce type d’opération.

Les actions du gouvernement fédéral en général et du ministère de l’efficacité gouvernementale (DOGE) en particulier avaient créé trop d’inquiétudes pour permettre une entrée en bourse dans les bonnes conditions.

En 2021, l’entreprise avait refusé d’être rachetée par Microsoft pour 10 milliards de dollars.

NVIDIA ne veut pas rester enfermée dans le matériel. L’entreprise a profité du CES pour dévoiler une toute nouvelle plateforme et plusieurs modèles IA ouverts pour permettre aux constructeurs automobiles de progresser vers la conduite autonome.

Tesla aurait-elle tout à coup un très sérieux concurrent ? Pas sûr, mais la société d’Elon Musk doit surveiller de près le développement de NVIDIA, dont les activités sur la conduite autonome se renforcent depuis une décennie maintenant et viennent de passer un nouveau cap.

Si la présentation de la plateforme Vera Rubin a largement concentré les attentions, la firme au caméléon avait une autre annonce majeure en réserve. Elle a ainsi officialisé une plateforme désormais complète pour aider à développer des véhicules autonomes. Contrairement à Tesla qui développe sa propre technologie à des fins d’intégration verticale, NVIDIA a choisi de se présenter en fournisseur d’un « cadre » de développement, permettant de gérer toutes les étapes de l’automatisation.

Revenons d’abord un instant sur Cosmos, une plateforme déjà présentée et conçue pour accélérer le développement de ce que NVIDIA nomme « l’IA physique » (véhicules autonomes, robots, agents d’analyse vidéo…). Elle comprend des modèles de fondation ouverts, un lot de garde-fous et des bibliothèques pour traiter les informations. En clair, Cosmos est dédié à l’entrainement des modèles.

Lors d’une présentation au CES, NVIDIA a fait la démonstration d’opérations réalisées par Cosmos : génération de vidéos « réalistes » depuis une seule image, synthèse de scénarios de conduite multi-caméras, modélisation d’environnements spécifiques, raisonnement « physique » et prédiction de trajectoires, etc. Pendant la présentation, ces opérations étaient réalisées à partir de la version 2 des modèles Cosmos.

Sur ce socle amélioré, NVIDIA vient greffer Alpamayo. Ce portefeuille est constitué de modèles d’intelligence artificielle de type vision-langage-action (VLA) allant au-delà de la simple perception. Selon Jensen Huang, « Alpamayo permet aux véhicules autonomes de réfléchir dans des situations rares, de naviguer en toute sécurité dans des environnements complexes, et d’expliquer leurs décisions de conduite. Non seulement il prend l’entrée des capteurs et active le volant, les freins et l’accélération, mais il réfléchit aussi à l’action qu’il va entreprendre ».

Alpamayo 1, le modèle principal, compte 10 milliards de paramètres. Il peut traiter la vidéo des caméras pour générer des trajectoires de conduite. Les ambitions de NVIDIA passent également par l’open source : les modèles sont ouverts et sont accompagnés d’un simulateur (AlpaSim) et d’une base comptant les données de plus de 1 700 heures de conduite. Le tout s’intègre dans la plateforme DRIVE Hyperion dédiée au développement de véhicules autonomes, avec la volonté affichée de faire progresser les véhicules vers le niveau 4 d’automatisation.

Le premier modèle Alpamayo est disponible sur Hugging Face, NVIDIA souhaitant que les développeurs s’en emparent pour le spécialiser ou le distiller.

Contrairement aux précédentes annonces de NVIDIA dans ce domaine, l’arrivée d’Alpamayo a été suivie immédiatement par la confirmation d’un premier véhicule pour le premier trimestre de cette année : une Mercedes-Benz CLA de 2025, basée sur la plateforme DRIVE et utilisant donc Alpamayo. Comme l’indique le communiqué de presse, il s’agit pour l’instant d’une conduite de niveau 2 +, à destination du marché américain uniquement. L’Europe et l’Asie doivent suivre plus tard dans l’année, sans autre précision pour l’instant.

Cette voiture, qui s’inscrit dans le cadre d’un partenariat entre les deux entreprises depuis 2020, proposera des fonctions comme « la navigation urbaine point à point dans des environnements urbains complexes, une sécurité active avancée avec prévention proactive des collisions et un stationnement automatisé dans les espaces exigus ».

Rien de révolutionnaire dans l’absolu, mais il s’agira du premier véhicule à tirer réellement partie de toute la pile DRIVE : Cosmos pour l’entrainement, Omniverse pour les bibliothèques et microservices, Alpamayo pour la conduite elle-même et Halos pour la sécurité. La présentation était assortie d’une démonstration de 45 minutes où l’on pouvait notamment voir la Mercedes se glisser dans une circulation dense à San Francisco

Les ambitions de NVIDIA dans ce domaine sont très claires : « Notre vision est qu’un jour, chaque voiture, chaque camion sera autonome, et nous travaillons à cet avenir », a déclaré Jensen Huang, CEO de la société. L’expertise dont elle se dote à toute allure se répand également dans les usines de production et les robots, avec des partenaires comme Synopsys, Cadence, Boston Dynamics et Franka.

NVIDIA n’a donc clairement pas l’intention de se laisser enfermer dans le domaine du matériel, qui commence déjà à montrer des signes de tensions importantes avec les problèmes d’approvisionnement en mémoire. La société jouit déjà depuis longtemps d’une pile logicielle en expansion constante pour exploiter la puissance de ses GPU dans de multiples domaines. Elle avait commencé avec CUDA et a récupéré la première place dans la course folle à l’IA, voyant au passage sa capitalisation boursière exploser.

L’arrivée d’un tel acteur dans le domaine de la conduite autonome pourrait donc entrainer un bouleversement dans l’industrie automobile, d’autant que l’arrivée de la Mercedes-Benz CLA modifiée vient poser du concret sur la table. Plusieurs autres véhicules sont prévus, en provenance de Toyota, Volvo, Lotus ou encore Rivian, tous basés sur la plateforme DRIVE.

NVIDIA, dans ses communications, n’évoque jamais directement Tesla, mais il suffit d’avoir vu la vidéo consacrée à Cosmos pour comprendre la référence : « Collecter des données entrainées sur le monde réel est un processus lent et couteux, et ce n’est jamais assez. La réponse ? Les données synthétiques ». Jensen Huang a cependant été interrogé sur cette comparaison par Bloomberg. Le CEO estime que la pile logicielle de Tesla est actuellement « la plus avancée au monde » et que les approches des deux entreprises sont « assez similaires ». Ne voulant manifestement pas développer plus loin le sujet, Huang a simplement ajouté qu’il « encourageait » Tesla à continuer.

La comparaison avec Tesla est inévitable. Est-ce pour autant un concurrent direct ? Pas vraiment. Tesla est assise sur une base immense de données de conduite issues directement de l’utilisation de ses véhicules. Une base qui continue de grandir, permettant d’affiner sa fonction de conduite supervisée FSD (Full Self-Driving). Tesla ne licencie pas sa technologie, qui n’existe que sur ses propres véhicules. NVIDIA part au contraire d’une technologie plus ouverte et de données synthétiques, que les constructeurs sont libres d’intégrer.

Avec cette approche, NVIDIA veut se tailler une place de choix. Fournir gratuitement les modèles et le simulateur permet une adoption rapide, ainsi que le prototypage de nouvelles solutions. NVIDIA cherche tout simplement à reproduire le grand succès de CUDA, car une fois les solutions prêtes, c’est bien son matériel qui doit être utilisé pour les faire fonctionner. Et NVIDIA vend bien sûr des kits de développement Drive AGX (Thor et Orin), le même système qui peut ensuite être intégré aux véhicules pour s’occuper des calculs. Et pour entrainer les modèles ? Il faut des systèmes DGX, contenant les fameuses puces dédiées à l’IA et dont le couple Vera Rubin est la prochaine incarnation.

NVIDIA n’est cependant pas la seule entreprise à proposer ce type de vision intégrée. Qualcomm est également sur la rampe depuis des années avec son Digital Chassis, notamment renforcé en 2023 en direction des deux roues. La société s’intéresse également depuis longtemps aux communications entre les véhicules et l’infrastructure. Et le CES a également été l’occasion de plusieurs annonces autour de « l’IA physique ».

Microsoft prévoyait depuis avril 2024 d’imposer graduellement une limite de 2 000 e-mails par jour et par personne dans les entreprises clientes d’Exchange Online. Un changement radical de l’External Recipient Rate, puisque la limite était alors fixée à 10 000. Microsoft justifiait la mesure par des abus constatés, l’éditeur expliquant que son service n’était pas conçu pour les envois de masse.

Ce changement devait initialement prendre effet au 1er janvier 2026. Comme le rappelle notamment Neowin, il avait été repoussé à avril pour les nouveaux clients et les comptes d’essais, et à octobre pour les comptes existants. Il n’en sera finalement rien.

Dans un billet de blog publié le 6 janvier, Microsoft explique avoir renoncé à ce changement « indéfiniment pour le moment ». La raison ? Les retours négatifs de la clientèle : « Les clients ont indiqué que cette limite pose d’importants défis opérationnels, surtout compte tenu des capacités limitées des offres d’envoi en masse disponibles aujourd’hui. Vos retours comptent, et nous nous engageons à trouver des solutions qui équilibrent sécurité et ergonomie sans provoquer de perturbations inutiles ».

Microsoft ajoute vouloir toujours combattre les abus du service, « comme le spam et les e-mails malveillants ». Elle aimerait également limiter les mésusages d’Exchange Online, dont les applications line-of-business (LOB) qui se servent du service pour les envois de masse. « Cependant, nous prévoyons de traiter ces problèmes de manière à moins perturber les flux de travail de votre entreprise. Cela signifie des approches plus intelligentes et adaptatives qui protègent le service tout en respectant vos besoins opérationnels », ajoute l’entreprise.

La limite reste donc de 10 000 e-mails envoyés par jour et par personne, en tout cas pour l’instant.

Discord travaille avec Goldman Sachs et JP Morgan Chase à une entrée en bourse prévue pour mars, d’après Bloomberg.

Populaire chez les adeptes de jeux vidéo et les programmeurs, la plateforme affirme compter plus de 200 millions d’utilisateurs mensuels dans le monde. En 2022, elle en comptait 7,6 millions en France.

Les discussions ne viennent toutefois pas de commencer : en mars 2025, Discord était déjà en discussion pour ce type d’opération.

Les actions du gouvernement fédéral en général et du ministère de l’efficacité gouvernementale (DOGE) en particulier avaient créé trop d’inquiétudes pour permettre une entrée en bourse dans les bonnes conditions.

En 2021, l’entreprise avait refusé d’être rachetée par Microsoft pour 10 milliards de dollars.

NVIDIA ne veut pas rester enfermée dans le matériel. L’entreprise a profité du CES pour dévoiler une toute nouvelle plateforme et plusieurs modèles IA ouverts pour permettre aux constructeurs automobiles de progresser vers la conduite autonome.

Tesla aurait-elle tout à coup un très sérieux concurrent ? Pas sûr, mais la société d’Elon Musk doit surveiller de près le développement de NVIDIA, dont les activités sur la conduite autonome se renforcent depuis une décennie maintenant et viennent de passer un nouveau cap.

Si la présentation de la plateforme Vera Rubin a largement concentré les attentions, la firme au caméléon avait une autre annonce majeure en réserve. Elle a ainsi officialisé une plateforme désormais complète pour aider à développer des véhicules autonomes. Contrairement à Tesla qui développe sa propre technologie à des fins d’intégration verticale, NVIDIA a choisi de se présenter en fournisseur d’un « cadre » de développement, permettant de gérer toutes les étapes de l’automatisation.

Revenons d’abord un instant sur Cosmos, une plateforme déjà présentée et conçue pour accélérer le développement de ce que NVIDIA nomme « l’IA physique » (véhicules autonomes, robots, agents d’analyse vidéo…). Elle comprend des modèles de fondation ouverts, un lot de garde-fous et des bibliothèques pour traiter les informations. En clair, Cosmos est dédié à l’entrainement des modèles.

Lors d’une présentation au CES, NVIDIA a fait la démonstration d’opérations réalisées par Cosmos : génération de vidéos « réalistes » depuis une seule image, synthèse de scénarios de conduite multi-caméras, modélisation d’environnements spécifiques, raisonnement « physique » et prédiction de trajectoires, etc. Pendant la présentation, ces opérations étaient réalisées à partir de la version 2 des modèles Cosmos.

Sur ce socle amélioré, NVIDIA vient greffer Alpamayo. Ce portefeuille est constitué de modèles d’intelligence artificielle de type vision-langage-action (VLA) allant au-delà de la simple perception. Selon Jensen Huang, « Alpamayo permet aux véhicules autonomes de réfléchir dans des situations rares, de naviguer en toute sécurité dans des environnements complexes, et d’expliquer leurs décisions de conduite. Non seulement il prend l’entrée des capteurs et active le volant, les freins et l’accélération, mais il réfléchit aussi à l’action qu’il va entreprendre ».

Alpamayo 1, le modèle principal, compte 10 milliards de paramètres. Il peut traiter la vidéo des caméras pour générer des trajectoires de conduite. Les ambitions de NVIDIA passent également par l’open source : les modèles sont ouverts et sont accompagnés d’un simulateur (AlpaSim) et d’une base comptant les données de plus de 1 700 heures de conduite. Le tout s’intègre dans la plateforme DRIVE Hyperion dédiée au développement de véhicules autonomes, avec la volonté affichée de faire progresser les véhicules vers le niveau 4 d’automatisation.

Le premier modèle Alpamayo est disponible sur Hugging Face, NVIDIA souhaitant que les développeurs s’en emparent pour le spécialiser ou le distiller.

Contrairement aux précédentes annonces de NVIDIA dans ce domaine, l’arrivée d’Alpamayo a été suivie immédiatement par la confirmation d’un premier véhicule pour le premier trimestre de cette année : une Mercedes-Benz CLA de 2025, basée sur la plateforme DRIVE et utilisant donc Alpamayo. Comme l’indique le communiqué de presse, il s’agit pour l’instant d’une conduite de niveau 2 +, à destination du marché américain uniquement. L’Europe et l’Asie doivent suivre plus tard dans l’année, sans autre précision pour l’instant.

Cette voiture, qui s’inscrit dans le cadre d’un partenariat entre les deux entreprises depuis 2020, proposera des fonctions comme « la navigation urbaine point à point dans des environnements urbains complexes, une sécurité active avancée avec prévention proactive des collisions et un stationnement automatisé dans les espaces exigus ».

Rien de révolutionnaire dans l’absolu, mais il s’agira du premier véhicule à tirer réellement partie de toute la pile DRIVE : Cosmos pour l’entrainement, Omniverse pour les bibliothèques et microservices, Alpamayo pour la conduite elle-même et Halos pour la sécurité. La présentation était assortie d’une démonstration de 45 minutes où l’on pouvait notamment voir la Mercedes se glisser dans une circulation dense à San Francisco

Les ambitions de NVIDIA dans ce domaine sont très claires : « Notre vision est qu’un jour, chaque voiture, chaque camion sera autonome, et nous travaillons à cet avenir », a déclaré Jensen Huang, CEO de la société. L’expertise dont elle se dote à toute allure se répand également dans les usines de production et les robots, avec des partenaires comme Synopsys, Cadence, Boston Dynamics et Franka.

NVIDIA n’a donc clairement pas l’intention de se laisser enfermer dans le domaine du matériel, qui commence déjà à montrer des signes de tensions importantes avec les problèmes d’approvisionnement en mémoire. La société jouit déjà depuis longtemps d’une pile logicielle en expansion constante pour exploiter la puissance de ses GPU dans de multiples domaines. Elle avait commencé avec CUDA et a récupéré la première place dans la course folle à l’IA, voyant au passage sa capitalisation boursière exploser.

L’arrivée d’un tel acteur dans le domaine de la conduite autonome pourrait donc entrainer un bouleversement dans l’industrie automobile, d’autant que l’arrivée de la Mercedes-Benz CLA modifiée vient poser du concret sur la table. Plusieurs autres véhicules sont prévus, en provenance de Toyota, Volvo, Lotus ou encore Rivian, tous basés sur la plateforme DRIVE.

NVIDIA, dans ses communications, n’évoque jamais directement Tesla, mais il suffit d’avoir vu la vidéo consacrée à Cosmos pour comprendre la référence : « Collecter des données entrainées sur le monde réel est un processus lent et couteux, et ce n’est jamais assez. La réponse ? Les données synthétiques ». Jensen Huang a cependant été interrogé sur cette comparaison par Bloomberg. Le CEO estime que la pile logicielle de Tesla est actuellement « la plus avancée au monde » et que les approches des deux entreprises sont « assez similaires ». Ne voulant manifestement pas développer plus loin le sujet, Huang a simplement ajouté qu’il « encourageait » Tesla à continuer.

La comparaison avec Tesla est inévitable. Est-ce pour autant un concurrent direct ? Pas vraiment. Tesla est assise sur une base immense de données de conduite issues directement de l’utilisation de ses véhicules. Une base qui continue de grandir, permettant d’affiner sa fonction de conduite supervisée FSD (Full Self-Driving). Tesla ne licencie pas sa technologie, qui n’existe que sur ses propres véhicules. NVIDIA part au contraire d’une technologie plus ouverte et de données synthétiques, que les constructeurs sont libres d’intégrer.

Avec cette approche, NVIDIA veut se tailler une place de choix. Fournir gratuitement les modèles et le simulateur permet une adoption rapide, ainsi que le prototypage de nouvelles solutions. NVIDIA cherche tout simplement à reproduire le grand succès de CUDA, car une fois les solutions prêtes, c’est bien son matériel qui doit être utilisé pour les faire fonctionner. Et NVIDIA vend bien sûr des kits de développement Drive AGX (Thor et Orin), le même système qui peut ensuite être intégré aux véhicules pour s’occuper des calculs. Et pour entrainer les modèles ? Il faut des systèmes DGX, contenant les fameuses puces dédiées à l’IA et dont le couple Vera Rubin est la prochaine incarnation.

NVIDIA n’est cependant pas la seule entreprise à proposer ce type de vision intégrée. Qualcomm est également sur la rampe depuis des années avec son Digital Chassis, notamment renforcé en 2023 en direction des deux roues. La société s’intéresse également depuis longtemps aux communications entre les véhicules et l’infrastructure. Et le CES a également été l’occasion de plusieurs annonces autour de « l’IA physique ».

GIGABYTE nous avait réservé une sacrée surprise pour le CES 2026, une énorme AORUS GeForce RTX 5090 INFINITY ! Le constructeur a réussi l'exploit d'échapper aux leaks, ce qui lui a permis de présenter son imposant nouveau composant à Vegas, outre ses dimensions conséquentes et son look improbable, la carte graphique se base sur le PCB, en pièces, de la RTX 5090 Founders Edition. Le système de refroidissement WINDFORCE HYPERBURST est composé de deux ventilateurs (Hawk), qui sont cerclés de leds aRGB et une large découpe dans la bakplate est prévue à l'arrière de chacun d'eux, visuellement, nous avons l'impression d'être confronté à deux turbines. La carte mesure 330 x 145 x 65 mm, a besoin d'un unique connecteur 12 VHPWR, propose des sorties vidéo DisplayPort 2.1b (x3) et HDMI 2.1b (x1). Le composant bénéficie d'une garantie de quatre ans, les derniers détails, tels que le prix, le boost et la date de disponibilité ne sont pas connus. […]

Lire la suite

ASUS nous propose, pour ce CES 2026, des produits à la sauce KOJIMA. Laptop, casque, souris ou encore tapis de souris, on ne peut pas le nier, cette coproduction est juste superbe et peut être encore plus pour ceux qui sont fans du studio. […]

Lire la suiteVoilà une idée qui mériterait sans doute de faire des émules : Bose, qui avait annoncé en octobre dernier la fin du support technique et des services connectés associés aux enceintes de la gamme SoundTouch, vient d’offrir une alternative aux consommateurs concernés.

Le fabricant a en effet mis à jour, mercredi 7 janvier, la note d’information dédiée, pour signaler la mise à disposition de la documentation relative à l’API SoundTouch. « Nous rendons nos spécifications techniques disponibles afin que les développeurs indépendants puissent créer leurs propres outils et fonctionnalités compatibles avec SoundTouch ».

Les conditions d’utilisation de l’API en question (documentation en PDF) ont elles aussi été mises à jour en date du 7 janvier, pour refléter cette nouvelle permissivité.

Bose annonce par ailleurs que la date de fin programmée des services cloud opérés par ses soins sur les produits SoundTouch, initialement fixée au 18 février 2026, était désormais reportée au 6 mai 2026.

Après le 6 mai, les enceintes concernées ne recevront donc plus aucune mise à jour (notamment de sécurité). Ces dernières resteront cependant fonctionnelles sur un réseau local, lorsqu’elles sont alimentées par une application ou un service de musique exécuté depuis un autre appareil. En revanche, le pilotage centralisé des services musicaux depuis l’application Bose ne sera plus possible… à moins donc que de nouveaux clients non officiels prennent le relais, en vertu de l’API rendue disponible.

« Les systèmes SoundTouch par Bose ont été lancés en 2013. Depuis, la technologie a évolué et nous ne sommes plus en mesure de continuer le développement et l’assistance de l’infrastructure du cloud qui supporte cette ancienne génération de produits. Nous nous engageons toujours vers la création de nouvelles expériences sonores pour nos clients en nous appuyant sur des technologies modernes », justifie le constructeur.

Google n’en finit pas de revoir sa gestion d’Android Open Source Project (alias AOSP). C’est la version open source (sous licence Apache 2.0) du système d’exploitation mobile utilisée par des fabricants et développeurs de ROM alternatives, comme LineageOS.

Google indique à Android Authority que la publication du code source se fera désormais deux fois par an, « au deuxième et au quatrième trimestre de chaque année ». Cela correspond au rythme de déploiement d’Android, avec une version majeure au deuxième trimestre et une mineure au quatrième.

Jusqu’à présent, la version AOSP était publiée « dans les jours suivant le déploiement de la mise à jour correspondante sur ses propres appareils mobiles Pixel », rappellent nos confrères. Désormais, Google va se garder une longueur d’avance.

L’annonce est confirmée sur cette page, avec un message pour les développeurs : « À partir de 2026, pour nous aligner sur notre modèle de développement stable et garantir la stabilité de la plate-forme pour l’écosystème, nous publierons le code source sur AOSP au deuxième et au quatrième trimestre. Pour créer et contribuer à AOSP, nous vous recommandons d’utiliser android-latest-release au lieu de aosp-main. La branche de fichier manifeste android-latest-release fera toujours référence à la version la plus récente envoyée à AOSP ».

Google précise à nos confrères que cela ne devrait rien changer pour les correctifs liés à la sécurité : « l’entreprise continuerait à publier chaque mois des correctifs de sécurité sur une branche dédiée uniquement à la sécurité pour les versions pertinentes du système d’exploitation, tout comme elle le fait aujourd’hui », affirme Android Authority. Pourtant, ce fonctionnement aussi a changé il y a quelques mois, au grand dam de LineageOS.

Il y a un peu moins d’un an, Google annonçait que le développement d’Android passait uniquement en interne, avec une conséquence visible : la version publique d’Android est toujours en retard sur la version interne. Google bascule de plus en plus dans un modèle où ses smartphones seront en avance sur les autres niveau logiciel.

Voilà une idée qui mériterait sans doute de faire des émules : Bose, qui avait annoncé en octobre dernier la fin du support technique et des services connectés associés aux enceintes de la gamme SoundTouch, vient d’offrir une alternative aux consommateurs concernés.

Le fabricant a en effet mis à jour, mercredi 7 janvier, la note d’information dédiée, pour signaler la mise à disposition de la documentation relative à l’API SoundTouch. « Nous rendons nos spécifications techniques disponibles afin que les développeurs indépendants puissent créer leurs propres outils et fonctionnalités compatibles avec SoundTouch ».

Les conditions d’utilisation de l’API en question (documentation en PDF) ont elles aussi été mises à jour en date du 7 janvier, pour refléter cette nouvelle permissivité.

Bose annonce par ailleurs que la date de fin programmée des services cloud opérés par ses soins sur les produits SoundTouch, initialement fixée au 18 février 2026, était désormais reportée au 6 mai 2026.

Après le 6 mai, les enceintes concernées ne recevront donc plus aucune mise à jour (notamment de sécurité). Ces dernières resteront cependant fonctionnelles sur un réseau local, lorsqu’elles sont alimentées par une application ou un service de musique exécuté depuis un autre appareil. En revanche, le pilotage centralisé des services musicaux depuis l’application Bose ne sera plus possible… à moins donc que de nouveaux clients non officiels prennent le relais, en vertu de l’API rendue disponible.

« Les systèmes SoundTouch par Bose ont été lancés en 2013. Depuis, la technologie a évolué et nous ne sommes plus en mesure de continuer le développement et l’assistance de l’infrastructure du cloud qui supporte cette ancienne génération de produits. Nous nous engageons toujours vers la création de nouvelles expériences sonores pour nos clients en nous appuyant sur des technologies modernes », justifie le constructeur.

Google n’en finit pas de revoir sa gestion d’Android Open Source Project (alias AOSP). C’est la version open source (sous licence Apache 2.0) du système d’exploitation mobile utilisée par des fabricants et développeurs de ROM alternatives, comme LineageOS.

Google indique à Android Authority que la publication du code source se fera désormais deux fois par an, « au deuxième et au quatrième trimestre de chaque année ». Cela correspond au rythme de déploiement d’Android, avec une version majeure au deuxième trimestre et une mineure au quatrième.

Jusqu’à présent, la version AOSP était publiée « dans les jours suivant le déploiement de la mise à jour correspondante sur ses propres appareils mobiles Pixel », rappellent nos confrères. Désormais, Google va se garder une longueur d’avance.

L’annonce est confirmée sur cette page, avec un message pour les développeurs : « À partir de 2026, pour nous aligner sur notre modèle de développement stable et garantir la stabilité de la plate-forme pour l’écosystème, nous publierons le code source sur AOSP au deuxième et au quatrième trimestre. Pour créer et contribuer à AOSP, nous vous recommandons d’utiliser android-latest-release au lieu de aosp-main. La branche de fichier manifeste android-latest-release fera toujours référence à la version la plus récente envoyée à AOSP ».

Google précise à nos confrères que cela ne devrait rien changer pour les correctifs liés à la sécurité : « l’entreprise continuerait à publier chaque mois des correctifs de sécurité sur une branche dédiée uniquement à la sécurité pour les versions pertinentes du système d’exploitation, tout comme elle le fait aujourd’hui », affirme Android Authority. Pourtant, ce fonctionnement aussi a changé il y a quelques mois, au grand dam de LineageOS.

Il y a un peu moins d’un an, Google annonçait que le développement d’Android passait uniquement en interne, avec une conséquence visible : la version publique d’Android est toujours en retard sur la version interne. Google bascule de plus en plus dans un modèle où ses smartphones seront en avance sur les autres niveau logiciel.