Quels sont les différents systèmes de stockage d’énergie ?

Stocker l’énergie est un besoin indubitable de la transition énergétique. On peut toutefois se sentir parfois perdu, parmi tous les concepts, de différentes tailles, de différentes techniques, à différents niveaux de maturité technologique. Nous vous aidons dans cet article à bien comprendre chaque technologie.

Un système de stockage d’énergie est un système capable de manipuler les différentes formes de l’énergie : énergie électrique, énergie chimique, énergie potentielle de pesanteur, et tant d’autres. Le plus souvent, pour charger ce système, il faudra transformer l’énergie fournie à partir d’une source d’énergie disponible, mais peu stable et peu stockable, pour la convertir en une forme durable. Inversement, au cours de la décharge, elle sera « déconvertie » sous une forme où elle est plus utilisable.

Stocker l’énergie, ce n’est donc rien d’autre que cette capacité à jongler avec les différentes formes d’énergie. La classification des catégories de stockage d’énergie est ainsi éminemment liée à la forme de l’énergie qu’il contient. Sur la base de ce principe, nous pouvons proposer une classification sous la forme du tableau suivant :

| Forme d’énergie | Exemples de systèmes de stockage d’énergie |

| Énergie potentielle gravitationnelle | Barrage, STEP, Tour gravitaire |

| Énergie cinétique | Volant d’inertie |

| Énergie élastique | Montre à ressort, stockage d’air comprimé souterrain (CAES) |

| Énergie thermique | Cumulus, Ballon-tampon, stockage à sels fondus, stockage de chaleur souterrains (UTES), |

| Énergie latente | Glacières, « Ballon de glace », autres divers projets de stockage de chaleur |

| Énergie chimique | Hydrogène, carburants synthétiques (méthane, méthanol), accumulateurs électrochimiques (batteries plomb-acide, Li-ion), accumulateurs thermochimiques (ex sels) |

| Énergie électrique | Bobine, Spéculatif : boucles de courant dans supraconducteur à température ambiante |

| Énergie potentielle électrique | Condensateur, Supercondensateur |

| Énergie électromagnétique | Spéculatif : mémoires photoniques de masse |

| Énergie nucléaire | Spéculatif : transition d’isomères nucléaires |

| Masse-énergie | Spéculatif : antimatière |

Chaque type de stockage est détaillé dans la suite de l’article.

Énergie potentielle gravitationnelle

Pour stocker de l’énergie potentielle, il faut de la masse et la placer en hauteur. Typiquement, un tel système de stockage se trouve sous la forme d’un barrage retenant une très grande quantité d’eau. Un tel barrage se trouve sur le chemin d’un cours d’eau ; lorsqu’il est réversible et permet de transférer l’eau entre un bassin inférieur et un bassin supérieur, on parle de Station de transfert d’énergie par pompage (STEP). Une STEP est généralement construite comme une extension d’un barrage, et elle se trouve donc le long d’un cours d’eau. Il existe toutefois des STEP côtières, placée au sommet d’une falaise (le bassin inférieure étant au niveau de la mer, voir uniquement constitué par la mer elle-même) ; citons par exemple le cas bien connu d’El Hierro.

La matière dans laquelle est stockée l’énergie potentielle gravitationnelle peut être également solide. C’est le cas pour certains concepts dits de « tour gravitaire ». La plupart des projets de ce type sont à l’état de R&D, mais certains sont nettement plus avancés, au stade pilote, par exemple, le concept d’Energy Vault.

Pour le stockage à énergie potentielle gravitationnelle, l’énergie d’entrée est le plus souvent électrique, tout comme l’énergie de sortie. Anciennement, des variantes pouvaient proposer de l’énergie cinétique (mouvement) en sortie, par exemple, dans le cas d’un moulin. Ce sont des stocks généralement de très grande taille.

Énergie cinétique

L’énergie cinétique est le plus souvent stockée sous forme d’énergie de rotation, et c’est typiquement le cas des dispositifs appelés « volant d’inertie ». De tels systèmes sont basés sur un matériau pesant, susceptible de tenir vis-à-vis de la force centrifuge à de très hautes vitesses, exigeant ainsi des matériaux de haute technologie. Il existe des concepts avec des matériaux plus courants, mais tout aussi modernes, comme le volant d’inertie en béton d’Energiestro.

L’énergie en entrée du système est le plus souvent fournie sous forme électrique, alimentant un moteur électrique qui met en rotation le volant d’inertie, dans lequel est alors stockée de l’énergie cinétique (de rotation). Lorsqu’il faut extraire de l’énergie, le volant entraîne le moteur en sens inverse, qui devient alors un alternateur capable de produire de l’énergie électrique. Ces systèmes peuvent être de petite taille, ou de grande taille, mais ils ne peuvent rivaliser en pratique avec des barrages, par exemple, en termes de taille.

Il existe également des volants d’inertie purement mécaniques, dans le sens où ils récupèrent, stockent et restituent de l’énergie cinétique uniquement, comme dans le cas des volants moteur des véhicules ; il s’agit par ailleurs de l’utilisation la plus communément répandue aujourd’hui.

Énergie élastique

Il s’agit d’une des plus anciennes manières de stocker l’énergie ; citons par exemple les montres à ressort, qui permettaient de stocker, pour une certaine durée, l’énergie que l’on fournissait en remontant la montre à la main, en faisant tourner sa clé.

Plus moderne, l’exemple le plus typique d’un stock d’énergie élastique sont les concepts de stockages à air comprimé (CAES) ; on parle dans ce cas d’énergie pneumatique. Un simple réservoir d’air comprimé est un stock d’énergie, mais en ce qui concerne le stockage de très grande taille, de vastes projets souterrains sont encore au stade du prototype. Pour ces projets, on cherche essentiellement à stocker l’électricité. Le plus grand projet au monde est celui d’Hubei Yingchang, en Chine.

Citons également le projet MiniCat de Tata, qui était celui d’une voiture dont le réservoir contenait de l’air comprimé. Dans ce cas, l’énergie électrique est typiquement convertie en énergie élastique, pour fournir ensuite une énergie cinétique, de façon à mettre en mouvement un véhicule.

Énergie thermique

L’énergie thermique est un moyen très courant de stocker l’énergie. Le simple cumulus commandé aux heures creuses est un stockage thermique ; la chaleur du bois ou du soleil stockée dans un ballon-tampon en est une généralisation. Le principe est d’une grande simplicité : on chauffe de l’eau par exemple avec de l’électricité, on la conserve chaude dans un réservoir aussi isolé thermiquement que possible, et on récupère plus tard l’énergie thermique contenue dans l’eau chaude.

La bouillote est précisément un stock d’énergie thermique, tout comme l’astuce ancienne qui consistait à placer une brique chauffée au feu dans une couverture au fond du lit. Car l’eau n’est bien sûr pas le seul média pour stocker de la chaleur. Tout matériau peut être chauffé, ce qui revient à dire qu’il stocke de l’énergie sous forme thermique. Ainsi, pour donner un exemple, l’institut étasunien NREL envisage de stocker la chaleur dans le simple sable. Citons également les stockages dits par sels fondus, utilisés par exemple pour compenser l’intermittence, pendant la nuit, de centrales solaires thermiques de grande taille.

Il existe de nombreux projets de stockage massifs de la chaleur, notamment souterrains : il s’agit des concepts d’UTES (pour Underground Thermal Energy Storage, en anglais). La recharge des nappes géothermiques en fait partie. Citons également par exemple le projet de stockage souterrain d’AbSolar, en France.

Énergie latente

L’énergie latente est l’énergie qui est absorbée ou libérée lorsqu’un matériau change de phase, c’est-à-dire se transforme entre solide, liquide ou gazeux, et autres états de la matière (supercritique, plasma, ou différentes phases cristallines pour les solides). On stocke l’énergie sous cette forme, par exemple lorsque l’on utilise des « pains de glace », c’est-à-dire des réservoirs de liquide que l’on refroidit dans le congélateur, pour garder ensuite au frais, des aliments dans une glacière.

C’est un principe ancien, qui était mis en œuvre dans des ouvrages également appelés glacières, de profonds trous dans le sol, isolés, dans lesquels il était possible de stocker de la neige hivernale pour l’été ; pour l’anecdote, ces stocks de froid avaient un intérêt certain : ils servaient à stocker la glace nécessaire aux sorbets – on imagine qu’alors, les glaces étaient un met de luxe. Le projet de « ballon de glace » de Boreales se rapproche, à l’usage de l’industrie, de ces stocks de froid.

Énergie chimique

L’énergie chimique est la principale manière dont nous utilisons et stockons l’énergie aussi bien aujourd’hui que dans le passé. Considérons le bois, pour commencer. Ce bois a été produit par des plantes en consommant de l’énergie solaire (électromagnétique). Cette énergie est susceptible d’être libérée sous forme de chaleur par la combustion du bois, qui n’est autre qu’une réaction chimique de transformation du carburant et de l’oxygène en dioxyde de carbone et en eau. Du point de vue de nos activités économiques, le bois est un stock d’énergie parmi les plus anciens qui soient.

Les carburants fossiles que nous consommons, pour nous déplacer avec nos véhicules, pour nous chauffer avec nos chaudières, ou pour tous les procédés industriels, sont des stocks d’énergie, au même titre que le bois. Un carburant fossile est donc, en quelque sorte, un stock d’énergie solaire, capté par les plantes depuis plusieurs millions d’années, et transformé en hydrocarbures par les processus biologiques et géologiques.

Ce n’est bien sûr pas un processus réversible en premier lieu, et donc ce n’est pas à proprement parler un stock d’énergie. En revanche, lorsque l’on envisage de fabriquer de l’hydrogène, du méthane ou du méthanol, à partir d’électricité renouvelable, d’eau et de dioxyde de carbone, on ne fait rien d’autre que créer un stock d’énergie, apte à être restituée plus tard, et relativement facilement manipulable et stockable – ce qui fait qu’on les nomme vecteurs énergétiques. Pour ce type de stockage, on fournit de l’énergie électrique, stockée sous forme chimique, et qui sera ensuite restituée sous forme de chaleur (énergie thermique) après la combustion. À ce propos, citons l’exemple de l’usine de fabrication de Carbon Recycling International en Islande.

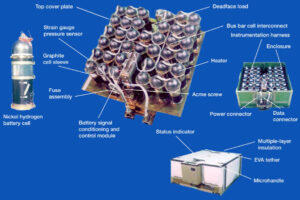

À lire aussi Où se trouvent les stations de transfert d’énergie par pompage (STEP) en France ?L’énergie chimique, c’est également un autre important secteur de la transition énergétique : il s’agit des batteries, ou plus précisément, des accumulateurs électrochimiques. Dans ces systèmes, on injecte de l’énergie électrique, laquelle est convertie en énergie chimique, puis est restituée sous la forme d’énergie électrique. Les concepts de batteries de ce type sont innombrables, celles qui ont le vent en poupe sont les batteries Lithium-ion. Ils peuvent avoir toutes les tailles, des batteries microscopiques aux batteries géantes, mais ne peuvent pas aujourd’hui stocker autant d’énergie qu’un barrage, par exemple.

Pour être tout à fait complet, il existe également d’autres formes de stockage chimique, dites thermochimiques. Ces derniers jouent sur des réactions chimiques qui produisent ou absorbent de la chaleur, de façon à stocker de l’énergie. Dans ces systèmes est utilisée par exemple la réaction chimique résultant de l’adsorption ou l’évaporation de l’eau depuis un sel, laquelle produit, ou absorbe de l’énergie. Certains l’ont peut-être constaté en diluant de la soude : cette opération exige des précautions particulières, et l’opération dégage de la chaleur.

Énergie électrique

L’énergie électrique, c’est-à-dire des charges électriques en mouvement, ne se stocke que très difficilement. Une simple bobine stocke, très temporairement, du courant électrique. Un concept envisagé aujourd’hui serait d’injecter de l’électricité dans une grande bobine en circuit fermé, et de la faire tourner indéfiniment. Toutefois, pour que l’énergie ne soit pas dissipée presque instantanément par effet joule (c’est-à-dire sous forme thermique), il est nécessaire de faire appel à un circuit composé d’un supraconducteur. Et pour que l’énergie nécessaire à refroidir le supraconducteur ne dépasse pas très vite l’énergie stockée, il est nécessaire que le matériau soit supraconducteur à température ambiante.

Un tel matériau, de nombreuses fois annoncé, jamais confirmé, est le Graal de la science des matériaux contemporaine. Son premier inventeur deviendra célèbre, sans l’ombre d’un doute. Nous ne sommes donc pas à l’abri qu’une découverte fracassante sorte un jour, subitement, dans les flux de nouvelles. Demain, par exemple. Ou dans plusieurs siècles…

À lire aussi Comment le stockage d’électricité de longue durée va rentabiliser les énergies renouvelables en EspagneÉnergie potentielle électrique

L’énergie potentielle électrique désigne simplement l’électricité statique. Un dispositif qui stocke des charges électriques s’appelle un condensateur, et c’est un système extrêmement répandu dans les circuits électriques.

En ce qui concerne le stockage de masse, ils sont toutefois beaucoup moins répandus : on parle de supercondensateurs. Un tel système ne peut pas stocker de grandes quantités d’énergie ; ils ont toutefois une très grande réactivité, et, de ce fait, peuvent délivrer une très forte puissance pendant un très court laps de temps.

Une telle caractéristique est particulièrement utile pour la stabilisation du réseau électrique vis-à-vis des variations brutales d’énergie, comme c’est le cas lorsque le mix intègre une plus grande part de source d’électricité renouvelables et intermittente. Citons à ce propos le système ViSync de la société Hybrid Energy Storage Solution, destiné à stabiliser le réseau des îles Canaries.

Énergie électromagnétique

L’énergie électromagnétique est plus connue sous le nom de rayonnement, ou de lumière, mais elle couvre une bien plus large réalité, sur toute la longueur d’onde du spectre électromagnétique, des infrarouges aux ultraviolets, en passant par les ondes radios. Nous avons vu que, sous un certain angle, les hydrocarbures sont un stock d’énergie solaire ; peut-on toutefois stocker la lumière directement, sous sa forme native ?

La réponse est oui. Il existe des composants appelés mémoires photoniques et destinés à piéger les photons. Ces systèmes sont destinés à alimenter des processeurs quantiques, et ils sont étudiés par exemple notamment par le projet BRiiGHT financé par l’Union européenne dans le cadre du programme Horizon 2020. La quantité d’énergie ainsi stockée reste infime ; ce n’est donc pas par cette manière que l’on va stocker la lumière solaire de l’été pour la réinjecter sur des panneaux photovoltaïques en plein hiver.

À lire aussi Les 3 plus grands sites de stockage d’électricité du mondeÉnergie nucléaire

L’énergie nucléaire est celle libérée par les réactions nucléaires, c’est-à-dire celle qui concerne la transformation du noyau des atomes. Imaginer un moyen de stockage d’énergie nucléaire, suppose de pouvoir provoquer, de manière réversible et cyclique, des réactions de fission et de fusion nucléaire. Autant être direct : nous ne savons pas faire cela aujourd’hui.

Il existe en revanche une astuce, celui des isomères nucléaires. Un isomère nucléaire désigne un atome dont le noyau est à un état d’énergie supérieur à celui du noyau de l’atome à l’état de base. En 1998, une équipe de recherche de l’Université du Texas à Dallas a indiqué être parvenu à déclencher des transitions d’état d’énergie d’un isomère de l’hafnium, le 178m2Hf. C’est une perspective intéressante, car l’énergie libérée serait près de 100 000 fois plus importante que celle d’une réaction chimique. Cette découverte n’a toutefois pas été confirmée. Par ailleurs, l’énergie libérée est sous la forme d’un photon gamma (énergie électromagnétique), difficile à utiliser de manière pratique.

Au total, ce n’est donc pas demain que nous disposerons d’une batterie nucléaire rechargeable.

Masse-énergie

La notion de masse-énergie est à relier à la célèbre formule d’Albert-Einstein E=mc2, qui stipule que toute masse peut être convertie en énergie, et inversement. Cette conversion se produit lors de l’interaction de la matière et de l’antimatière. Dans une certaine perspective, il s’agit du grade ultime du stock d’énergie, car chaque kilogramme de matière et d’antimatière peut produire mille fois plus d’énergie que le même kilogramme d’uranium fissile, et plusieurs milliards de fois plus d’énergie qu’un kilogramme de carburant classique.

En revanche, ce n’est pas une option réaliste aujourd’hui. L’antimatière peut être produite dans un accélérateur à particules, mais avec un rendement déplorable (on ne stocke une énergie que de l’ordre du milliardième de l’énergie utilisée pour la produire) ; par ailleurs, le stockage de l’antimatière est une gageure. Ce n’est donc pas une option crédible à l’heure actuelle, sans que cela n’empêche de rêver qu’un jour, de grands accélérateurs de particules en orbite du Soleil, alimentés par de vastes panneaux photovoltaïques, alimentent en antimatière tous les besoins de l’Humanité.

L’article Quels sont les différents systèmes de stockage d’énergie ? est apparu en premier sur Révolution Énergétique.