La plateforme Medium est, elle aussi, inondée par les contenus générés par IA

MedIAm

Environ 7 % des articles publiés sur des sites d’information seraient en fait générés par des IA. Sur la plateforme de publication d’articles et de billets Medium, ce taux serait de plus de 40 %. Une pollution que relativise le PDG de l’entreprise, estimant que personne ne les lit.

À l’origine, le slop désigne l’amas de boues qui tapisse au fur et à mesure le fond des citernes des navires, notamment pétroliers, écrivait le Courrier International en juin dernier. Le terme est aussi depuis quelques mois utilisé pour désigner les contenus bas de gamme générés par des IA et qui inondent de plus en plus le web.

Non content de polluer Amazon Books et Youtube (jusque et y compris les chaînes de philosophie, constatait récemment Monsieur Phi), le slop envahirait aussi la plateforme de blogs Medium. WIRED raconte en effet avoir demandé à la société Pangram Labs, spécialisée dans la détection de l’intelligence artificielle, d’analyser un échantillon de 274 466 articles récents, publiés sur une période de six semaines sur la plateforme.

La start-up, qui présente sa technologie comme « la plus précise pour détecter les contenus générés par l’IA à grande échelle », avec un taux de précision de « plus de 99,98 % », a estimé que plus de 47 % d’entre eux étaient probablement générés par l’IA (GenAI).

WIRED a demandé à une seconde start-up, elle aussi dédiée à la détection des contenus GenAI, Originality AI, de comparer deux échantillons de posts Medium, l’un datant de 2018, l’autre de cette année. 3,4 % du premier avaient probablement été générés par IA.

Un pourcentage qui correspond au taux de faux positifs de l’entreprise, précise son PDG, John Gillham, d’autant que les outils d’IA n’étaient pas encore largement utilisés. A contrario, un peu plus de 40 % de l’échantillon de 2024 étaient probablement générés par l’IA.

7 % des articles d’actualité seraient générés par des IA

« C’est deux ordres de grandeur de plus que ce que je vois sur le reste de l’internet », explique Max Spero, PDG de Pangram, à WIRED. En août, la start-up avait en effet analysé 857 43 articles publiés sur 26 675 sites web d’information sur une seule journée de juillet dernier, et découvert que 59 653 d’entre eux, soit 6,96 %, avaient été, en tout ou partie (de 50 à 100 %), rédigés par des IA.

Le Ghana arrivait en tête des pays ayant le plus recours aux IA, avec près de 33 % des articles GenAI, suivi par le Pérou (plus de 20 %), le Brésil, la Colombie et le Pakistan (16 %). Si la France (8 %) arrivait en avant-dernière position du classement, juste derrière Singapour et l’Espagne, ce dernier mentionnait principalement des pays d’Amérique du Sud, d’Afrique de l’Ouest et d’Asie du Sud, et aucun autre pays européen, ni nord américain.

La Tech arrivait en tête des thématiques les plus polluées par les contenus GenAI, devant la beauté (du fait des articles sponsorisés), le business, le jeu, la finance et la science, notamment en rapport avec des escroqueries liées aux crypto-actifs.

Appeaux putaclics à pubs et escroqueries aux cryptos

Pangram avait identifié plusieurs types d’articles GenAI. Certains n’ont que pour objectif de remplir des « sites conçus pour la publicité » (made-for-advertising sites, ou MFAs) afin d’attirer des lecteurs, et de les exposer à des publicités bas de gamme.

Leurs contenus ne sont dès lors « pas vraiment destinés à être lus », mais juste à attirer le chaland, via des titres « putaclics » notamment. Les annonceurs ne sont, eux non plus, pas conscients d’afficher leurs publicités sur ces sites bas de gamme. Pangram estime que les MFAs représentent environ 50 % des contenus GenAI.

L’entreprise a aussi constaté qu’une « grande partie » des articles sur le thème de la beauté était en fait « sponsorisés », et donc écrits par des communicants et rédacteurs sous-traitant la rédaction de tels contenus à des IA. De même, de nombreux modes d’emploi liés à de nouveaux crypto-actifs s’avèrent être des escroqueries, dont la rédaction est là aussi sous-traitée à des IA.

78 % des articles taggués NFT, web3 et Ethereum étaient GenAI

Sur Medium, 4 492 des 5 712 articles (soit 78 %) taggués NFT avait eux aussi probablement été générés par IA. Une proportion démesurée que Pangram a aussi constaté du côté des articles estampillés web3, Ethereum, « AI » et… pets (animaux de compagnie).

McKenzie Sadeghi, rédacteur chez NewsGuard, une société de surveillance de la désinformation en ligne qui a de son côté identifié plus de 1 000 sites web d’information GenAI, a de son côté constaté que la plupart de ce type de contenus portaient sur les cryptoactifs, le marketing et l’optimisation des moteurs de recherche (SEO).

Les nombreux comptes semblant avoir publié des volumes importants de documents générés par l’IA semblent par ailleurs ne concerner qu’un lectorat faible, voire inexistant, relève WIRED. Un compte signalé par Pangram Labs comme ayant rédigé plusieurs articles consacrés à des cryptos avait ainsi publié six d’entre eux en une journée seulement, mais sans aucune interaction, suggérant un impact négligeable.

À l’inverse, WIRED a aussi constaté que d’autres articles signalés par Pangram, Originality et la société de détection de l’IA Reality Defender comme étant probablement générés par l’IA, avaient des centaines de « claps », similaires aux « likes » que l’on trouve sur d’autres plateformes, mais sans que l’on sache s’ils émanent d’être humains, ou de bots.

Medium est fait pour le storytelling humain, pas pour les articles GenAI

« Medium fonctionne essentiellement grâce à la curation humaine », rétorque Tony Stubblebine, le PDG de la plateforme, évoquant les 9 000 rédacteurs en chef des publications de Medium, ainsi que l’évaluation humaine supplémentaire des articles susceptibles d’être artificiellement « boostés ».

S’il reconnaît que les contenus GenAI publiés sur Medium « a probablement décuplé depuis le début de l’année », il s’oppose néanmoins à l’utilisation de détecteurs d’IA pour évaluer la portée du problème, en partie parce qu’il estime qu’ils ne peuvent pas faire la différence entre les messages entièrement générés par l’IA et les messages dans lesquels l’IA est utilisée de manière plus légère (ce que rejette le PDG de Pangram, au demeurant).

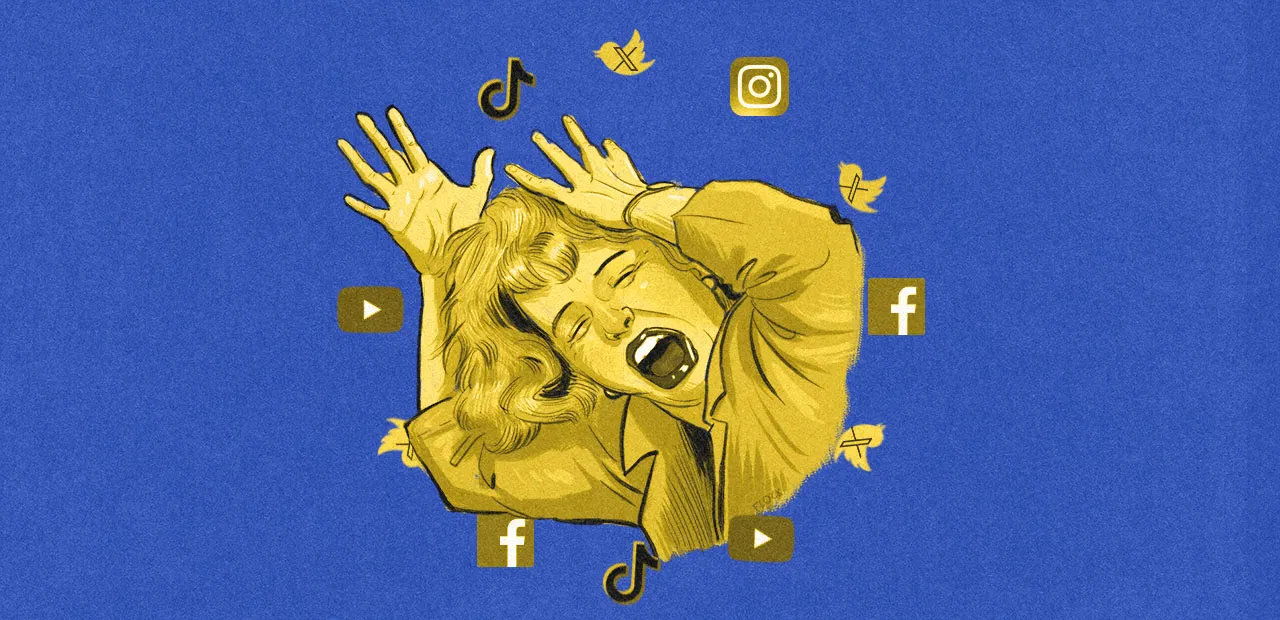

Contrairement à LinkedIn et Facebook, qui encouragent explicitement l’utilisation de l’IA, Medium n’autorise plus d’articles GenAI. « Medium est destiné à la narration humaine, pas à l’écriture générée par l’IA », avait souligné la plateforme sur son blog, l’an passé. « La grande majorité des histoires détectables générées par l’IA dans les flux bruts pour ces sujets font zéro vue », renchérit Stubblebine.

« À mesure que les outils d’IA générative se banalisent, les plateformes qui renoncent à essayer d’éliminer les bots incuberont un monde en ligne dans lequel le travail créé par les humains deviendra de plus en plus difficile à trouver sur les plateformes submergées par l’IA », conclut WIRED, en écho à la théorie de l’Internet mort.

Estampillée complotiste, elle avance qu’Internet ne serait pratiquement plus peuplé que par des bots et que la majorité du contenu est généré par des algorithmes, marginalisant l’activité humaine.

Coup d'arrêt pour l'application criminelle téléphonique

Coup d'arrêt pour l'application criminelle téléphonique