Qui c'est qu'a la plus Grok ?

En 2025, le nombre de signalements par X de contenus à caractère pédosexuel a chuté de 81 % après que l’entreprise en ait internalisé la détection. Dans le même temps, Musk poussait les équipes de Grok à entraîner son chatbot débridé à reproduire des contenus à caractère sexuel.

Réagissant à la polémique autour de la vague massive de deepfakes en bikinis générés par Grok, le compte @Safety de X.com précisait le 14 janvier dernier : « Nous restons déterminés à faire de X une plateforme sûre pour tous et continuons à appliquer une politique de tolérance zéro envers toute forme d’exploitation sexuelle des enfants, de nudité non consentie et de contenu sexuel non désiré ».

« Nous prenons des mesures pour supprimer les contenus violents hautement prioritaires, notamment les contenus pédopornographiques (CSAM) et la nudité non consentie, et prenons les mesures appropriées à l’encontre des comptes qui enfreignent nos règles X. Nous signalons également aux autorités compétentes les comptes qui recherchent des contenus liés à l’exploitation sexuelle des enfants, si nécessaire. »

X.com n’a pas mis à jour son rapport de transparence depuis son rachat par Elon Musk en 2022. Et le parquet de Paris explique au Monde que X aurait commencé, l’an passé, à utiliser une technologie « maison », en remplacement du système Safer de détection de contenus pédopornographiques de l’organisation Thorn, qui avait elle-même été accusée de lobbying intense en faveur du projet #ChatControl de surveillance des messageries chiffrées.

Le 18 juin 2025, @Safety avait en effet annoncé « une mise à jour importante concernant notre travail continu de détection des contenus pédopornographiques (CSAM) et […] que nous avons lancé des efforts supplémentaires de correspondance de hachage CSAM […] grâce au travail incroyable de notre équipe d’ingénieurs en sécurité, qui a mis au point des systèmes de pointe pour renforcer encore nos capacités d’application de la loi ».

En 2024, précisait @Safety, « X a envoyé 686 176 signalements au National Center for Missing and Exploited Children (NCMEC) et suspendu 4 572 486 comptes. Entre juillet et octobre 2024, @NCMEC

a obtenu 94 arrestations et 1 condamnation grâce à ce partenariat ».

Or, le parquet précise au Monde qu’« entre juin et octobre 2025, il a été constaté une baisse de 81,4 % des signalements concernant la France adressés par X au National Center for Missing & Exploited Children en matière de pédopornographie ».

Ce qui a entraîné les magistrats à étoffer leur enquête sur des faits de « complicité de détention d’images de mineurs représentant un caractère pédopornographique », de « complicité de diffusion, offre ou mise à disposition en bande organisée » de ces contenus.

« Faire progresser notre compréhension collective de l’univers »

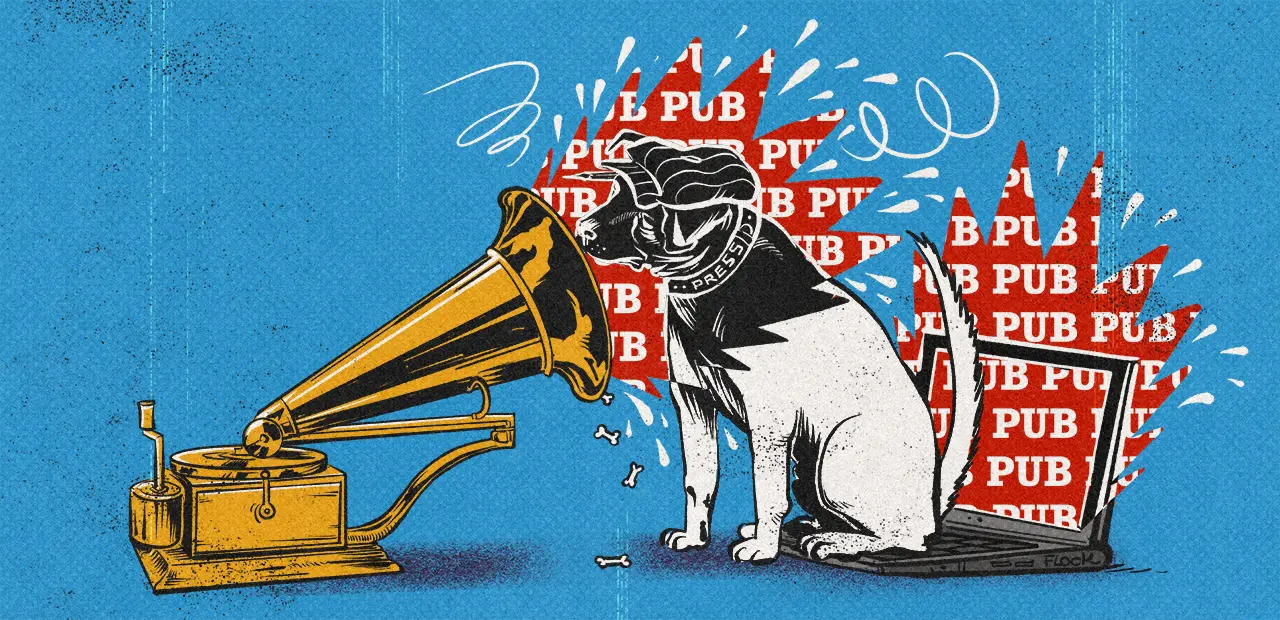

Une enquête de trois journalistes du Washington Post intitulée « Dans les coulisses du pari de Musk pour attirer les utilisateurs qui a transformé Grok en générateur de porno » permet de mieux comprendre comment X et Grok en sont arrivés là.

Quelques semaines avant qu’Elon Musk ne quitte officiellement le DOGE du gouvernement de Donald Trump au printemps dernier, les employés de l’équipe chargée d’aider à définir la manière dont le chatbot Grok de xAI répond à ses utilisateurs reçurent en effet une « dérogation surprenante » de leur employeur, raconte le Post.

Elle leur demandait en effet de s’engager à travailler sur du « contenu vulgaire [profane en anglais], y compris sexuel ». La note les prévenait que leur travail les exposerait dès lors à « des contenus sensibles, violents, sexuels et/ou autres contenus choquants » qui, précisait la décharge, « peuvent être perturbants, traumatisants et/ou causer un stress psychologique ».

Peu après le retour de Musk chez xAI, une note des ressources humaines a demandé à l’équipe qui supervise des centaines de « tuteurs IA », chargés d’étiqueter les résultats de Grok afin de les améliorer, de demander aux candidats à un poste s’ils seraient à l’aise pour travailler avec du contenu « explicite ».

L’entreprise modifia également certains protocoles relatifs aux contenus à caractère sexuel. À l’origine, xAI conseillait à ses employés d’éviter d’examiner ce type de contenus sensibles, afin d’éviter d’apprendre au chatbot à pouvoir les reproduire, selon trois des personnes interrogées par le Post.

Mais le protocole fut modifié durant l’été 2025, de sorte qu’il soit acceptable d’étiqueter les images de personnes nues générées par l’IA. L’un des employés qui travaillait avec le générateur d’images de Grok raconte même avoir « souvent » reçu des demandes pour que Grok « déshabille » des gens depuis le printemps 2025, et estime que le bot s’y conformait environ 90 % du temps.

Des employés évoquent « une nouvelle orientation inquiétante » pour une entreprise qui demande explicitement à être présentée comme « une entreprise qui travaille à la mise au point d’une intelligence artificielle visant à accélérer les découvertes scientifiques humaines, dont la mission est de faire progresser notre compréhension collective de l’univers ». Une dérive leur laissant penser que l’entreprise était désormais prête à produire tout type de contenu susceptible d’attirer et de fidéliser les utilisateurs.

Accroître la popularité de Grok avec des contenus à caractère sexuel

Dans les mois qui ont suivi, ces employés ont ainsi été exposés à ce que le Post qualifie de « flot d’enregistrements audio à caractère sexuel », émanant notamment de « conversations obscènes » entre des occupants de Tesla et le chatbot de leur voiture, ainsi que des interactions à caractère sexuel d’autres utilisateurs avec Grok.

Après avoir quitté le DOGE en mai, Musk a maintenu une « présence constante » dans les bureaux de xAI, jusqu’à y passer parfois la nuit, souligne le Post. Certains employés ont été invités à ne pas prendre de vacances à la fin du printemps ou au début de l’été, mais également, et régulièrement, à y travailler la nuit et pendant des week-ends.

L’objectif assigné par Musk était d’accroître la popularité de Grok. Au fil de nombreuses réunions, il défendait une nouvelle mesure, les « secondes d’activité de l’utilisateur », censée mesurer de manière précise le temps passé par les gens à converser avec le chatbot.

À cet effet, xAI s’est mis à créer du contenu à caractère sexuel et des compagnes IA sexy. L’entreprise a aussi levé les restrictions préalablement mises en place en ignorant les avertissements internes au sujet des risques juridiques et éthiques liés à la production de tels contenus, selon des documents obtenus par le Post et des entretiens menés auprès de plus d’une demi-douzaine d’anciens employés de X et xAI, et plusieurs personnes proches de M. Musk.

Les équipes de X chargées de la sécurité avaient pourtant averti à plusieurs reprises la direction que ses outils d’IA pouvaient permettre aux utilisateurs de créer des images sexuelles d’enfants ou de célébrités à l’aide de l’IA, ce qui pourrait enfreindre la loi, selon deux de ces personnes.

Les sources du Post précisent qu’au sein de xAI, l’équipe chargée de la sécurité de l’IA de l’entreprise ne comptait en outre que deux ou trois personnes pendant la majeure partie de l’année 2025, contre des dizaines d’employés dans les équipes similaires chez OpenAI ou d’autres concurrents.

Le Post relève aussi que trois cadres supérieurs du petit groupe chargé de superviser la sécurité des produits, la sécurité de l’IA et le comportement des modèles avaient annoncé leur départ début décembre.

+ 72 % de téléchargements grâce aux deepfakes en bikinis

« La stratégie de Musk a porté ses fruits pour l’entreprise », relève le Post. Alors que Grok était autrefois classé plusieurs dizaines de places derrière ChatGPT dans le classement des applications gratuites de l’App Store d’Apple, il figure désormais dans le top 5, aux côtés du chatbot d’OpenAI et de Gemini de Google.

Selon la société d’études de marché Sensor Tower, le nombre moyen quotidien de téléchargements de l’application Grok dans le monde a bondi de 72 % entre le 1er et le 19 janvier par rapport à la même période en décembre.

Le 15 janvier, xAI publiait une offre de recrutement d’un superviseur de la sécurité chargé de « superviser la modération du contenu et le service client afin de lutter contre le spam, la fraude et les contenus préjudiciables, en appliquant les politiques de manière impartiale » afin de « faire de X un espace plus sûr et plus fiable pour les utilisateurs du monde entier ».

Le Post précise que ni Musk, ni xAI ni X n’ont répondu à sa demande détaillée de commentaires.

Nitasha Tiku, l’une des trois signataires de l’enquête du Post, fait partie de la centaine de journalistes à avoir appris leur licenciement hier. Les deux autres, Faiz Siddiqui et Elizabeth Dwoskin, semblent avoir été épargnés.

![[Tuto] Auto-héberger son gestionnaire de mots de passe avec Vaultwarden (Bitwarden)](https://next.ink/wp-content/uploads/2025/07/Cadenas-ouvert2.webp)