L’Espagne bloque les fonctionnalités que Meta avait prévues pour les élections européennes

Cambridge analitiquoi ?

La CNIL espagnole vient de décider la suspension de l’implémentation sur son territoire des fonctionnalités prévues par Meta. L’entreprise voulait les ajouter à Instagram et Facebook à l’occasion des élections européennes pour « empêcher la collecte de données, le profilage des utilisateurs et le transfert d’informations à des tiers ».

L’Agencia Española de Protección de Datos (AEPD) annonce avoir décidé le blocage préventif de l’implémentation des fonctionnalités que Meta voulait intégrer à Facebook et Instagram pour les élections européennes.

L’entreprise de Mark Zuckerberg a prévu de lancer deux outils appelés « Election Day Information » (EDI) et Voter Information Unit (VIU). Et, selon l’autorité, Meta récupérerait et traiterait des données concernant l’utilisation de ces outils.

L’AEPD veut, par cette mesure, empêcher « la collecte de données, le profilage des utilisateurs et le transfert d’informations à des tiers, afin d’éviter que les données personnelles ne soient utilisées par des tiers inconnus et à des fins non explicites ». Cette interdiction aura une durée maximale de trois mois. Meta ne devrait donc pas pouvoir les mettre en place en Espagne lors du scrutin européen.

La CNIL espagnole considère que le traitement des données prévu par Meta implique une action contraire au RGPD. Au minimum, elle « violerait les principes de protection des données que sont la licéité, la minimisation, et la limitation du stockage ».

Selon l’agence, ces deux fonctionnalités traiteraient des données personnelles « telles que, entre autres, le nom de l’utilisateur, l’adresse IP, l’âge et le sexe ou des informations sur la manière dont l’utilisateur interagit avec ces fonctionnalités ».

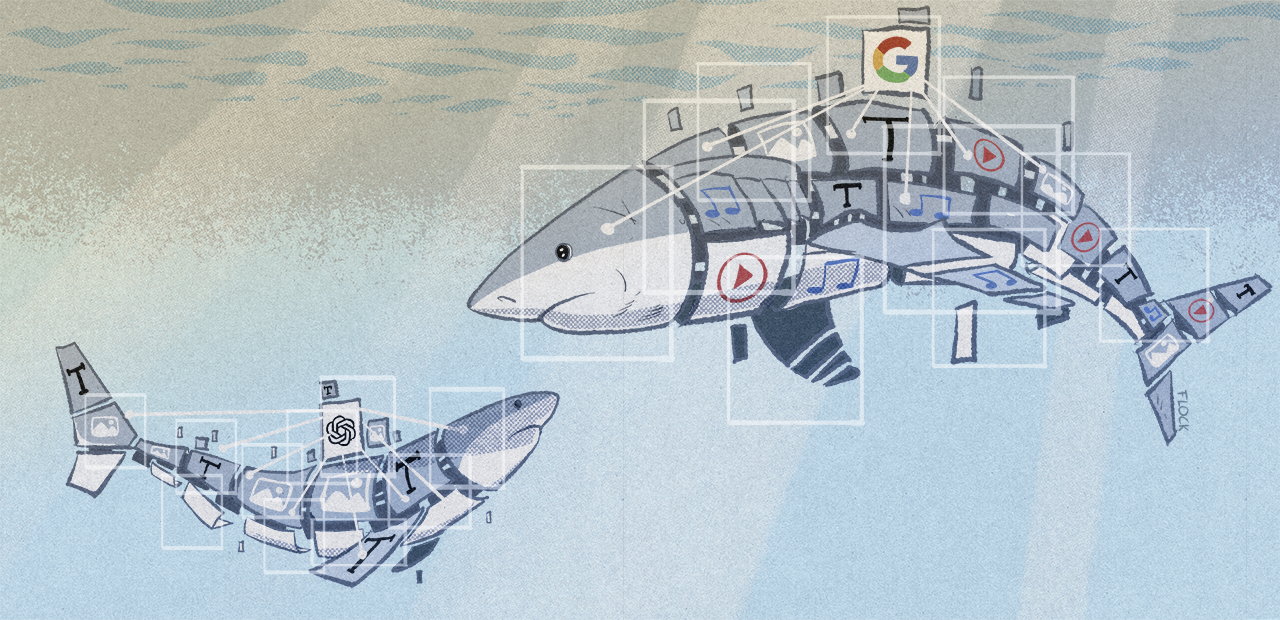

Éviter un nouveau Cambridge Analytica

Pour l’autorité, cette récupération et ce stockage des données « mettraient gravement en péril les droits et libertés des utilisateurs d’Instagram et de Facebook, qui verraient augmenter le volume d’informations que Meta collecte à leur sujet, permettant un profilage plus complexe, détaillé et exhaustif, et générant un traitement plus intrusif ».

Elle ajoute que donner accès à ces informations à des acteurs tiers « entraînerait une ingérence disproportionnée dans les droits et libertés des personnes concernées ».

Si l’autorité ne le mentionne pas, cette peur qu’elle évoque rappelle l’utilisation des données de millions d’utilisateurs de Facebook lors du scandale de Cambridge Analytica.

- Retour sur le scandale Cambridge Analytica et la (molle) réponse de Facebook

- Affaire Cambridge Analytica : les pressions européennes s’accentuent sur Facebook

Prévues dans toute l’Europe à l’exception de l’Italie

L’AEPD explique que Meta lui a indiqué vouloir lancer ces fonctionnalités pour tous les utilisateurs de ses services qui pourront voter aux élections européennes, « à l’exception de l’Italie, dont l’autorité de protection des données a déjà entamé une procédure à ce sujet ».

En effet, en septembre 2022, l’autorité italienne (GPDP) avait déjà mis en place une procédure contre Meta à propos des élections nationales. Elle y évoquait d’ailleurs plus explicitement le scandale Cambridge Analytica.

Interrogée par TechCrunch, Meta a répondu : « nos outils électoraux ont été expressément conçus pour respecter la vie privée des utilisateurs et se conformer au RGPD. Bien que nous ne soyons pas d’accord avec l’évaluation de l’AEPD, nous avons coopéré ».

(@SashaMTL)

(@SashaMTL)