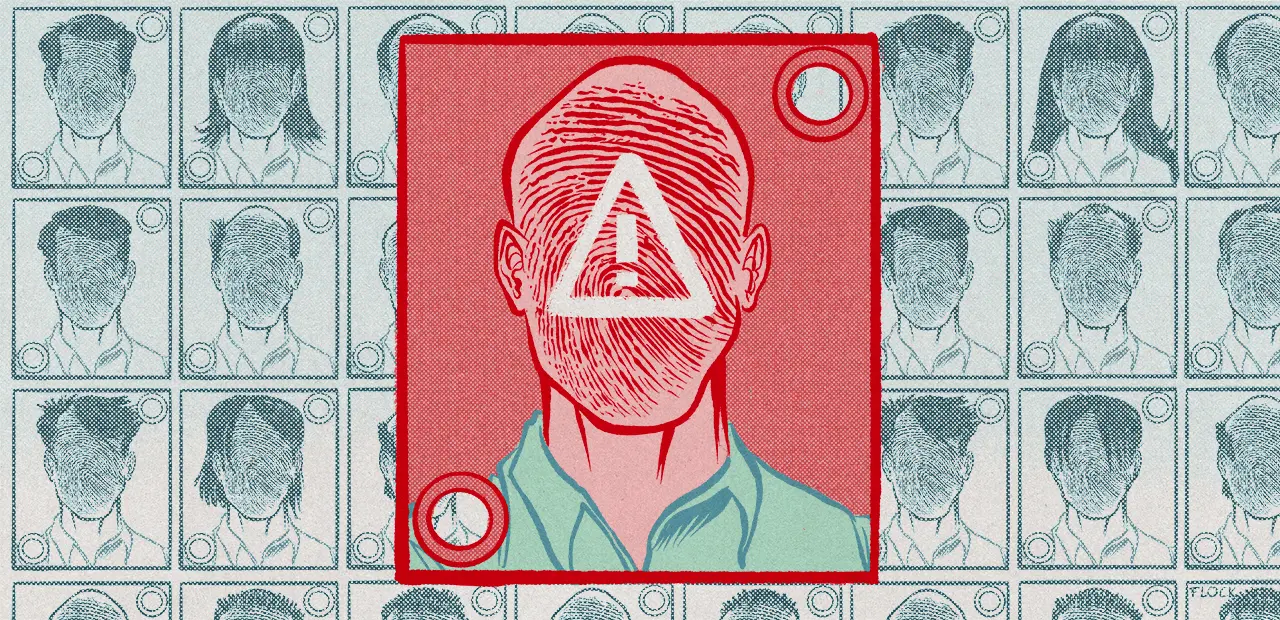

Common or paywalled ?

Alors que Common Crawl fournit des téraoctets de données d’entrainement aux entreprises d’IA générative, l’organisation est accusée de récupérer des contenus placés derrière des paywalls. La presse, en France ou ailleurs, essaye de bloquer l’aspiration de ses contenus via des procédures judiciaires, mais la plupart des paywalls laissent des trous pour jouer le jeu de l’indexation dans les moteurs de recherche.

La base de données Common Crawl est sous le feu des critiques de la presse parce qu’elle fournit aux entreprises d’IA générative comme OpenAI, Google, Anthropic, Nvidia, Meta ou Amazon énormément de contenus pour l’entrainement de leurs modèles.

La plupart des grands modèles de langage s’appuient, depuis leurs origines, sur cette base de données. Celle-ci regroupe des téraoctets de textes moissonnés sur le web. Tous les mois, une nouvelle archive est publiée par Common Crawl, gérée par une structure à but non lucratif.

Ainsi, le lot d’octobre 2025 contient 2,6 milliards de pages web, correspondant à 126 téraoctets de données compressées. Si la légalité de ce genre de moissonnage pour la recherche ou pour l’indexation ne fait pas de doute, il y en a plus pour des projets commerciaux d’IA générative, notamment car leurs systèmes peuvent régurgiter les contenus qui sont sous copyright ou sous d’autres régimes de droit d’auteurs.

Des articles sous paywall dans Common Crawl ?

Ce lundi 4 novembre, The Atlantic a publié un article à propos de la base de donnée qui accuse la structure à but non lucratif d’avoir ouvert une porte dérobée (backdoor) pour les entreprises d’IA leur permettant d’entrainer leurs modèles sur les articles de presse sous paywall, et de mentir à ce sujet aux éditeurs de presse.

Notre confrère, Alex Reisner, estime que les archives de Commons Crawl contiennent « des millions d’articles provenant d’organismes de presse du monde entier, notamment The Economist, Los Angeles Times, The Wall Street Journal, The New York Times, The New Yorker, Harper’s et The Atlantic ».

En France, l’Alliance de la presse d’information générale (APIG) et le Syndicat des éditeurs de la presse magazine (SEPM) sont passés à la vitesse supérieure début septembre en mettant en demeure début septembre Common Crawl de retirer les sites de leurs membres de son archivage.

Retrait des articles de 81 éditeurs français

Un mois après, les deux lobbys de la presse ont obtenu le retrait des contenus de 81 éditeurs. Dans une interview au Journal du Net publiée début septembre, Léa Boccara, responsable du pôle juridique et des affaires publiques de l’Alliance, accusait aussi l’organisme à but non lucratif d’archiver des articles payants : « Nous sommes face à un crawling de masse d’articles et d’extraits d’articles, qui contourne les paywalls ». Elle rejoint ainsi les accusations lancées par The Atlantic.

On peut facilement imaginer, comme nos confrères états-uniens l’affirment, que Common Crawl ne se logue pas à chaque site d’information pour aspirer les contenus, mais qu’il contourne les paywalls. Et, en effet, de nombreux systèmes utilisés par la presse pour bloquer l’accès à leurs contenus se contentent de cacher avec du code javascript le texte des articles. Ainsi, alors qu’un navigateur ne l’affichera pas à l’utilisateur lambda d’un navigateur, un crawler peut facilement le récupérer.

Ajoutons qu’une bonne partie des éditeurs de presse savent que, derrière ce genre de « paywall », leurs contenus ne sont que vaguement protégés, ce qui permet de laisser les robots des moteurs de recherche classiques moissonner ces articles, et de mieux les valoriser dans leurs résultats.

Common Crawl réfute

Common Crawl a réagi à l’article de The Atlantic dans un billet publié le même jour. L’organisation réfute les accusations de mensonges envers les éditeurs de presse : « Cela donne une image fausse du fonctionnement de Common Crawl et des valeurs qui guident notre travail ». Elle ajoute : « Nous ne contournons pas les « paywalls », ne nous connectons à aucun site web et n’utilisons aucune méthode visant à contourner les restrictions d’accès ».

Elle affirme avoir toujours eu une approche transparente en publiant le code de son crawling et en le documentant publiquement, en identifiant l’user agent « CCBot » de son bot de crawling, en respectant les robots.txt et en se conformant « aux demandes de retrait et de suppression qui nous sont envoyées de bonne foi ».

Dans l’article de The Atlantic, le responsable de Common Crawl, Rich Skrenta, avait été plus direct, répondant que les éditeurs faisaient une erreur en s’excluant d’eux-mêmes de la « recherche 2.0 ». Il ajoutait : « Vous n’auriez pas dû publier votre contenu sur Internet si vous ne vouliez pas qu’il figure sur Internet ».

Enjeu économique avec des contrats à la clé

Reste que la presse n’engage pas ces démarches pour bloquer entièrement tout accès à leurs articles payants aux entreprises d’IA générative. En effet, comme l’explique l’Alliance de la presse d’information générale il y a là « un enjeu économique majeur » autour d’accords financiers avec ces mêmes entreprises d’IA.

Le Monde et Prisa Media ont, par exemple, dès le début de l’année 2024, signé des contrats avec OpenAI. L’Alliance s’appuie d’ailleurs sur l’exemple des accords noués avec Google sur les droits voisins concernant son moteur de recherche.

Louis Dreyfus, président du directoire du journal, expliquait encore récemment à l’INA que son groupe de presse a « vocation à signer d’autres accords avec d’autres acteurs ». Si Le Monde a aussi signé un contrat avec Perplexity, le responsable du journal explique que celle-ci n’a pas la possibilité d’entrainer de LLM avec ses articles, contrairement à OpenAI.