Wave Energy Projects Have Come a Long Way After 10 Years

Read more of this story at Slashdot.

Read more of this story at Slashdot.

À moins que le bug des SSD qui disparaissaient sous Windows 11 et qui obligeait certains (rares) utilisateurs à redémarrer leur PC pour qu'ils apparaissent à nouveau ne fasse un retour en force dans les prochains jours, ce qui semble vraiment peu probable, il semblerait bien que nous soyons en train...

À moins que le bug des SSD qui disparaissaient sous Windows 11 et qui obligeait certains (rares) utilisateurs à redémarrer leur PC pour qu'ils apparaissent à nouveau ne fasse un retour en force dans les prochains jours, ce qui semble vraiment peu probable, il semblerait bien que nous soyons en train...

Read more of this story at Slashdot.

Read more of this story at Slashdot.

Read more of this story at Slashdot.

Il y a maintenant dix mois déjà, le 24 octobre 2024 pour être précis, Intel lançait sa nouvelle gamme de processeurs pour ordinateurs de bureau répondant au nom de code Arrow Lake-S : les Core Ultra 200S. Comme le montrait notre test à H&Co, cette nouvelle série n'est pas dénuée d'intérêt en app...

Il y a maintenant dix mois déjà, le 24 octobre 2024 pour être précis, Intel lançait sa nouvelle gamme de processeurs pour ordinateurs de bureau répondant au nom de code Arrow Lake-S : les Core Ultra 200S. Comme le montrait notre test à H&Co, cette nouvelle série n'est pas dénuée d'intérêt en app...

Read more of this story at Slashdot.

Read more of this story at Slashdot.

AMD ne s'est toujours pas exprimé officiellement concernant la rumeur qui se répandait en début de mois, annonçant la fin de vie commerciale du Ryzen 7 5700X3D. Les faits semblent cependant lui donner raison puisqu'après de nombreux pays dont les États-Unis, au milieu du mois d'aout c'était au tour...

AMD ne s'est toujours pas exprimé officiellement concernant la rumeur qui se répandait en début de mois, annonçant la fin de vie commerciale du Ryzen 7 5700X3D. Les faits semblent cependant lui donner raison puisqu'après de nombreux pays dont les États-Unis, au milieu du mois d'aout c'était au tour...

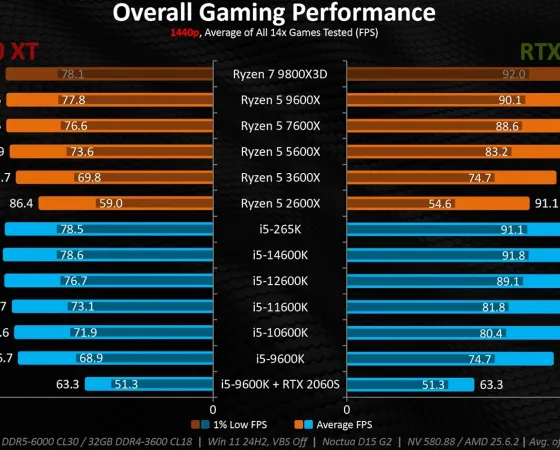

Voilà un test qui devrait intéresser ceux qui hésitent à mettre à jour leur PC avec une AMD Radeon RX 9060 XT 16Go ou NVIDIA GeForce RTX 5060 Ti 16Go pour lui donner un coup de jeune. L'idée, en soi, a peu de chance d'être mauvaise car ces nouvelles cartes offrent un ratio performances / prix très i...

Voilà un test qui devrait intéresser ceux qui hésitent à mettre à jour leur PC avec une AMD Radeon RX 9060 XT 16Go ou NVIDIA GeForce RTX 5060 Ti 16Go pour lui donner un coup de jeune. L'idée, en soi, a peu de chance d'être mauvaise car ces nouvelles cartes offrent un ratio performances / prix très i...

Au tout début de ce mois d'aout 2025, nous avions eu droit aux configurations recommandées pour les phases de bêta ouverte de Battlefield 6. Désormais, Electronic Arts et DICE peaufinent le lancement officiel qui sera pour rappel le 10 octobre. Une phase inévitable vient d'être réalisée en ce 29 aou...

Au tout début de ce mois d'aout 2025, nous avions eu droit aux configurations recommandées pour les phases de bêta ouverte de Battlefield 6. Désormais, Electronic Arts et DICE peaufinent le lancement officiel qui sera pour rappel le 10 octobre. Une phase inévitable vient d'être réalisée en ce 29 aou...

Nous avons tous déjà entendu l'expression "Si c'est gratuit, vous êtes le produit". Elle prend tout son sens dans l'affaire dont nous allons parler aujourd'hui et qui est, il faut bien le dire, très malaisante pour ceux qui utilisaient ces derniers mois le service de VPN gratuit FreeVPN.One.À premiè...

Nous avons tous déjà entendu l'expression "Si c'est gratuit, vous êtes le produit". Elle prend tout son sens dans l'affaire dont nous allons parler aujourd'hui et qui est, il faut bien le dire, très malaisante pour ceux qui utilisaient ces derniers mois le service de VPN gratuit FreeVPN.One.À premiè...

On dit que "le diable se cache dans les détails". Il semblerait, parfois, que la fin de vie commerciale de certains produits ne se voir qu'à de petits détails. Jusqu'au mois de juillet 2025 inclus, AMD distribuait officiellement trois ventirads CPU différents en bundle avec certains de ses processeu...

On dit que "le diable se cache dans les détails". Il semblerait, parfois, que la fin de vie commerciale de certains produits ne se voir qu'à de petits détails. Jusqu'au mois de juillet 2025 inclus, AMD distribuait officiellement trois ventirads CPU différents en bundle avec certains de ses processeu...

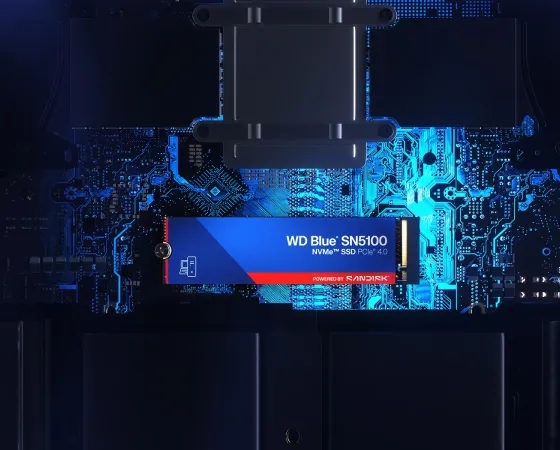

Hier, le 27 aout 2025, la marque Sandisk lançait son nouveau SSD PCIe 4.0 d'entrée de gamme : le WD Blue SN5100. Un lancement particulier à plus d'un titre, nous allons vous expliquer dans cette actualité pourquoi, sans omettre évidemment de vous donner toutes les caractéristiques du nouveau venu, s...

Hier, le 27 aout 2025, la marque Sandisk lançait son nouveau SSD PCIe 4.0 d'entrée de gamme : le WD Blue SN5100. Un lancement particulier à plus d'un titre, nous allons vous expliquer dans cette actualité pourquoi, sans omettre évidemment de vous donner toutes les caractéristiques du nouveau venu, s...

En ce 28 aout 2025, Metal Gear Solid Delta: Snake Eater sort dans le monde. Vous pouvez évidemment retrouver des tests du jeu en lui-même un peu partout sur internet, mais nous, en tant que passionnés de hardware, ce qui nous intéresse également c'est de savoir comment s'en sortent nos composants lo...

En ce 28 aout 2025, Metal Gear Solid Delta: Snake Eater sort dans le monde. Vous pouvez évidemment retrouver des tests du jeu en lui-même un peu partout sur internet, mais nous, en tant que passionnés de hardware, ce qui nous intéresse également c'est de savoir comment s'en sortent nos composants lo...

Nous vous en parlions pour la première fois lors du Computex 2023 : Cooler Master travaillait sur un projet d'alimentation entièrement fanless avec de grosses puissances supportées. Sont petit nom : X Silent, et à l'époque il était question de 750 W. Nous avions ensuite à H&Co découvert des docu...

Nous vous en parlions pour la première fois lors du Computex 2023 : Cooler Master travaillait sur un projet d'alimentation entièrement fanless avec de grosses puissances supportées. Sont petit nom : X Silent, et à l'époque il était question de 750 W. Nous avions ensuite à H&Co découvert des docu...

Aurons-nous un jour le fin mot de l'histoire sur ce qui se passe réellement depuis le 17 aout 2025 et cette information qui a fait rapidement le tour du net : des mises à jour KB5063878 et KB5062660 de Windows 11 causeraient des bugs avec certains SSD, notamment des modèles équipés de contrôleurs Ph...

Aurons-nous un jour le fin mot de l'histoire sur ce qui se passe réellement depuis le 17 aout 2025 et cette information qui a fait rapidement le tour du net : des mises à jour KB5063878 et KB5062660 de Windows 11 causeraient des bugs avec certains SSD, notamment des modèles équipés de contrôleurs Ph...

Ce Bon plan ne va évidemment pas s'adresser à beaucoup d'entre vous, mais si vous avez besoin d'une énorme quantité de RAM pour vos usages avancés et souhaiteriez ne pas non plus totalement vous ruiner, le tout sans vous retrouver avec une DDR5 aux performances asthmatiques, eh bien figurez-vous qu...

Ce Bon plan ne va évidemment pas s'adresser à beaucoup d'entre vous, mais si vous avez besoin d'une énorme quantité de RAM pour vos usages avancés et souhaiteriez ne pas non plus totalement vous ruiner, le tout sans vous retrouver avec une DDR5 aux performances asthmatiques, eh bien figurez-vous qu...

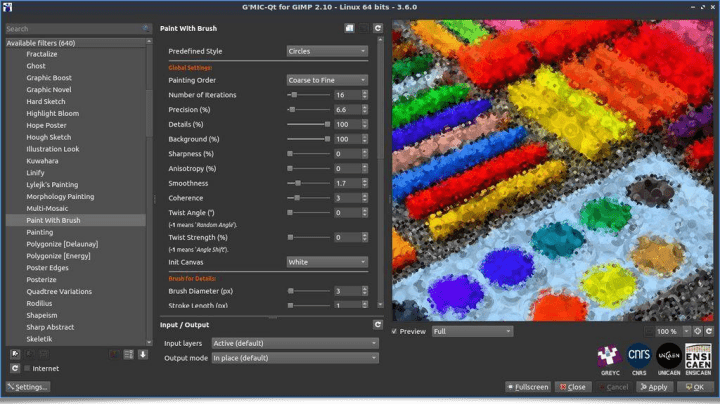

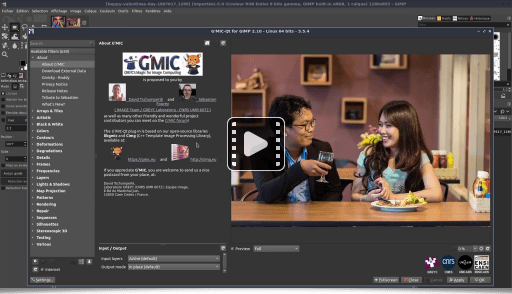

G’MIC, cadriciel libre pour le traitement des images numériques, vient de proposer une mise à jour significative, avec la sortie de sa nouvelle version 3.6.

Une bonne occasion pour nous de vous résumer les activités récentes autour de ce projet, et plus précisément, ce qu’il s’est passé depuis notre précédente dépêche, publiée il y a un peu plus d’un an (juin 2024).

N. D. A. : Cliquez sur les images pour en obtenir une version en pleine résolution, ou une vidéo correspondante lorsque les images contiennent l’icône ![]()

G’MIC (GREYC's Magic for Image Computing) est un projet libre dédié au traitement, la manipulation et la création d'images numériques. Il est développé principalement au sein de l’équipe IMAGE du laboratoire de recherche GREYC de Caen (laboratoire UMR, sous triple tutelle du CNRS, de l'ENSICAEN et de l'Université de Caen).

La base du projet repose sur un interpréteur de langage de script spécifique, le « langage G’MIC », pensé pour faciliter le prototypage rapide et l’implémentation d’algorithmes de traitement d’images. Autour de ce noyau viennent se greffer plusieurs interfaces utilisateur, qui donnent accès à des centaines d’opérateurs de traitement d’images, mais qui permettent également d’intégrer des pipelines de traitement personnalisés. G’MIC est donc conçu comme un cadriciel ouvert et extensible.

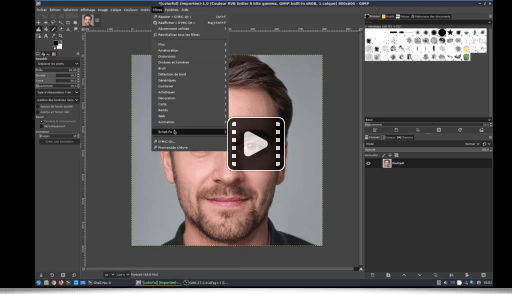

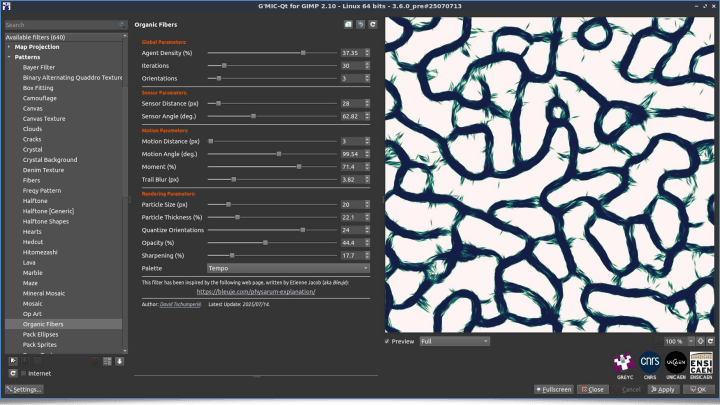

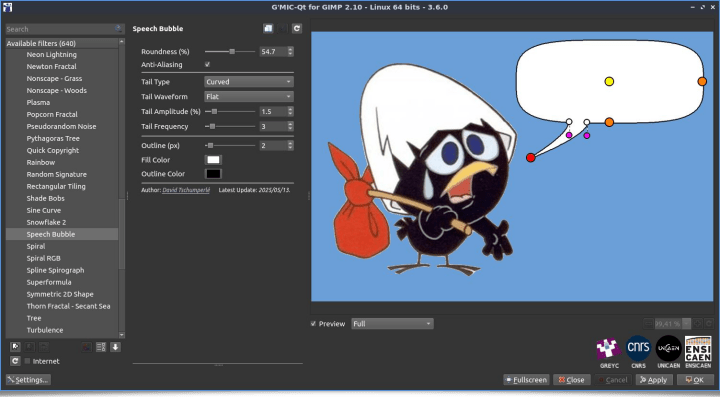

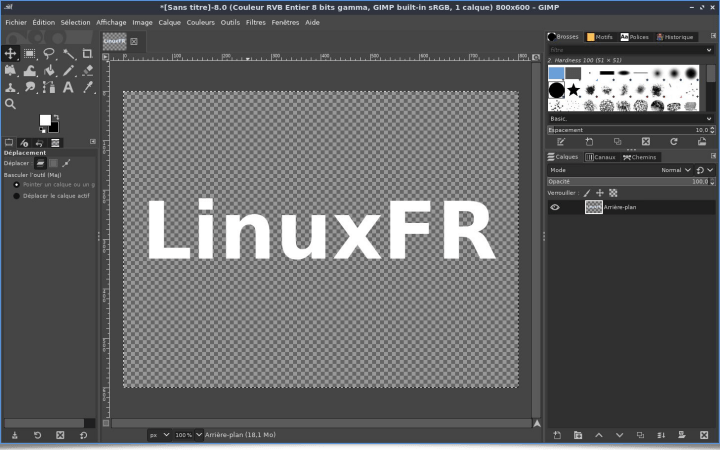

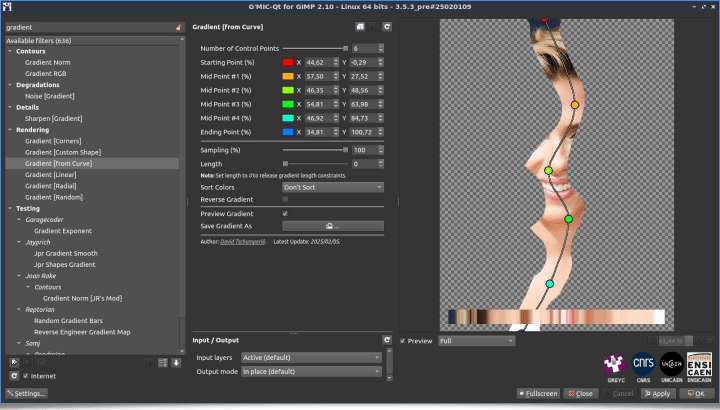

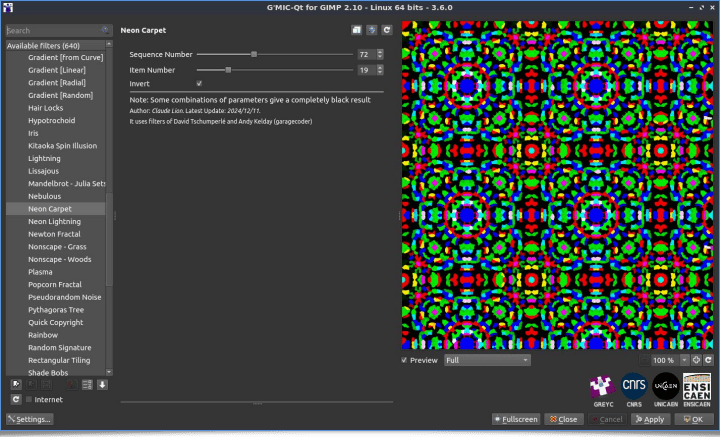

Parmi ses déclinaisons les plus utilisées, on retrouve : gmic, un outil en ligne de commande comparable et complémentaire à ImageMagick ou GraphicsMagick ; le service Web G’MIC Online ; et surtout le greffon G’MIC-Qt, intégrable dans de nombreux logiciels de création et d’édition d’images tels que GIMP, Krita, DigiKam, Paint.net, Adobe Photoshop ou Affinity Photo. Ce greffon est l’interface de G’MIC la plus populaire. Il donne aujourd’hui un accès rapide à plus de 640 filtres différents, élargissant considérablement les possibilités de filtres et d’effets offertes par ces logiciels de retouche d’images.

Fig. 1.1. Le greffon G’MIC-Qt en version 3.6, ici utilisé au sein de GIMP 2.10, avec le filtre « Paint With Brush » activé.

Fig. 1.1. Le greffon G’MIC-Qt en version 3.6, ici utilisé au sein de GIMP 2.10, avec le filtre « Paint With Brush » activé.

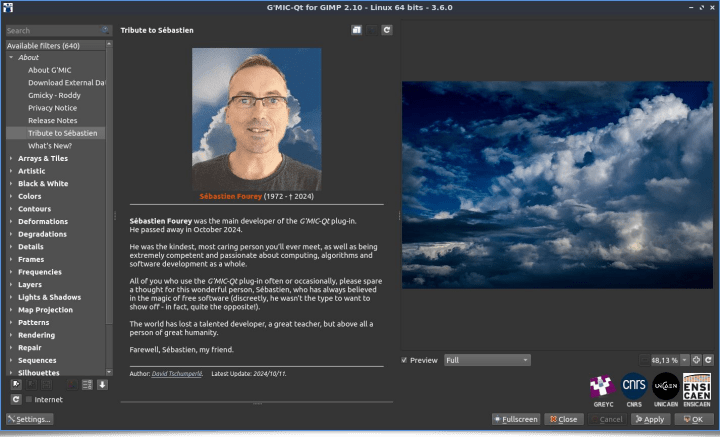

Avant de décrire la liste des nouveautés de cette version 3.6, nous souhaitons avant tout rendre hommage à notre collègue et ami, Sébastien Fourey, qui était maître de conférence à l’ENSICAEN et qui était le développeur principal du greffon G’MIC-Qt. Le 6 octobre 2024, Sébastien nous a quittés. Tous ceux qui le connaissaient vous le diront : Sébastien était avant tout une personne profondément humaine, généreuse et particulièrement attentive à tous ceux qui l’entouraient. Il était aussi discret et modeste qu’il était doué avec un clavier entre les mains (et c’était quelqu’un de très discret !).

Et même s’il n’a jamais voulu être mis au-devant de la scène, nous voulons ici faire une exception pour mettre en lumière son travail et le rôle majeur qu’il a eu dans le développement du projet G’MIC : c’est grâce à lui que G’MIC-Qt est aujourd’hui un greffon utilisé et apprécié par des milliers de personnes à travers le monde.

Il s’avère qu’il était un lecteur assidu de LinuxFr.org, et nous nous devions donc de lui rendre un hommage sur ce site. Sébastien nous manque profondément. Nous ferons notre possible pour que son œuvre perdure. Repose en paix, Sébastien ! Nous pensons à toi et à ta famille.

Fig. 2.1. Texte hommage à Sébastien Fourey, auteur de G’MIC-Qt, visible dans la section « About » du greffon.

Fig. 2.1. Texte hommage à Sébastien Fourey, auteur de G’MIC-Qt, visible dans la section « About » du greffon.

Comme vous vous en doutez, le développement spécifique du greffon G’MIC-Qt a été à l’arrêt depuis octobre dernier. Néanmoins, les derniers ajouts de code réalisés sur le greffon ont rendu possible les choses suivantes :

Son code source est désormais compatible avec l’API de plug-in de la nouvelle version majeure de GIMP (la 3.0). Cela a permis d’offrir aux utilisateurs de GIMP un greffon G’MIC-Qt fonctionnel dès la sortie de GIMP 3. Notons qu’assez peu de greffons ont proposé une mise à jour à temps (Resynthesizer, greffon populaire, étant une autre exception). On remercie donc chaleureusement Nils Philippsen et Daniel Berrangé qui ont soumis les patchs activant cette compatibilité avec GIMP 3. Nous continuons en parallèle à maintenir notre greffon pour l’ancienne version (2.10) de GIMP, qui est encore beaucoup utilisée.

Le code de G’MIC-Qt devient également compatible avec l’API de la bibliothèque Qt6, la dernière version majeure en date de ce toolkit graphique.

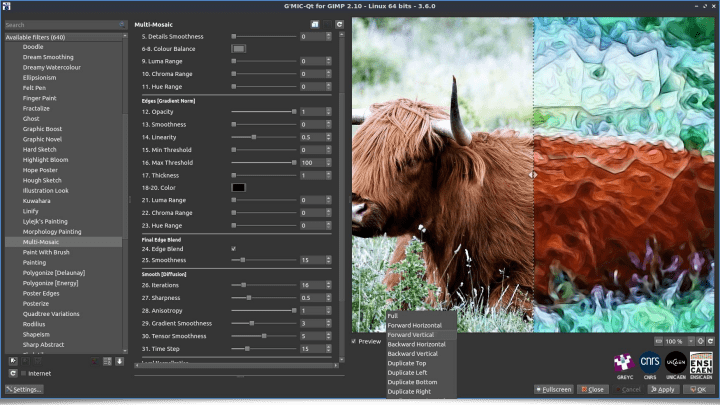

L’interface du greffon propose maintenant un outil de prévisualisation des filtres avec séparateur intégré, de manière native. Cette fonctionnalité, accessible via le raccourci clavier CTRL + SHIFT + P, permet de comparer directement l’image avant et après l’application d’un filtre, en affichant les deux versions côte à côte dans la fenêtre de prévisualisation. Cette fonctionnalité existait déjà, mais elle est dorénavant utilisable de manière plus fluide, puisqu’auparavant elle était implémentée indépendamment par chaque filtre (le séparateur de prévisualisation était en fait vu comme un paramètre du filtre, ce qui impliquait un recalcul complet du résultat du filtre même lorsque l’on souhaitait seulement déplacer le séparateur).

Fig. 2.2.1. Prévisualisation native de filtres avec séparateur intégré dans G’MIC-Qt.

Fig. 2.2.1. Prévisualisation native de filtres avec séparateur intégré dans G’MIC-Qt.

La vidéo suivante montre comment cette fonctionnalité améliorée se présente dans le greffon :

Fig. 2.2.2. Prévisualisation native de filtres avec séparateur intégré dans G’MIC-Qt (vidéo).

Fig. 2.2.2. Prévisualisation native de filtres avec séparateur intégré dans G’MIC-Qt (vidéo).

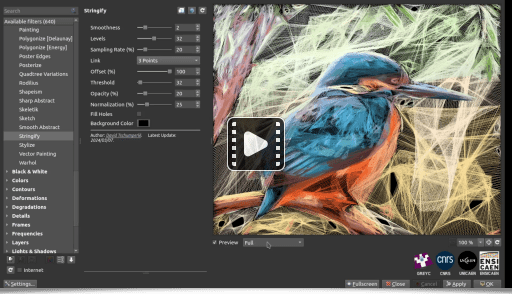

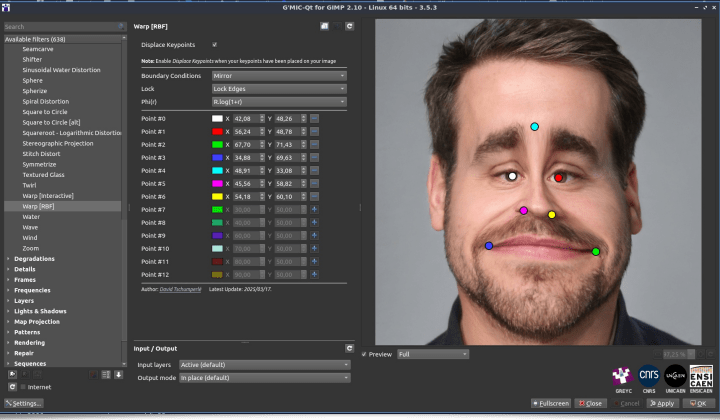

Les nouveautés principales du greffon G’MIC-Qt se matérialisent donc plutôt sous la forme de nouveaux filtres et effets accessibles pour les utilisateurs. À la sortie de cette version 3.6, c’est 640 filtres/effets différents qui sont proposés dans l’interface du greffon. En ce qui concerne le filtrage d’images, les dernières entrées ajoutées sont les suivantes :

Fig. 2.3.1. Le filtre « Deformations / Warp [RBF] » en action dans G’MIC-Qt.

Fig. 2.3.1. Le filtre « Deformations / Warp [RBF] » en action dans G’MIC-Qt.

La vidéo suivante montre son utilisation en pratique au sein du greffon G’MIC-Qt pour la déformation d’un visage :

Fig. 2.3.2. Le filtre « Deformations / Warp [RBF] » en action dans G’MIC-Qt (vidéo).

Fig. 2.3.2. Le filtre « Deformations / Warp [RBF] » en action dans G’MIC-Qt (vidéo).

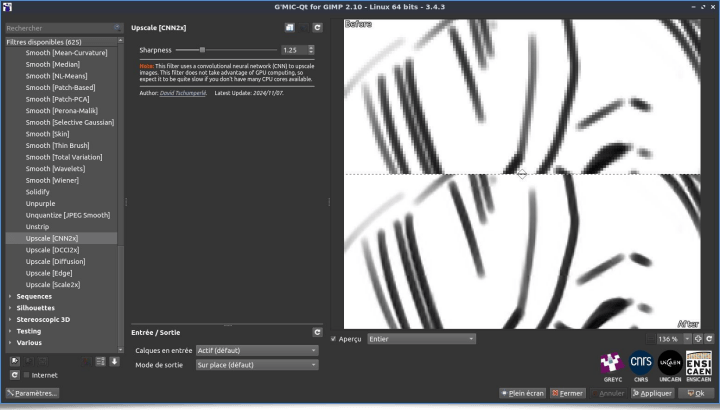

Fig. 2.3.3. Le filtre « Repair / Upscale [CNN2X] » en action dans G’MIC-Qt.

Fig. 2.3.3. Le filtre « Repair / Upscale [CNN2X] » en action dans G’MIC-Qt.

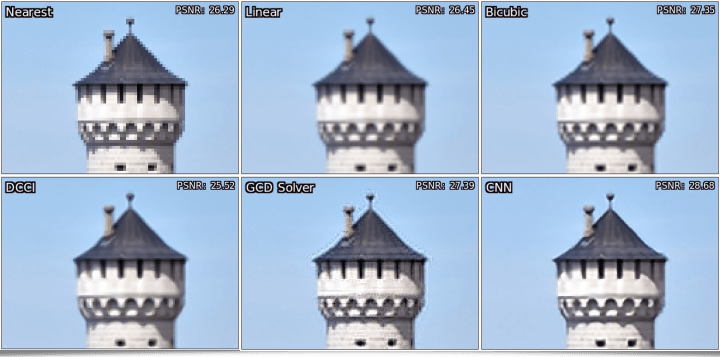

La figure suivante montre justement une comparaison des méthodes classiques d’agrandissement d’images, avec ce nouvel algorithme disponible dans G’MIC-Qt (résultat obtenu en bas à droite) :

Fig. 2.3.4. Comparaisons des méthodes d’agrandissement d’images avec notre nouvelle méthode « Upscale [CNN2X] ».

Fig. 2.3.4. Comparaisons des méthodes d’agrandissement d’images avec notre nouvelle méthode « Upscale [CNN2X] ».

Notons que ce filtre illustre à lui seul quelques avancées récentes réalisées pour la nn_lib, qui est la petite bibliothèque interne d’apprentissage machine intégrée à G’MIC : Clipping des gradients, régularisation L2 des poids des réseaux, planificateur Cosine Annealing LR pour le taux d’apprentissage, module de Pixel Shuffling, sont quelques-unes des nouvelles fonctionnalités qui y ont été ajoutées. Cette bibliothèque de gestion de réseaux de neurones n’est pas très puissante (elle n’utilise que le calcul CPU, pas GPU), mais elle offre néanmoins la possibilité de créer des filtres intéressants basés sur des techniques d’apprentissage statistique.

Fig. 2.3.5. Le filtre « Degradations / VHS Filter » en action.

Fig. 2.3.5. Le filtre « Degradations / VHS Filter » en action.

Ce filtre génère un bruit aléatoire, donc l’appliquer plusieurs fois sur une même image donne à chaque fois un rendu différent. On peut donc ainsi synthétiser de petites animations avec un look « analogique - années 90 » du plus bel effet. Les amateurs de Glitch Art apprécieront ! (voyez l’image originale à titre de comparaison).

Fig. 2.3.6. Le filtre « Degradations / VHS Filter » appliqué plusieurs fois sur une même image, pour en faire une séquence vidéo de type VHS.

Fig. 2.3.6. Le filtre « Degradations / VHS Filter » appliqué plusieurs fois sur une même image, pour en faire une séquence vidéo de type VHS.

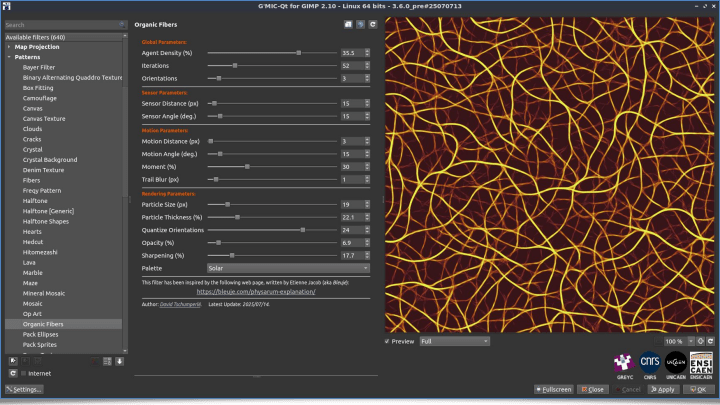

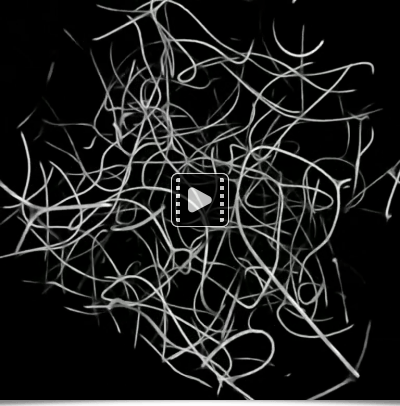

De nouveaux effets font également leur apparition dans le greffon, non pas dans le but de modifier une image existante, mais pour créer une nouvelle image ou un motif à partir de zéro :

Fig. 2.4.1. Le filtre « Patterns / Organic Fibers » en action, avec deux jeux de paramètres différents.

Fig. 2.4.1. Le filtre « Patterns / Organic Fibers » en action, avec deux jeux de paramètres différents.

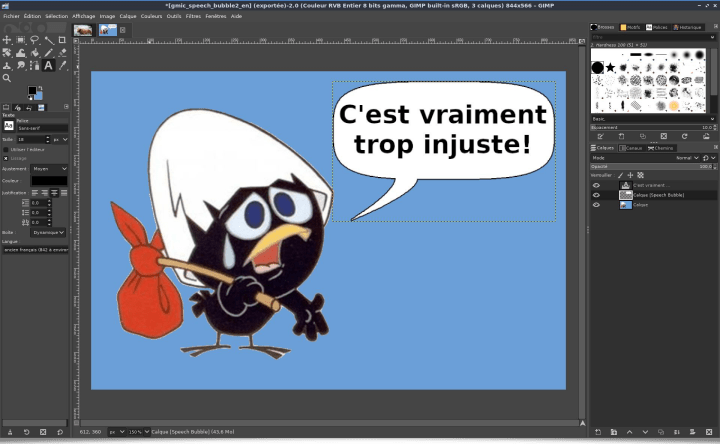

Fig. 2.4.2. Le filtre « Rendering / Speech Bubble » permet d’ajouter des bulles de dialogue dans vos images.

Fig. 2.4.2. Le filtre « Rendering / Speech Bubble » permet d’ajouter des bulles de dialogue dans vos images.

La vidéo ci-dessous présente ce filtre en action dans le greffon G’MIC-Qt sur une photographie :

Fig. 2.4.3. Le filtre « Rendering / Speech Bubble » en action dans le greffon (vidéo).

Fig. 2.4.3. Le filtre « Rendering / Speech Bubble » en action dans le greffon (vidéo).

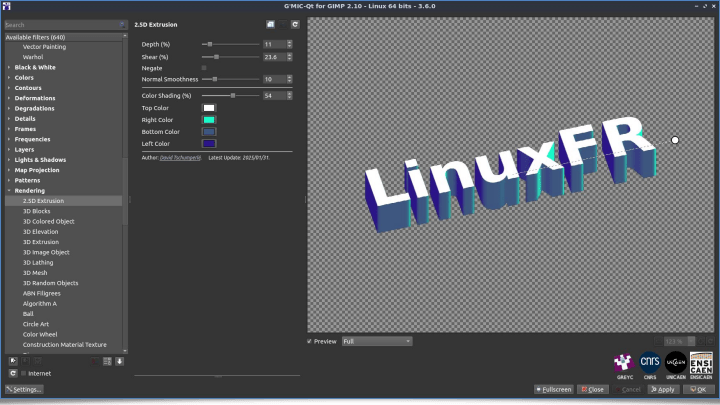

Fig. 2.4.4. Le filtre « Rendering / 2.5D Extrusion » en action.

Fig. 2.4.4. Le filtre « Rendering / 2.5D Extrusion » en action.

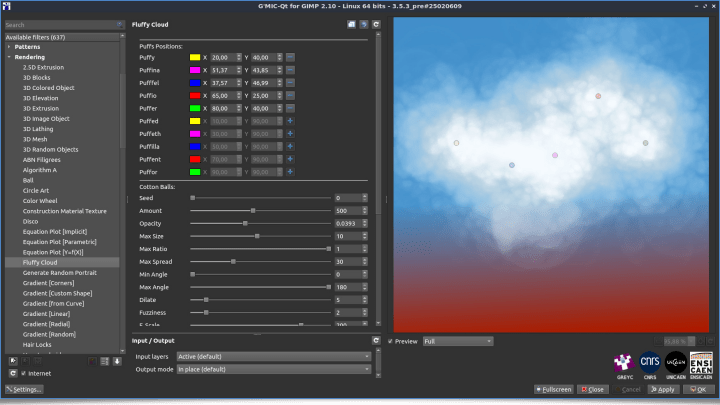

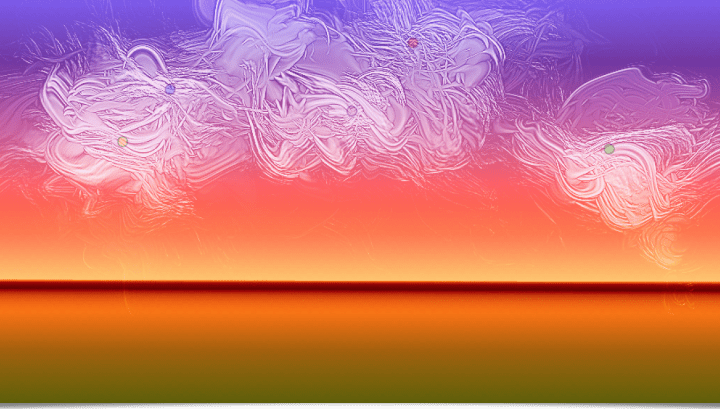

Fig. 2.4.5. Le filtre « Rendering / Fluffy Cloud » dans le greffon _G’MIC-Qt._

Fig. 2.4.5. Le filtre « Rendering / Fluffy Cloud » dans le greffon _G’MIC-Qt._

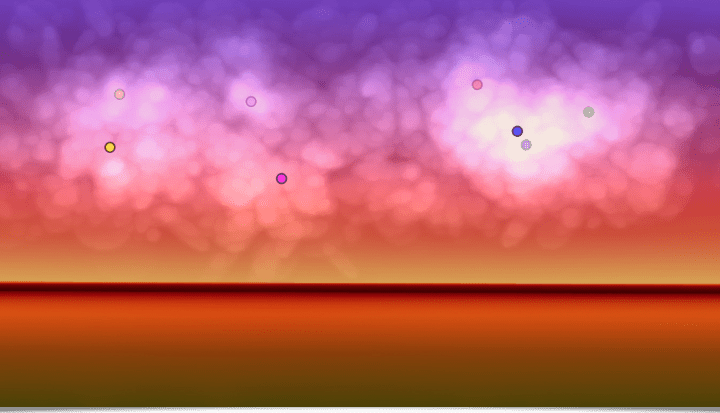

En jouant avec les différents paramètres du filtre, on peut obtenir des rendus variés et intéressants :

Fig. 2.4.6. Différents rendus de « Rendering / Fluffy Cloud » en faisant varier les paramètres du filtre.

Fig. 2.4.6. Différents rendus de « Rendering / Fluffy Cloud » en faisant varier les paramètres du filtre.

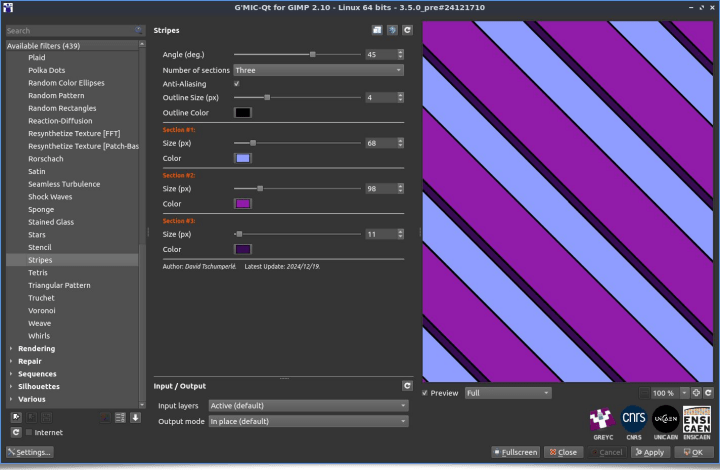

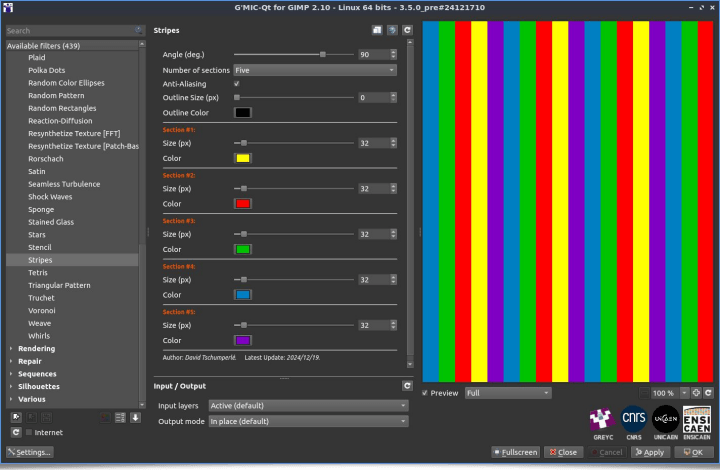

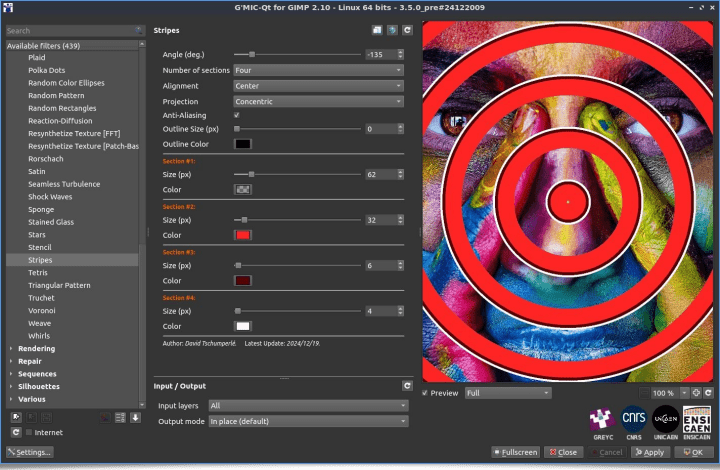

Fig. 2.4.7. Trois exemples de motifs à rayures générés par le filtre « Patterns / Stripes ».

Fig. 2.4.7. Trois exemples de motifs à rayures générés par le filtre « Patterns / Stripes ».

Fig. 2.4.8. Le filtre « Patterns / Gradient [from Curve] » extrait les couleurs d’une image localisées le long d’une courbe spline.

Fig. 2.4.8. Le filtre « Patterns / Gradient [from Curve] » extrait les couleurs d’une image localisées le long d’une courbe spline.

Fig. 2.4.9. Le filtre « Rendering / Neon Carpet », une contribution de Cli435.

Fig. 2.4.9. Le filtre « Rendering / Neon Carpet », une contribution de Cli435.

Voilà pour ce qui concerne les nouveautés spécifiques au greffon G’MIC-Qt.

Passons maintenant à la description du travail réalisé cette année pour l’amélioration du cœur du projet, à savoir l’interpréteur G’MIC et sa bibliothèque standard d’opérateurs. Ce sont forcément des améliorations un peu moins visibles pour l’utilisateur final, mais elles sont toutes aussi importantes, car elles consolident ou améliorent des fonctionnalités qui peuvent ouvrir plus tard la porte au développement de nouveaux filtres originaux.

Le moteur interne de G’MIC a bénéficié d’une série d’optimisations notables. Plusieurs améliorations internes, concernant l’analyse, la détection et la concaténation de chaînes de caractères ou encore la recherche de valeurs min/max dans de grandes images (désormais parallélisée avec OpenMP), ont permis d’augmenter légèrement les performances (gain moyen d’environ 2,5% sur le temps d’exécution de scripts G’MIC). Ce n’est pas un gain spectaculaire, mais ça se prend (et après 17 ans à écrire du code pour cet interpréteur, il aurait été presque inquiétant d’obtenir un gain beaucoup plus important ! 😊).

Sous Windows, la compilation de l’interpréteur utilise désormais Clang et sa libc associée, ce qui produit des exécutables légèrement plus optimisés.

Le moteur de rendu 3D intégré de G’MIC a également été amélioré, avec l’ajout du z-clipping pour les primitives hors champ, un calcul d’éclairage affiné, la correction du rendu de normales 3D avec le mode d’éclairage Phong, et l’ajustement des paramètres de réflexion spéculaire.

Une nouvelle commande multithreaded3d (raccourcie en mt3d) permet désormais d’activer ou désactiver le rendu 3D multi-threadé (là encore par OpenMP). Cela permet d’accélérer considérablement l’affichage de gros maillages.

Mentionnons au passage l’apparition de la commande normals3d dans la bibliothèque standard, dont le rôle est d’estimer les vecteurs normaux unitaires d’un maillage 3D, que ce soit au niveau des sommets ou des primitives. La figure suivante illustre par exemple l’utilisation de cette commande pour la visualisation de vecteurs normaux à la surface d’un tore 3D :

Fig. 3.2.1. La commande

Fig. 3.2.1. La commande normals3d permet d’estimer les vecteurs normaux 3D aux sommets ou aux faces d’un maillage 3D.

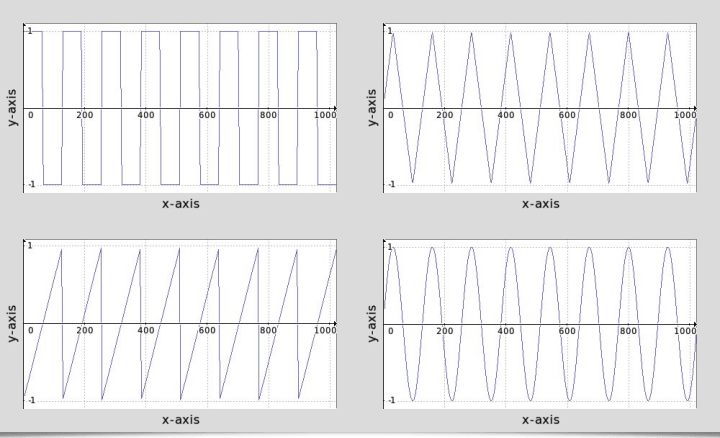

L’évaluateur d’expressions mathématiques intégré à G’MIC est l’une des pièces maîtresses du projet (en traitement d’images, on doit souvent réaliser beaucoup de calculs…). Il continue lui aussi de s’enrichir et de gagner en efficacité.

Sans rentrer dans trop de détails techniques, notons que l’analyse syntaxique des expressions a été optimisée grâce à une première passe dédiée à la détection de certains opérateurs, afin d’accélérer leur traitement ultérieur. De nombreuses fonctions font leur apparition, parmi elles, epoch() pour convertir une date en temps Unix, frac() pour extraire la partie fractionnaire d’un nombre, ou encore wave() qui permet de générer différentes fonctions ou images périodiques (sinusoïdales, triangulaires, etc.), comme illustré sur la figure ci-dessous :

Fig. 3.3.1. La nouvelle fonction

Fig. 3.3.1. La nouvelle fonction waves() permet de générer facilement des fonctions d’ondes, fonctions dont la fréquence d’apparition (hoho ! calembour de traiteur de signal !) est assez élevée dans les opérateurs de traitement d’images.

Quelques améliorations sont également à signaler au niveau de la gestion des entrées-sorties :

En ce qui concerne l’évolution de la bibliothèque standard de G'MIC, la nouveauté la plus significative concerne la réécriture de la commande pack_sprites, qui implémente un algorithme d’«empaquetage» d’objets. Pour rappel, ce type d’algorithmes permet de générer des visuels composés d’ensemble d’imagettes disjointes placées de telle façon à reproduire une forme binaire (un masque) de géométrie quelconque.

Cette ré-implémentation est à la fois plus rapide et plus efficace (utilisant de meilleures heuristiques de placement), et permet d’optimiser l’agencement des imagettes à différentes échelles et orientations tout en réduisant le temps de génération. Une illustration valant mieux qu’un long discours, voici le genre d’images amusantes que cet algorithme est capable de produire facilement :

![]()

![]() Fig. 3.5.1. Deux exemples de génération possibles utilisant la commande «

Fig. 3.5.1. Deux exemples de génération possibles utilisant la commande « pack_sprites ».

Les sprites à empaqueter peuvent être de formes quelconques, comme des lettres (image du haut de la figure précédente), des mots entiers (image du bas), etc.

Et quoi de mieux qu’un exemple concret pour montrer la facilité déconcertante 😉 d’utilisation de cette commande pack_sprites ? Le but ici est d’écrire le texte « ♥LinuxFR♥ » de telle sorte que chaque lettre soit générée comme un empaquetage d’elle-même ! (idée suffisamment saugrenue pour qu’un filtre « clé en main » réalisant ceci n’existe pas déjà !).

Le script G’MIC suivant (fichier test_pack_sprites.gmic), une fois rendu exécutable, réalise cette tâche :

#!/usr/bin/env gmic

str="0LinuxFR0"

repeat size(['$str']) {

l:=['$str'][$>]

0 text. {`$l`},0,0,${"font titanone,480"},1,1 ==. 0 channels. -3,0

0 text. {`$l`},0,0,${"font titanone,64"},1,${"-RGB"},255

pack_sprites.. .,5,25,3,1 remove.

}

append x to_rgb

output out.png

displayLa génération prend quelques secondes, et aboutit à une image de ce type :

![]() Fig. 3.5.2. Résultat du lancement du script

Fig. 3.5.2. Résultat du lancement du script test_pack_sprites.gmic.

Amusant, n’est-ce pas ? Comment feriez-vous pour réaliser la même chose dans un autre langage (et combien de lignes de code cela prendrait-il ? 😉).

L’exemple précédent est réellement représentatif des possibilités d’écriture de scripts personnalisés permis par G'MIC. Saviez-vous, par exemple, que l’ensemble des 640 filtres disponibles dans le greffon G’MIC-Qt sont justement écrits dans ce langage ?

G’MIC peut ainsi être considéré comme une boite à outils étoffée pour les personnes souhaitant se frotter au code créatif et à l'art génératif. Nous vous proposons ci-dessous quelques autres exemples simples de génération d’images par scripts G’MIC, afin de donner un aperçu rapide des possibilités et de la concision de ce langage.

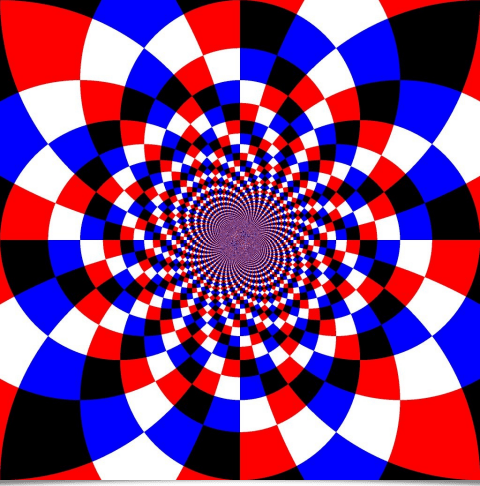

invert_checkerboard :

4096,4096,1,1,"

L = clog(20*([x,y]/w - 0.5));

P = cexp([log(40/exp(L[0])),L[1]]);

85*xor(P[0]%4,P[1]%4)"

map 6 rescale2d 50% Fig. 4.1.1. Génération d’un damier inversé, avec la commande personnalisée

Fig. 4.1.1. Génération d’un damier inversé, avec la commande personnalisée invert_checkerboard.

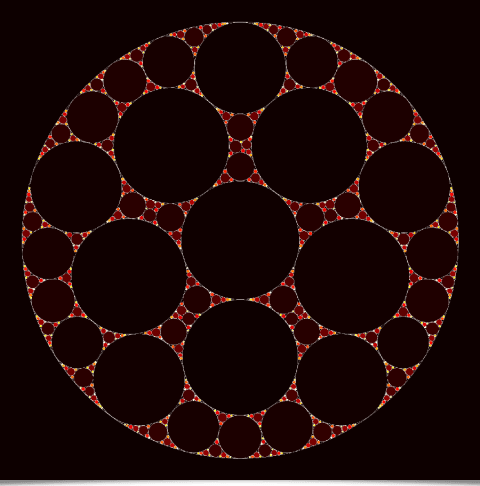

apollonian_gasket :

# Init.

siz=1280 rad:=$siz/2.2

$siz,$siz,1,2

circle {[$siz,$siz]/2},$rad,1,1

repeat 5 { circle {[$siz,$siz]/2+0.537*$rad*cexp([0,90°+$>*72°])},{0.316*$rad},1,0,{2+$>} }

# Iterate.

ind=4 e " > Computing"

do {

sh 0 +distance. 0 x,y,r:="x = xM; y = yM; [ x,y,i(x,y) - 1 ]" rm[-2,-1]

circle $x,$y,$r,1,0,$ind ind+=1

e "\r > Computing "{`c=arg0(int($>/10)%4,124,47,45,92);[c,c==92?92:0]`}

} while $r>3

# Decorate.

k. channels 100%

+n. 0,255 map. hot

l[0] { g xy,1 a c norm != 0 * 255 to_rgb }

max rs 80%Et voici le résultat :

Fig. 4.1.2. Génération de cercles d’Apollonius, avec la commande personnalisée

Fig. 4.1.2. Génération de cercles d’Apollonius, avec la commande personnalisée apollonian_gasket.

gaussians3d :

180,180,160,3

2000,1,1,1,":

draw_gauss3d(ind,xc,yc,zc,u,v,w,siz,anisotropy,R,G,B,A) = (

unref(dg3d_mask,dg3d_one,dg3d_rgb,dg3d_isiz2);

dg3d_vU = unitnorm([ u,v,w ]);

dg3d_vUvUt = mul(dg3d_vU,dg3d_vU,3);

dg3d_T = invert(dg3d_vUvUt + max(0.025,1 - sqrt(anisotropy))*(eye(3) - dg3d_vUvUt));

dg3d_expr = string('T = [',v2s(dg3d_T),']; X = ([ x,y,z ] - siz/2)/siz; exp(-12*dot(X,T*X))');

dg3d_mask = expr(dg3d_expr,siz,siz,siz);

dg3d_rgb = [ vector(##siz^3,R),vector(##siz^3,G),vector(##siz^3,B) ];

const dg3d_isiz2 = int(siz/2);

draw(#ind,dg3d_rgb,xc - dg3d_isiz2,yc - dg3d_isiz2,zc - dg3d_isiz2,0,siz,siz,siz,3,A/255,dg3d_mask);

# Trick: These two lines allow to generate a perfectly looping animation.

draw(#ind,dg3d_rgb,xc - dg3d_isiz2,yc - dg3d_isiz2,zc - dg3d_isiz2 + d#0/2,0,siz,siz,siz,3,A/255,dg3d_mask);

draw(#ind,dg3d_rgb,xc - dg3d_isiz2,yc - dg3d_isiz2,zc - dg3d_isiz2 - d#0/2,0,siz,siz,siz,3,A/255,dg3d_mask);

);

X = [ u([w#0,h#0] - 1),u(d#0/4,3*d#0/4) ];

U = unitnorm([g,g,g]);

siz = v(5);

anisotropy = u(0.6,1);

R = u(20,255);

G = u(20,255);

B = u(20,255);

A = u(20,255)/(1 + siz)^0.75;

siz==0?draw_gauss3d(#0,X[0],X[1],X[2],U[0],U[1],U[2],11,anisotropy,R,G,B,A):

siz==1?draw_gauss3d(#0,X[0],X[1],X[2],U[0],U[1],U[2],21,anisotropy,R,G,B,A):

siz==2?draw_gauss3d(#0,X[0],X[1],X[2],U[0],U[1],U[2],31,anisotropy,R,G,B,A):

siz==3?draw_gauss3d(#0,X[0],X[1],X[2],U[0],U[1],U[2],41,anisotropy,R,G,B,A):

siz==4?draw_gauss3d(#0,X[0],X[1],X[2],U[0],U[1],U[2],51,anisotropy,R,G,B,A):

draw_gauss3d(#0,X[0],X[1],X[2],U[0],U[1],U[2],61,anisotropy,R,G,B,A)"

rm.

rs 250%,250%,6 c 0,255 normalize_local , n 0,255

slices {[d/4,3*d/4-1]} Fig. 4.1.3. Volume de gaussiennes 3D anisotropes, vues comme une séquence vidéo.

Fig. 4.1.3. Volume de gaussiennes 3D anisotropes, vues comme une séquence vidéo.

Regardez ça en plein écran pendant 20 minutes avant d’aller vous coucher, en écoutant du Pink Floyd, et je vous garantis une bonne nuit de sommeil !

Fig. 4.1.3. Animation d’un cube 3D roulant.

Fig. 4.1.3. Animation d’un cube 3D roulant.

Le code source de cet effet est un peu plus long que pour les exemples précédents, et nous ne l’intégrons donc pas directement dans cette dépêche. Mais en 47 lignes seulement, cela reste tout à fait raisonnable 😊 !

Et si comme moi, vous prenez plaisir à regarder ou réaliser des images ou animations amusantes/étranges qui sont générées en quelques lignes de code seulement, alors n’hésitez pas à aller jeter un œil au fil de discussion dédié, sur le forum officiel de G’MIC : Creative Coding with G’MIC.

Les possibilités offertes par G’MIC pour le code créatif nous ont récemment décidé à initier une petite série de dépêches, intitulées « G’MIC Adventures ». L’idée de cette série est d’expliquer et d’illustrer les différentes étapes qui vont du concept à l’implémentation d’un effet de code créatif sous forme d’un script G’MIC. Aujourd’hui, cette série comporte seulement 4 épisodes, mais nous espérons l’enrichir dans le futur. Ces épisodes sont les suivants :

G’MIC Adventures #1: A fake 3D extrusion filter (2.5D) : Cet épisode explique comment le filtre d’extrusion 2.5D présenté précédemment (Fig. 2.4.4) a été imaginé et implémenté.

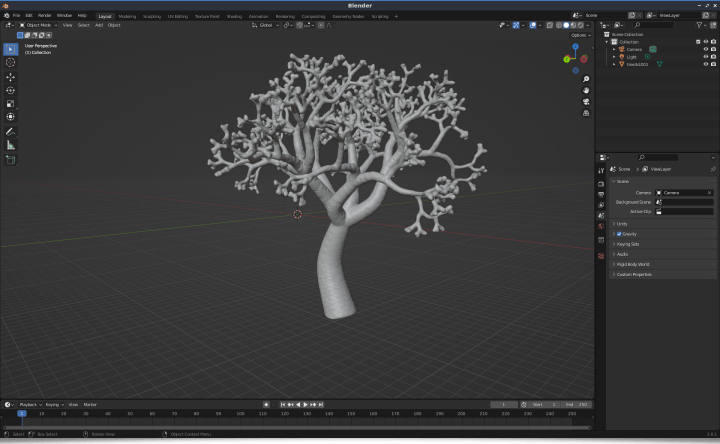

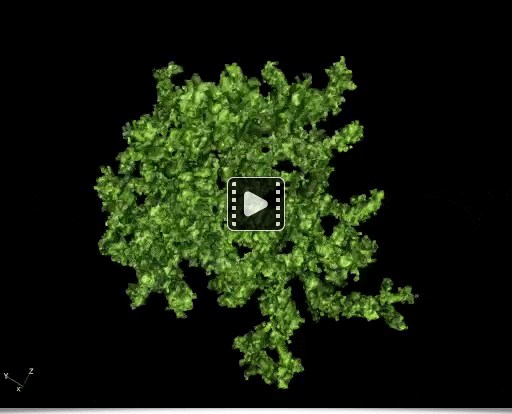

G’MIC Adventures #2: Building 3D trees : Dans cet épisode, nous montrons comment implémenter la génération d’un arbre 3D fractal (plus précisément une variante 3D d’une canopée fractale), de manière procédurale, afin de produire des maillages 3D d’arbres aléatoires.

Fig. 4.2.1. Génération d’un arbre fractal 3D par G’MIC, réimporté ensuite sous Blender.

Fig. 4.2.1. Génération d’un arbre fractal 3D par G’MIC, réimporté ensuite sous Blender.

Fig. 4.2.2. Exemple d’arbre fractal 3D généré par G’MIC (vidéo).

Fig. 4.2.2. Exemple d’arbre fractal 3D généré par G’MIC (vidéo).

Fig. 4.2.3. Espèce de mousse de forêt synthétique, générée par agrégation de particules en 3D. L’inhalation volontaire de vapeurs provenant de cette mousse est fortement déconseillée !

Fig. 4.2.3. Espèce de mousse de forêt synthétique, générée par agrégation de particules en 3D. L’inhalation volontaire de vapeurs provenant de cette mousse est fortement déconseillée !

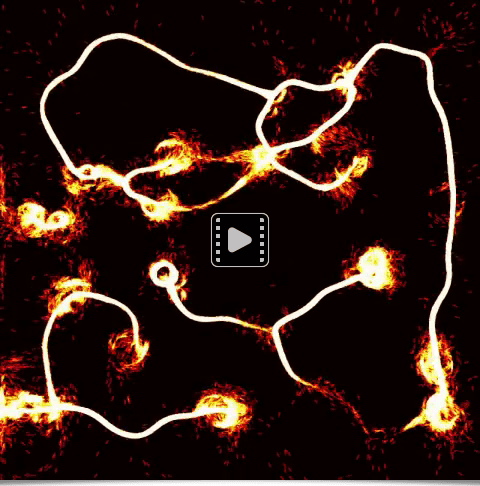

Fig. 4.2.4. Danses de filaments enflammés, générées par l’algorithme Physarum en 2D.

Fig. 4.2.4. Danses de filaments enflammés, générées par l’algorithme Physarum en 2D.

Dans cet épisode, nous proposons également une extension 3D de cet algorithme, ce qui permet de générer ce type d’animation :

Fig. 4.2.4. Évolution de l’algorithme Physarum étendu en 3D.

Tous ces épisodes cherchent à montrer que G’MIC est une boite à outils générique, plutôt sympa à utiliser, pour le prototypage créatif destiné à la génération d’images et d’animations !

Nous voilà déjà arrivés à la cinquième section de cette dépêche, signe qu’il est probablement temps de la terminer au plus vite 😉. Pour finir, voici donc quelques informations et liens supplémentaires pour approfondir la découverte du projet G’MIC :

Mentionnons également que G’MIC possède maintenant des comptes (clonés) sur les réseaux sociaux X et Bluesky, en complément du compte principal sur Mastodon. Ceci tout simplement, car nous avons découvert l’existence d’outils de publications croisées 😊. Nous utilisons essentiellement ces réseaux sociaux pour donner des nouvelles fréquentes du projet et de son évolution. N’hésitez donc pas à vous y abonner si suivre les actualités du projet vous intéresse !

Et pour finir, une liste de liens que nous avons trouvé intéressants :

La sortie de cette version 3.6 (et plus généralement l’année 2025) représente une étape importante dans la vie du projet G'MIC.

Tout d’abord parce qu’on se rend bien compte qu’après 17 ans de développement, G’MIC est maintenant stable, et qu’il est peut-être plus temps d’en valoriser les facettes existantes, plutôt que de chercher à implémenter à tout prix de nouvelles fonctionnalités. D’autre part, car la disparition de l’ami Sébastien, en plus d’avoir été un choc émotionnel majeur, risque de rendre difficile la maintenance et l’évolution future du greffon G’MIC-Qt. Et enfin, car avec la démocratisation de l’IA générative, les domaines de l’analyse, du traitement et de la génération d’images (notamment à des fins créatives) sont en profonde mutation, et que les fonctionnalités de G’MIC pourraient très bien être considérées comme obsolètes d’ici quelques années (ou pas 😊).

Au final, que d’incertitudes et de questionnements ! Cela rend floues les directions à prendre pour l’évolution de G’MIC, d’autant que s’occuper d’un tel projet requiert beaucoup d’investissements en temps, et qu’en même temps, sa valorisation financière est aujourd’hui inexistante.

Actuellement, G’MIC est téléchargé un peu plus de 1000 fois par jour depuis la page web principale du projet (donc sans compter les installations tierces : via l’installation de Krita, via les paquets officiels des distributions, etc.). C’est un chiffre très honorable pour un logiciel libre de ce type, développé au sein d’un laboratoire public de recherche tel que le GREYC, et qui plus est, qui n’est plus maintenu que par une seule personne.

À court terme, on se focalisera probablement sur la promotion et la visibilité du cadriciel, la maintenance du code et l’animation de la communauté, par exemple en écrivant quelques tutoriels illustrant ses nombreuses applications potentielles dans les domaines variés liés à l’imagerie numérique : retouche photographique, illustration, peinture numérique, imagerie scientifique (médical, astronomie, biologie, matériaux), création graphique, art génératif, etc.

À long terme, peut-on raisonnablement espérer faire plus de G’MIC avec ce peu de ressources ?

L’avenir nous le dira !

Commentaires : voir le flux Atom ouvrir dans le navigateur

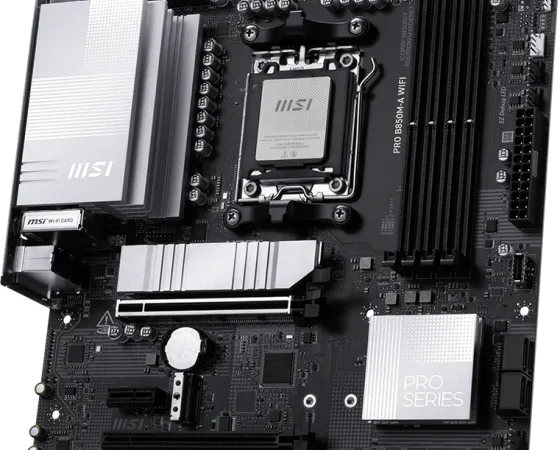

La carte mère est généralement l'un des composants les plus difficiles à choisir quand on monte une nouvelle configuration, tant il y a de références sur le marché et de nombreux détails pour les départager. Thibaut vous en présente régulièrement dans ses analyses de cartes mères sur H&Co pour v...

La carte mère est généralement l'un des composants les plus difficiles à choisir quand on monte une nouvelle configuration, tant il y a de références sur le marché et de nombreux détails pour les départager. Thibaut vous en présente régulièrement dans ses analyses de cartes mères sur H&Co pour v...