Argentine : OpenAI lance un nouveau projet Stargate dans un contexte controversé

Régimen de Incentivo para Grandes Inversiones

OpenAI et Sur Energy ont signé une lettre d’intention pour un nouveau projet de centre de données à 25 milliards de dollars.

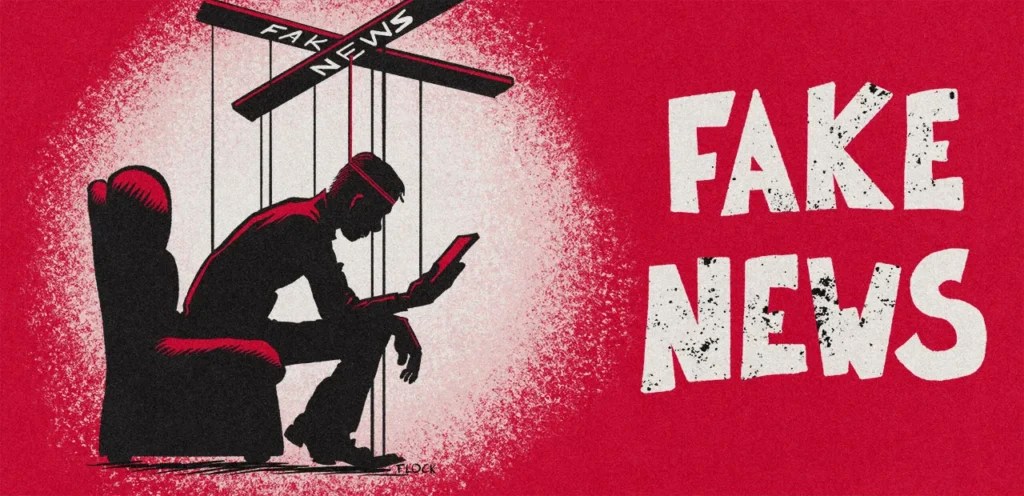

« Aujourd’hui, nous sommes heureux d’annoncer le lancement de Stargate Argentina », déclare Sam Altman dans une vidéo visiblement lue depuis son écran. À moins, suggère la chercheuse Milagros Miceli, qu’il ne s’agisse d’un deepfake.

Derrière le nom de Stargate Argentina se cache pour le moment un projet de centre de données à 25 milliards de dollars, qui devrait être construit en Patagonie. Évoquant une « opportunité historique » de faire de l’Argentine un « acteur clé dans le nouveau paysage numérique et énergétique mondial », le gouvernement argentin précisait le 10 octobre qu’une lettre d’intention avait été signée entre OpenAI et l’entreprise argentino-états-unienne Sur Energy, pour alimenter le futur bâtiment.

Celui-ci pourrait atteindre une capacité de 500 mégawatts, indiquent les diverses annonces officielles, quand bien même ce type d’élément relève plus du marketing que de la réelle indication.

Stargate 2, le retour…

Inspiré du film éponyme, le nom Stargate fait ici référence au premier projet de grande ampleur lancé par OpenAI aux États-Unis. Au lendemain de la seconde investiture de Donald Trump, Sam Altman se retrouvait aux côtés du patron d’Oracle Larry Ellison dans le bureau ovale pour annoncer un plan à 500 milliards de dollars, selon lequel OpenAI, Oracle, Arm, Microsoft et NVIDIA s’associeraient pour construire de nouvelles infrastructures dédiées à l’intelligence artificielle.

Six mois plus tard, cette première annonce retentissante – au point de créer de très publiques frictions entre Sam Altman et Elon Musk – s’annonçait relativement complexe. En juillet, toujours aucun contrat n’avait été signé par la coentreprise créée pour l’occasion.

Régime fiscal controversé

En Argentine, la porte des étoiles voulue par OpenAI sera donc 20 fois plus modeste en termes financiers. Sa localisation précise n’est pas indiquée. Le projet est, en revanche, tout aussi soutenu par Javier Milei que sa version américaine l’a été par Donald Trump.

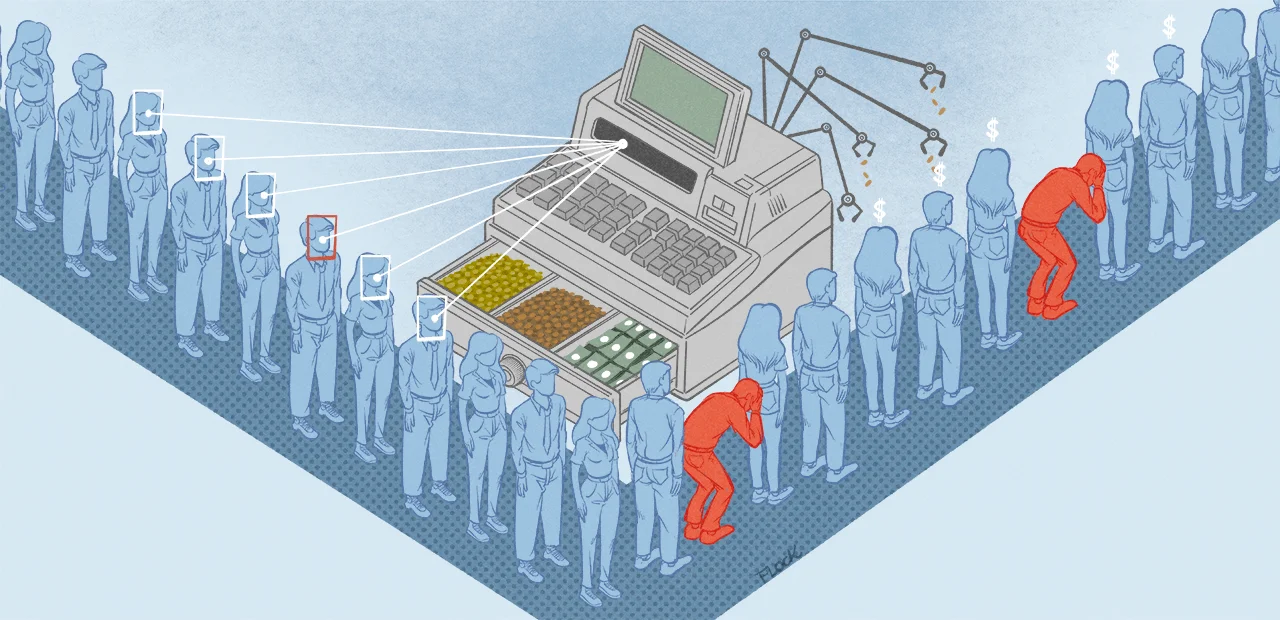

L’alliance entre OpenAI et Sur Energy est, par ailleurs, construite dans le cadre du Régime d’incitation pour les grands investissements (RIGI), un système pensé par le gouvernement Milei pour favoriser les investissements de plus de 200 millions de dollars en Argentine, en échange d’avantages fiscaux. Adopté en 2024, ce régime est controversé pour les facilités qu’il crée aux industries fossiles, minières (l’Argentine est aussi l’un des principaux producteurs de lithium), sidérurgiques ou encore touristiques, et pour les conséquences que le développement de ces diverses activités peuvent avoir sur les droits humains et l’environnement.

En l’espèce, grâce au RIGI, OpenAI sera « exempté de payer des impôts, d’embaucher de la main-d’œuvre locale et d’acheter du matériel argentin », liste Milagros Miceli sur LinkedIn. Et de comparer ce projet à d’autres investissements de géants numériques états-uniens dans d’autres pays du globe, que ce soit au Chili, où la population a finalement fait bloquer un projet de centre de données de Google pour protéger ses ressources en eau, ou au Mexique, où les infrastructures électriques sont soumises à une importante pression par le déploiement des infrastructures liées à l’IA.

Si ce projet de centre de données se confirme, il viendra grossir les rangs des multiples partenariats signés ces derniers mois par OpenAI, au point de placer la société d’intelligence artificielle au sein d’un réseau de mille milliards de dollars de contrats variés.