Linux 7.0 Kernel Confirmed By Linus Torvalds, Expected In Mid-April 2026

Read more of this story at Slashdot.

Read more of this story at Slashdot.

Proton 10 est disponible, pour être exact, c’est la version 10.0-4 qui vient de débarquer. Proton est la couche logicielle qui traduit les instructions de programmation des jeux sous Linux afin qu’ils puissent être interprétés par Linux. Développé par Valve sur la base des travaux de Wine, le code a offert au Steam Deck la possibilité de lancer des milliers de jeux Windows sous SteamOS.

Les travaux effectués sur Proton 10 et ses prédécesseurs ont évidemment débordé de la petite console de Valve et touchent aujourd’hui la quasi-totalité des PC sous Linux. De nombreux éléments sont mis à jour techniquement et pourront donc dialoguer avec de multiples configurations. On parle des composants SteamWorks SDK 1.63, de Wine Mono v10.4.1 et des versions VKD3D-Proton 3.0b et VKD3D 1.18. Tous ces éléments étant autant de traducteurs entre les jeux développés sous Windows et le système DirectX et le monde Linux.

C’est ce qui est amusant avec Windows aujourd’hui. DirectX a été forgé comme l’Anneau de Sauron. Un système pour unifier tous les univers du jeu PC et les rendre performant. Permettant aux différents éditeurs de profiter de toutes les ressources de Windows et de dialoguer plus facilement avec les composants proposés. Mais enfermant également ces mêmes éditeurs dans la main de Microsoft. Ce qui a été une force pour l’éditeur pendant de nombreuses années. Tout le temps où aucun constructeur n’a voulu prendre en main son destin sous Linux.

Parce que depuis que Valve est entré dans la course, avec le Steam Deck et SteamOS, tout a changé. Tel un Frodon motivé, épaulé par toute une communauté de développeurs, Valve s’est attelée à améliorer la compatibilité des jeux Windows sous Linux. En concentrant tout son pouvoir dans DirectX, Microsoft en a fait son talon d’Achille. Et l’arrivée d’un sortilège permettant de traduire cette unique langue qu’est DirectX offre le transfert de toute la force de Windows vers Linux.

Plusieurs corrections ont été mises à l’œuvre, la mise à jour détaille énormément de choses mais on retiendra notamment une solution aux écrans noirs ou vides lors du lancement de certains titres. Des corrections de nouveaux bugs portés par des mises à jour de jeux, moins d’alertes liées à des problèmes de composants graphiques et une meilleure gestion entre le passage du bureau vers les jeux à grands coups de Alt-Tab.

Autre mise à jour importante, le pilotage des applications d’éditeurs comme Ubisoft Connect est à nouveau fonctionnel. Cela reste un point faible de Proton, beaucoup de studios et d’éditeurs pensent toujours à Windows et uniquement à Windows pour leurs mises à jour. Sans s’inquiéter de l’impact de certains choix sur l’environnement Linux. Proton court donc après eux en permanence pour corriger ces bugs. Peut être que cela changera un jour.

Une nouvelle liste de jeux désormais totalement compatibles sous Proton 10 est également proposée :

Pour plus d’info sur Proton 10 : la note de version sous Github

Proton 10 pousse encore plus loin le jeu Windows sous Linux © MiniMachines.net. 2025

Aujourd’hui, plongeons dans le fonctionnement d’une cyberattaque reposant sur un minuscule mécanisme capable de faire surchauffer un système. L’occasion également de décortiquer un principe fondamental de l’informatique : le fork, littéralement « fourchette ».

Read more of this story at Slashdot.

Read more of this story at Slashdot.

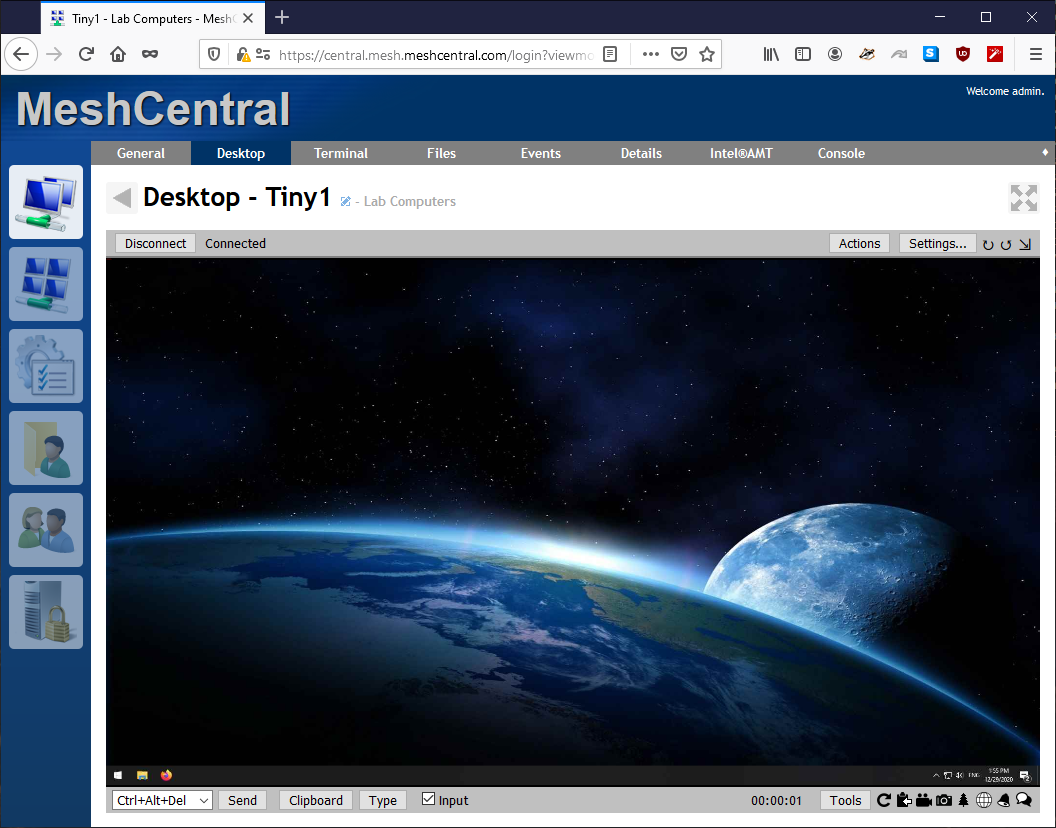

Ce qui suit est une mise en œuvre basique de l’outil de prise en main à distance MeshCentral. Adapté pour les petits dépannages mais conçu pour les organisations, c’est une solution à évaluer face aux logiciels plus connus comme TeamViewer, AnyDesk ou RustDesk. Je (NdM: YvanM) me garderai cependant de faire un comparatif des fonctionnalités, car je ne connais pas assez cet outil et ses « concurrents ».

MeshCentral propose des fonctionnalités similaires à TeamViewer ou AnyDesk. C’est à ma connaissance le seul outil complètement libre de ce type (il est sous licence Apache 2.0). RustDesk est également régulièrement cité sur LinuxFR, mais c’est un logiciel « open core », on peut donc être rapidement limité avec la version libre selon les usages souhaités.

Le projet était, si ma mémoire est bonne, sponsorisé par Intel dans ses débuts. Il est toujours en développement, mais il n’y a visiblement qu’un seul mainteneur actif. Cette personne semble proposer le développement sponsorisé de fonctionnalités.

Malgré cette confidentialité, MeshCentral propose presque toutes les fonctionnalités qui me semblent nécessaires pour une utilisation en entreprise. Il est également adapté à mes besoins en tant que particulier qui dépanne ponctuellement la famille et les amis :

J’ai une utilisation très restreinte de l’outil, mais j’ai quand même constaté des limitations embêtantes :

La méthode d’installation dépendra forcément du contexte. Voilà le mien :

En termes de RAM et d’utilisation CPU je ne me fais pas de soucis : pour les petites installations c’est censé tourné sur Raspberry Pi. Effectivement, le serveur démarré et un client connecté, le serveur consomme 90 Mo de RAM et 1 % de CPU (j’ai un i5-4300U, soit 4 cœurs à 1.90GHz)

On installe podman :

sudo apt install podmanOn crée l’utilisateur dédié nommé meshcentral (je trouve intéressant sur le principe d’avoir un utilisateur par service) qui fera tourner le conteneur, et on en profite pour mettre son home dans /srv (car ce n’est pas un utilisateur « normal ») :

sudo useradd --base-dir /srv \

--create-home \

--shell /bin/bash \

--user-group \

meshcentralOn note que par défaut useradd (tout comme adduser d’ailleurs) ajoute automatiquement une plage de sous-UID et sous-GID dans /etc/subuid et /etc/subgid : ces plages seront utilisées par les conteneurs que l’utilisateur meshcentral lancera (voir man 5 subuid).

Dans mon cas je démarrerai le service à la main quand j’en ai besoin, mais si on voulait que notre service puisse démarrer automatiquement à l’allumage de la machine il faudrait en plus exécuter la commande suivante :

sudo loginctl enable-linger meshcentralOn se connecte en tant que meshcentral :

sudo --login --user meshcentralIl existe sur le Docker Hub des images de MeshCentral, mais je n’en vois pas d’officielles et j’ai envie de bricoler :-). En me basant sur la documentation d’installation, on crée donc un fichier /home/meshcentral/Containerfile (équivalent d’un Dockerfile) avec le contenu suivant :

# On se base sur Debian Trixie en version slim

FROM docker.io/library/debian:trixie-slim

# On définit que la version « latest » de MeshCentral sera installée par défaut

ARG MESHCENTRAL_VERSION="latest"

# On fait les mises à jour, on installe les logiciels nécessaires, puis on

# supprime le cache des paquets

RUN apt-get update \

&& DEBIAN_FRONTEND=noninteractive apt-get full-upgrade --assume-yes \

&& DEBIAN_FRONTEND=noninteractive apt-get install --no-install-recommends --assume-yes nodejs npm tini \

&& rm -r /var/cache/apt/*

# On crée un utilisateur dédié pour lancer le service

RUN useradd --shell /usr/sbin/nologin --user-group --create-home meshcentral

# On utilise ce nouvel utilisateur

USER meshcentral

# On se place dans le bon répertoire

WORKDIR /home/meshcentral

# On installe les dépendances de MeshCentral dans ce répertoire

RUN npm install meshcentral@${MESHCENTRAL_VERSION}

# On définit la variable d’environnement conseillée pour faire tourner node

# en production

ENV NODE_ENV=production

# On lance tini pour qu’il prenne en charge et relaie SIGTERM

ENTRYPOINT ["tini","--"]

# Et finalement on lance meshcentral

CMD ["node","./node_modules/meshcentral"]On construit ensuite l’image, ici en précisant la version stable de MeshCentral qu’on veut récupérer du dépôt NPM et en appliquant un tag :

podman image build --build-arg MESHCENTRAL_VERSION=1.1.55 --tag meshcentral:1.1.55.L’image est stockée dans ~/.local/share/containers/storage/overlay/. podman image ls m’indique qu’elle fait 976 Mo.

On crée les volumes :

podman volume create meshcentral-files # pour les fichiers qu’on veut transmettre depuis ou vers les clients

podman volume create meshcentral-data # pour la configuration, les certificats, etc.Ils se trouvent comme on peut s’y attendre dans ~/.local/share/containers/storage/volumes/.

On fait un premier lancement à la main, ce qui permet de créer le fichier de configuration par défaut et de tester si ça marche. On n’est pas root, donc on ne pourra pas utiliser le port 443. De plus, dans le conteneur MeshCentral ne tourne pas en tant que root et utilisera donc par défaut le port 1025 :

podman run --rm \

--volume=meshcentral-data:/home/meshcentral/meshcentral-data \

--volume=meshcentral-files:/home/meshcentral/meshcentral-files \

--publish 1025:1025/tcp \

--hostname meshcentral \

--name meshcentral \

localhost/meshcentral:1.1.55Depuis le navigateur web, on peut aller sur https://127.0.0.1:1025 pour s’assurer que le service est accessible. Mais revenons pour l’instant dans le terminal et arrêtons notre conteneur avec Ctrl+C

Comme MeshCentral n’est pas joignable sur le port 80, on ne peut pas utiliser le client Let's Encrypt intégré pour obtenir un certificat. On va donc obtenir un certificat manuellement avec certbot.

Sur mon nom de domaine, j’ajoute un enregistrement A aide.domain.example qui pointe vers l’adresse IPv4 de ma box. J’aurais bien aimé faire de l’IPv6 aussi, mais avec le pare-feu IPv6 de ma box Free c’est soit on ouvre tout, soit on ferme tout…

Côté box, j’ajoute une redirection de ports pour que les ports TCP 80 et 1025 arrivent sur l’adresse IPv4 de mon laptop. J’ai également configuré un bail statique sur ma box pour que mon ordinateur portable ait toujours la même adresse IP.

On reprend notre utilisateur standard pour installer certbot :

sudo apt install certbotOn lance la commande suivante pour tester l’obtention d’un certificat. Il faudra renseigner une adresse e-mail (utilisée pour prévenir lorsque le certificat expire bientôt) et valider les conditions d’utilisation :

sudo certbot certonly --standalone --domain aide.domain.example --dry-run --test-certSi ce premier essai marche, on peut demander un certificat de test. C’est utile pour s’assurer qu’on a bien tous les bons paramètres, car Let's Encrypt applique des limites pour les demandes de certificats valides. On doit demander un certificat RSA (et non ECDSA par défaut) car MeshCentral ne sait pas encore gérer ECDSA. On va aussi utiliser l’option --deploy-hook pour copier le certificat au bon emplacement et avec les bonnes permissions. Le propriétaire de ces fichiers doit correspondre avec l’UID de l’utilisateur à l’intérieur de notre conteneur, sinon la clé privée ne sera pas lisible par MeshCentral. On peut pour cela regarder quel est l’UID des fichiers dans notre volume (/srv/meshcentral/.local/share/containers/storage/volumes/meshcentral-data/_data/), pour le reporter 4 fois dans la commande ci-dessous (dans mon cas 232071). Attention également à adapter le nom de domaine (à 3 endroits) :

sudo certbot certonly --test-cert \

--key-type rsa \

--standalone \

--domain aide.domain.example \

--deploy-hook 'install --verbose --owner=232071 --group=232071 --mode=644 /etc/letsencrypt/live/aide.domain.example/fullchain.pem /srv/meshcentral/.local/share/containers/storage/volumes/meshcentral-data/_data/webserver-cert-public.crt; install --verbose --owner=232071 --group=232071 --mode=600 /etc/letsencrypt/live/aide.domain.example/privkey.pem /srv/meshcentral/.local/share/containers/storage/volumes/meshcentral-data/_data/webserver-cert-private.key'Si tout se passe bien, on peut exécuter la même commande mais sans l’option --test-cert et on aura cette fois un certificat valide. Celui-ci est valable 3 mois, et par défaut est renouvelé automatiquement par le service systemd certbot.service déclenché par le timer certbot.timer. Comme je suis sur un laptop et que ce renouvellement ne peut fonctionner que si je suis chez moi, je désactive l’exécution automatique :

sudo systemctl disable certbot.timerQuand j’aurais besoin de renouveler le certificat et que je serai à la maison, j’aurais simplement à faire sudo systemctl start certbot.service (enfin c’est comme ça que j’ai compris le mécanisme, je n’ai pas testé).

On va maintenant modifier le fichier de configuration qui a été généré au premier démarrage de MeshCentral. Depuis l’hôte, en tant que l’utilisateur meshcentral, la solution la plus simple est de lancer podman unshare vim ~/.local/share/containers/storage/volumes/meshcentral-data/_data/config.json. Ça permet d’être dans le bon namespace pour avoir les droits d’écriture sur le fichier. On pourrait aussi utiliser notre compte root de l’hôte mais c’est intéressant de connaître l’existence de podman unshare qui semble bien utile pour comprendre et résoudre des problèmes.

Dans mon cas j’ajoute simplement les directives suivantes sous settings. On peut laisser les commentaires déjà présents dans le fichier. Les curieux iront lire la documentation (par exemple ici) pour voir tout ce qu’il est possible de faire :

"cert": "aide.domain.example" pour indiquer comment MeshCentral est joignable ;"port": "1025" pour spécifier le port plutôt que de prendre le premier disponible ;"WANonly": true parce que les fonctionnalités de LAN ne m’intéressent pas ;"amtManager": false parce que je ne vais pas me servir d’AMT (je ne sais pas si ça marche vraiment parce qu’il écoute toujours sur le port 4433, mais ça n’est pas gênant, car le port n’est pas exposé sur l’hôte).On peut relancer MeshCentral pour s’assurer que ça fonctionne.

Bien que Podman supporte les fichiers docker-compose.yml (si on installe le paquet Debian podman-compose), il cherche avant tout à s’intégrer au mieux avec systemd. Pour ça il propose les quadlets (voir man 5 quadlet), qui sont un type d’unités systemd qui permettent de faire à peu près la même chose qu’un fichier docker-compose.yml. On va utiliser cette méthode pour faciliter le lancement ultérieur de notre conteneur. Ici, je vais placer mon unité systemd dans le répertoire de mon utilisateur meshcentral. On crée le bon répertoire :

mkdir --parents ~/.config/containers/systemd/Et on y crée le fichier ~/.config/containers/systemd/meshcentral.container avec le contenu suivant :

[Unit]

Description=Meshcentral in a Podman container

# C’est déjà une dépendance implicite, mais je la mets pour que ce soit explicite

After=networking.target

[Container]

Image=localhost/meshcentral:1.1.55

ContainerName=meshcentral

HostName=meshcentral

PublishPort=1025:1025

Volume=meshcentral-files:/home/meshcentral/meshcentral-files

Volume=meshcentral-data:/home/meshcentral/meshcentral-data

# Je ne sais pas si c’est c’est vraiment utile mais ça ne coûte rien

DropCapability=allOn indique à systemd de prendre en compte ce nouveau fichier :

systemctl --user daemon-reloadEt on peut démarrer notre service simplement :

systemctl --user start meshcentral.servicePassons enfin à l’utilisation de MeshCentral. Depuis la page d’accueil de l’interface web, cliquer sur le lien pour créer un premier compte utilisateur.

Une fois connecté, cliquer sur le lien « Créer un nouveau groupe d’appareils ». Pour mon usage basique, je laisse comme type « Gérer à l’aide d’un agent logiciel ».

Il faut maintenant obtenir et installer le client (ici appelé « agent ») sur les postes, et quand on clique sur « Ajouter un agent » à côté du nom du groupe il y a pléthore de choix.

Pour Windows, je ne saurais pas dire exactement quels choix permettent quelles fonctionnalités (installation en tant que service, assistance à la demande sans que l’utilisateur ait les droits d’administration…) car je n’ai plus de machine pour tester, désolé.

À noter que par défaut l’agent n’est pas signé, donc Windows demande une confirmation avant d’exécuter le binaire.

Pour Linux, on obtient un agent à installer en tant que service en choisissant « Exécutable d’installation Linux / BSD / macOS », avec « Type d’installation » « Ligne de commande & bureau distant » ou « Ligne de commande uniquement », puis en cliquant sur le lien nommé « MeshAgent ». Il faudra alors faire une commande du type chmod +x && sudo./meshagent pour l’installer (ajouter l’option -install à meshagent pour éviter la pop-up graphique qui demande quoi faire).

L’agent sera installé dans /usr/local/mesh_services/meshagent/meshagent et sera lancé automatiquement par le service meshagent.service. Pour le désinstaller il est possible de supprimer ces fichiers, ou d’utiliser le binaire de désinstallation téléchargeable également depuis l’interface web, toujours via le lien « Ajouter un agent », ou de lancer le binaire installé avec l’option -uninstall.

On obtient un agent que l’utilisateur sans droit root pourra utiliser en choisissant « Exécutable d’installation Linux / BSD / macOS », avec « Type d’installation » « Interactif seulement » (pas vraiment instinctif…). Il faudra dans tous les cas bien expliquer à cet utilisateur comment démarrer ce binaire (car ça dépend de l’environnement qu’il utilise et parce qu’il faut ajouter les droits d’exécution), mais une solution est de lui donner par e-mail une commande toute prête à copier-coller dans son terminal, du type :

cd /tmp/ && wget -O meshagent « https://aide.domain.example:1025/meshagents?id=pYWSORfgTMN%2IdKohzytKQePtv8DzNzbTZcqB2m%24h7MuA4bzXSWJRt6vLN9VBILW&installflags=1&meshinstall=6 » && chmod +x meshagent &&./meshagentPour une utilisation à la demande, je m’étais créé un paquet Debian qui une fois installé, permettait par un clic de l’utilisateur de télécharger le binaire et de le lancer, le tout avec une interface graphique basique. C’était de loin le plus simple pour les utilisateurs, mais c’est pas mal de travail.

Les méthodes d’installation ci-dessus nécessitent que vous transmettiez le binaire (ou le lien de téléchargement précis) aux utilisateurs. Une autre méthode consiste à inviter les utilisateurs ce qui crée une URL spécifique, accessible sans identifiant, pour qu’ils puissent eux-mêmes télécharger le binaire et obtenir les instructions d’installation. Pour cela, depuis la page d’accueil, cliquer sur le lien « Inviter » à côté du nom du groupe.

C’est à mon sens particulièrement intéressant pour les utilisateurs Windows, puisqu’il suffit de leur transmettre le lien par courriel. (NdM: attention à ne pas habituer les utilisateurs à installer tout et n'importe quoi en un clic sur un lien, en particulier un outil de prise en main à distance. Optez pour un canal de confiance, un courriel signé, etc.)

La mise à jour des agents se fait automatiquement (si nécessaire) après redémarrage du serveur sur une nouvelle version.

Comme dit plus haut, l’agent MeshCentral n’est pas encore compatible Wayland. Voici quelques idées de contournement qui peuvent convenir à votre cas d’usage, ou pas.

Pour avoir accès au gestionnaire de session, j’imagine qu’il suffirait de lancer ce dernier avec Xorg, mais je n’ai jamais testé.

Pour avoir accès à la session on peut en général indiquer à l’utilisateur comment rouvrir sa session avec Xorg. Mais rappelons-nous également que MeshCentral peut se connecter à un serveur RDP ou VNC qui tourne sur la machine, ce qu’on peut faire assez facilement.

Si c’est Gnome qui tourne on peut simplement lancer le serveur VNC intégré. On peut indiquer à l’utilisateur de le faire, mais on peut aussi le faire nous-même depuis l’accès en ligne de commande proposé par MeshCentral. À noter que ce serveur VNC écoute sur toutes les interfaces réseau et que même si un mot de passe aléatoire est défini, il est recommandé de l’arrêter lorsque l’accès distant au bureau n’est plus nécessaire :

# on enregistre comment accéder à dbus (nécessaire pour dconf et systemctl

export DBUS_SESSION_BUS_ADDRESS=unix:path=/run/user/"$(id --user)"/bus

# on désactive l’accès RDP qui est activé par défaut

dconf write /org/gnome/desktop/remote-desktop/rdp/enable false

# on active l’accès VNC qui est désactivé par défaut

dconf write /org/gnome/desktop/remote-desktop/vnc/enable true

# on démarre le service utilisateur de partage du bureau

systemctl --user start gnome-remote-desktop.serviceUne solution est d’utiliser le serveur VNC Krfb, qu’on installera avec une commande du type sudo apt install krfb. Il suffit ensuite de demander à l’utilisateur de démarrer ce logiciel depuis le menu (il se trouve dans la rubrique « Internet » et qu’il vous communique le mot de passe.

Comme pour le cas de Gnome juste au-dessus, je recommande également d’arrêter Krfb une fois la prise en main à distance terminée (depuis le menu « Fichier -> Quitter », parce que cliquer sur la croix ferme juste la fenêtre).

Commentaires : voir le flux Atom ouvrir dans le navigateur

Cette revue de presse sur Internet fait partie du travail de veille mené par l’April dans le cadre de son action de défense et de promotion du logiciel libre. Les positions exposées dans les articles sont celles de leurs auteurs et ne rejoignent pas forcément celles de l’April.

✍ Fabrizio Defilippi, le samedi 10 janvier 2026.

TRIBUNE. L’essor de l’intelligence artificielle, et avec elle d’images produites rapidement, a entraîné un appauvrissement de la créativité en ligne, au point de susciter une vague de nostalgie pour le Web tel qu’il existait auparavant, souligne Fabrizio Defilippi, spécialiste des cultures numériques, dans une tribune au «Monde».

✍ Alexandre Piquard, le jeudi 8 janvier 2026.

CHRONIQUE. La concurrence entre modèles propriétaires et modèles ouverts et gratuits d’intelligence artificielle est au cœur de l’affrontement économique et idéologique entre l’Amérique de Trump et la Chine de Xi Jinping, explique Alexandre Piquard dans sa chronique.

Et aussi:

✍ Maximilian Henning, le mercredi 7 janvier 2026.

La Commission européenne entend renforcer la souveraineté numérique de l’UE en favorisant la commercialisation des logiciels open source développés en Europe, selon une consultation publiée mardi 6 janvier.

✍ Steven Vaughan-Nichols, le lundi 5 janvier 2026.

Linux et l’open source s’apprêtent à connaître une année faste, avec la croissance de PDM sur les ordinateurs de bureau, la montée en puissance de Rust et toujours plus de sécurité.

✍ Auberi Verne, le mercredi 31 décembre 2025.

Le Département de Côte-d’Or a lancé, fin décembre, son propre service de navigation virtuelle sur le réseau routier. Une façon d’assurer son indépendance face à l’hégémonie du géant Google Street View.

Et aussi:

✍ Thierry Noisette, le mardi 30 décembre 2025.

En bref. Et vous, qui soutenez-vous? Ce que peuvent faire les entreprises contre l’exclusion numérique, par Emmaüs Connect. Lyon, Grenoble et d’autres villes, retours d’expérience sur l’adoption de solutions libres

Et aussi:

Commentaires : voir le flux Atom ouvrir dans le navigateur

Read more of this story at Slashdot.

Le mythe du développeur puriste travaillant à la dure dans son terminal vient de prendre un coup de vieux. Début 2026, Linus Torvalds, le créateur du noyau Linux et de Git, a admis utiliser l'IA pour générer du code sur ses projets personnels.

Read more of this story at Slashdot.

Read more of this story at Slashdot.

Read more of this story at Slashdot.