Empêcher l’entraînement des IA en France, voire même leur commercialisation, au nom de la protection des auteurs. Irréaliste ? Délirant ? Économiquement criminel ? C’est pourtant le sens de la nouvelle loi votée à l’unanimité par nos sénateurs.

À l’abri de la lumière médiatique, le Sénat vient d’adopter à l’unanimité une proposition de loi sur le rapport entre l’IA et le droit d’auteur. Portée par la sénatrice Laure Darcos, elle a également reçu le soutien direct de Renaissance, de LR et du Parti communiste, dans un attelage pour le moins baroque. Ce texte introduit dans le Code de la propriété intellectuelle un article unique qui bouleverse l’équilibre entre création et innovation. Désormais, « sauf preuve contraire, l’œuvre ou l’objet protégé par un droit d’auteur ou par un droit voisin est présumé avoir été utilisé par le fournisseur du modèle ou du système d’intelligence artificielle, dès lors qu’un indice afférent au développement ou au déploiement de ce système ou au résultat généré par celui-ci rend vraisemblable cette utilisation ».

En d’autres termes, si un indice quelconque laisse penser qu’une IA a pu utiliser une œuvre protégée (un livre, une photo, une musique, etc.) pour s’entraîner ou pour générer un contenu, on considérera automatiquement que c’est le cas… sauf preuve du contraire. À partir de là, tout auteur ou ayant droit pourra engager une procédure judiciaire sur la base d’un simple indice (similarité stylistique ou graphique, etc.). De quoi encore davantage submerger nos tribunaux, déjà au bord de la crise de nerfs, et conduire les entreprises investies dans l’IA à passer leur temps à se défendre plutôt qu’à innover.

La charge de la preuve, qui pesait jusqu’alors sur les ayants droit, bascule donc sur les entreprises. L’intention proclamée est noble en apparence : mettre fin à ce que les défenseurs du texte qualifient de « pillage » ou de « moissonnage » massif des œuvres par les modèles génératifs. Mais, derrière cette rhétorique protectrice, se dissimule un dispositif qui menace non seulement l’essor de l’IA en France, mais aussi le principe même de la création, qu’elle soit humaine ou algorithmique. Ce texte, adopté dans une urgence presque fébrile, révèle une fois encore les travers d’une culture législative française qui, sous couvert de régulation vertueuse, étouffe l’innovation et saborde ses propres atouts dans la course technologique mondiale.

Le principe même des IA remis en cause

Au cœur de cette proposition réside une mise en danger fondamentale de l’entraînement des intelligences artificielles. Un modèle de langage de grande envergure, qu’il s’agisse des architectures open-weight de Mistral AI ou des systèmes plus opaques des géants américains, ne surgit pas du néant. Il se construit par une immersion profonde, une digestion statistique colossale de milliards de données textuelles, visuelles ou sonores collectées sur le web ouvert ou dans des corpus publics. Cet apprentissage, loin d’être une simple copie mécanique, consiste en une synthèse qui permet à la machine de recombiner des concepts et de générer des créations originales au profit de l’être humain qui les prompte.

Interdire ou rendre périlleux cet entraînement revient à nier la nature même de l’IA générative : un outil qui, comme l’esprit humain, progresse par imprégnation cumulative et transfiguration créatrice. Prétendre qu’un système doit rester vierge de toute influence antérieure pour être légitime, c’est ignorer que toute intelligence — biologique ou artificielle — s’élève précisément en absorbant un océan de connaissances préexistantes. Le texte du Sénat ne se contente pas de réguler l’usage ; il fragilise l’architecture cognitive elle-même des modèles, en rendant leur développement techniquement et juridiquement hasardeux sur le sol européen.

Une inversion de la charge de la preuve techniquement insurmontable

Cette fragilisation devient catastrophique lorsqu’on mesure l’ampleur de l’inversion de la charge de la preuve qu’impose le dispositif. Comment un fournisseur d’IA pourrait-il, en pratique, démontrer l’absence totale d’utilisation d’une œuvre protégée au sein de données qui atteignent souvent plusieurs centaines de téraoctets, accumulés sur des années ?

La « preuve contraire » exigerait soit une inspection exhaustive et rétroactive des données — une entreprise colossale, coûteuse et souvent impossible sans dévoiler les secrets industriels les plus sensibles —, soit une transparence forcée des algorithmes qui exposerait les acteurs européens à une vulnérabilité concurrentielle sans précédent face aux géants américains ou chinois, moins contraints par de telles obligations. Les contentieux se multiplieraient en un véritable tsunami judiciaire. Chaque génération de contenu « à la manière de », chaque restitution partielle pourrait déclencher une présomption de culpabilité. Les procédures s’éterniseraient devant les tribunaux, paralysant les startups comme les laboratoires de recherche, tandis que l’innovation stagnerait sous le poids d’une infernale machine administrative et contentieuse. Loin de protéger les créateurs, ce mécanisme risque de créer une insécurité juridique permanente.

Le droit d’auteur détourné de son essence philosophique

Mais le détournement le plus insidieux opéré par ce texte concerne sans doute le droit d’auteur lui-même, dont il pervertit le sens. Ce droit, dans sa philosophie forgée par les Lumières et affinée au fil des siècles, protège l’exploitation frauduleuse et directe d’une forme originale, singularisée par l’empreinte personnelle de son créateur. Il ne vise nullement à entraver l’inspiration, la lecture assidue, l’écoute répétée ou l’étude minutieuse des œuvres antérieures.

Toute l’histoire de l’art, cette longue chaîne ininterrompue de filiations et de ruptures, repose sur ce principe de digestion et de transfiguration. Les peintres de la Renaissance, qu’ils soient flamands ou italiens, copiaient inlassablement les maîtres antiques ou contemporains, analysaient leurs compositions, réinterprétaient leurs motifs avant de forger leur propre langage. Les compositeurs romantiques, de Beethoven à Chopin, s’abreuvaient des partitions de Bach, de Mozart ou de Haydn, non pour les plagier, mais pour les sublimer dans des formes nouvelles. Les écrivains du XXe siècle, de Proust à Joyce en passant par les surréalistes, dévoraient les textes de leurs prédécesseurs avec une voracité intellectuelle qui nourrissait leur génie propre.

Considérer qu’un modèle de langage ne peut s’entraîner sur les œuvres existantes équivaut, en réalité, à interdire au jeune artiste de décrypter les toiles de ses aînés ou au musicien en herbe d’écouter des milliers d’heures de répertoires avant de composer. L’IA ne procède pas autrement : elle lit, elle absorbe, elle synthétise à une échelle surhumaine. Elle ne reproduit pas ; elle recrée à partir d’une mémoire collective digérée à la demande d’un être humain. Assimiler cet apprentissage statistique à un vol revient à méconnaître la nature profonde de la création humaine, qui n’a jamais existé en vase clos, mais s’est toujours enrichie de l’héritage commun.

La peur légitime des artistes, mais un combat mal orienté

Pourtant, la crainte qui anime de nombreux artistes face à cette révolution technologique est compréhensible. Ils voient leurs métiers menacés par des outils capables de produire en quelques secondes des textes, des images ou des compositions d’une qualité souvent époustouflante. Cette angoisse s’exprime avec une force particulière chez les comédiens et les instrumentistes, qui se sentent les premiers exposés au risque d’un remplacement pur et simple.

Leur combat est compréhensible, mais il n’en demeure pas moins mal orienté. Car face à l’IA, dont la perfection parfois froide et « inhumaine » peut laisser un sentiment de frustration chez une partie du public en quête d’authenticité, le spectacle vivant retrouve un boulevard inattendu et prometteur. Le théâtre, le concert, la performance en chair et en os regagnent leur noblesse primordiale : celle de l’incarnation physique, de la présence irremplaçable, de l’imperfection vibrante qui seule touche l’âme. Le public, lassé des productions trop lisses générées par des algorithmes, reviendra en masse vers la scène vivante, vers l’émotion partagée en temps réel.

Quant aux véritables créateurs — réalisateurs, scénaristes, romanciers, etc. —, l’intelligence artificielle ne les supplante pas ; elle les élève à un rang inédit. L’art du prompt, cette nouvelle forme d’écriture précise et nuancée, devient un talent décisif. Celui qui sait structurer sa pensée avec rigueur, affiner son langage, anticiper les subtilités d’une machine probabiliste obtient d’elle exactement ce que son esprit imagine, sans recourir à des processus de production extrêmement coûteux en temps, en énergie ou en ressources. Loin de dévaloriser les littéraires, l’IA les replace au cœur du jeu créatif.

Le syndrome normatif français : légiférer d’abord, comprendre ensuite

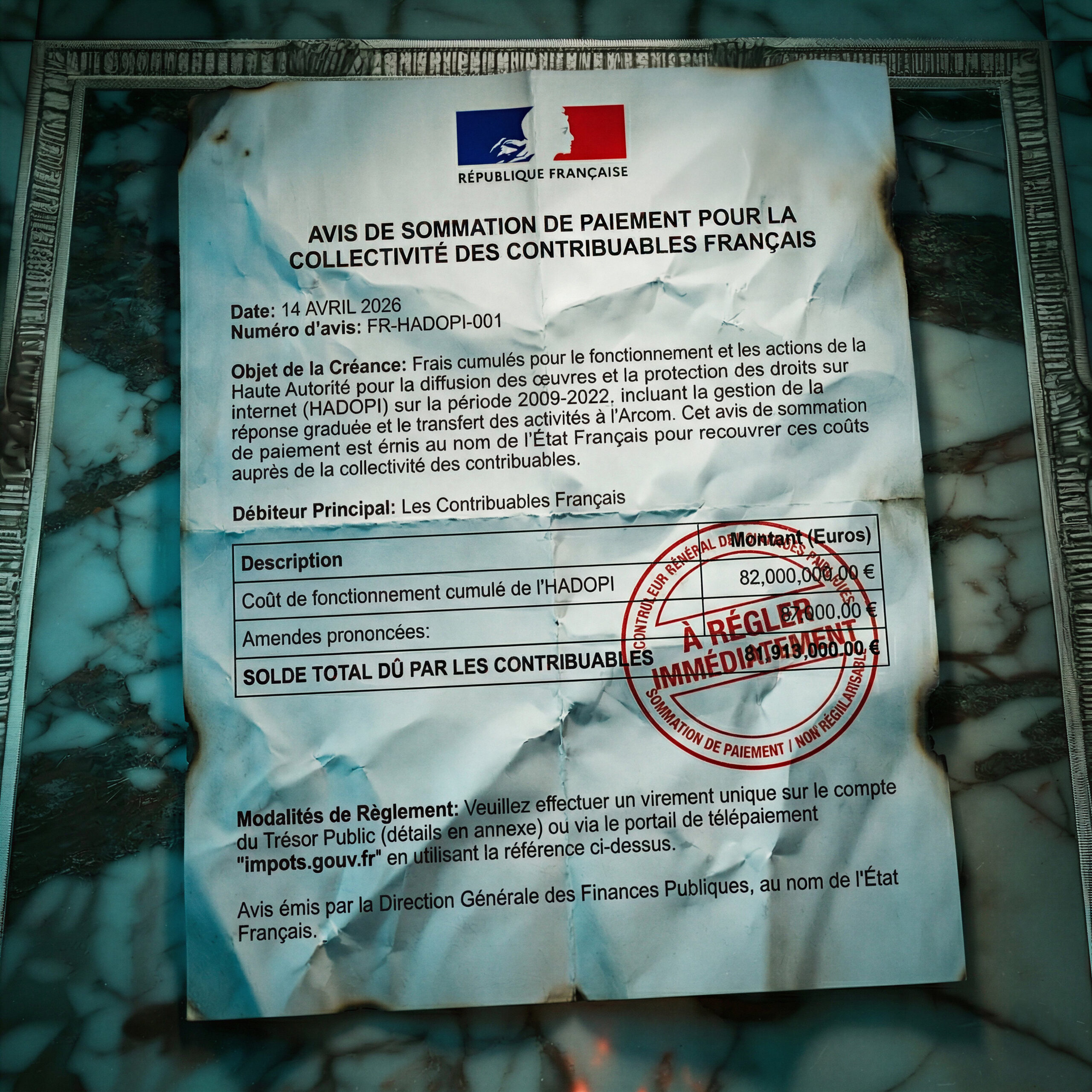

On ne peut s’empêcher de reconnaître dans ce texte le symptôme récurrent d’un défaut normatif profondément ancré dans la culture administrative et politique française. Notre pays a toujours manifesté une propension singulière à vouloir légiférer sur tout, et particulièrement sur les innovations issues du secteur privé. Le politique, souvent dépassé par la rapidité fulgurante du monde numérique, réagit par un réflexe réglementaire pavlovien, comme il l’avait fait naguère avec la loi Hadopi. Celle-ci, adoptée en 2009 dans un élan de protection de la création face au téléchargement illégal, est restée dans les mémoires comme un exemple emblématique de dispositif hors-sol, inefficace et contourné par la technologie elle-même.

Ici encore, on légifère sans pleinement appréhender les enjeux, les dynamiques de concurrence internationale ni les subtilités techniques de l’entraînement des modèles. On veut protéger la culture en entravant l’outil même qui pourrait la démultiplier, la rendre accessible à tous et enrichir le terreau créatif français. En réalité, derrière chaque épisode législatif similaire concernant la propriété intellectuelle, on retrouve à la manœuvre les très influents organismes de gestion collective (les fameuses Sacem, SACD, Scam…). Ils ont été à la source d’Hadopi, de la directive copyright et de sa transposition, mais sont aussi parvenus, en 2021, via la loi REEN (réduction de l’empreinte environnementale du numérique), à tordre le bras du législateur pour lui imposer l’introduction d’un prélèvement obligatoire sur les matériels d’occasion reversé aux ayants droit, au titre de la redevance sur la copie privée.

Un tir dans le pied face à un potentiel exceptionnel

In fine, ce texte témoigne d’une double et douloureuse distance. Entre l’état du politique et celui de la société d’une part, et entre la France et son propre potentiel d’autre part. Car notre pays dispose, dans le domaine de l’intelligence artificielle, mais aussi dans la biotechnologie, les techniques CRISPR, les nouvelles technologies génétiques, les startups innovantes et la recherche médicale de pointe, d’atouts et de talents d’une rare qualité. Mistral AI, notre fleuron national, incarnait jusqu’ici l’espoir d’une Europe souveraine capable de rivaliser avec les géants d’outre-Atlantique. Cette proposition de loi risque de remettre en cause son existence même sur le sol français, à moins qu’elle ne choisisse, comme d’autres acteurs l’ont déjà laissé entendre, de délocaliser ses activités vers des juridictions plus accueillantes. Ce serait alors l’illustration tragique de notre capacité à saborder nos champions au nom d’une régulation prétendument protectrice.

L’avenir de la France en matière d’innovation ne doit pas se jouer dans des prétoires surchargés ni dans les commissions parlementaires qui cherchent à tout encadrer avant même d’avoir compris les enjeux profonds des sujets qu’elles abordent. Il s’exprimera dans notre capacité collective à accompagner le progrès tout en préservant l’essence de la création humaine. À l’Assemblée nationale, il est encore temps de refuser ce texte ou de le rééquilibrer en profondeur. Non pour abandonner les artistes, mais pour refuser le faux dilemme entre culture et innovation. Car l’une et l’autre ne s’opposent pas, mais se nourrissent mutuellement depuis la nuit des temps. L’intelligence artificielle n’est pas l’ennemie de l’esprit créateur ; elle en constitue un prolongement prometteur. La France a le choix : devenir le pays qui régule l’avenir jusqu’à l’étouffer, ou celui qui l’invente avec audace, intelligence et une confiance retrouvée en son génie propre.

L’article IA : Sacrifier notre avenir sur l’autel du droit d’auteur ? est apparu en premier sur Les Électrons Libres.