Amazon Must Negotiate With First Warehouse Workers Union, US Labor Board Rules

Read more of this story at Slashdot.

Read more of this story at Slashdot.

Read more of this story at Slashdot.

Le 19 mars dernier, nos confrères de GamesIndustry.biz rapportaient le licenciement de 105 développeurs du studio Red Storm Entertainment par Ubisoft. Cette décision s’inscrit dans un plan de réduction des coûts visant à économiser 200 millions d’euros, dans le cadre de la restructuration du géant breton. On notera toutefois que le studio, créé en 1996 et à l’origine des Tom Clancy’s Rainbow Six et Tom Clancy’s Ghost Recon, restera ouvert, mais ne fera plus directement de jeux. D’après les sources du journaliste, son rôle se cantonnera désormais à travailler sur le moteur Snowdrop – notamment utilisé dans Avatar: Frontiers of Pandora et le feu XDefiant –, ainsi que sur du support IT et de la relation client.

Ça fait bizarre de voir un ancien pillier du FPS relégué à des tâches techniques, mais il ne faut pas non plus se voiler la face : cela fait plus de 18 ans qu’on n’avait pas parlé d’un jeu de Red Storm sur NoFrag (hors VR), le studio s’étant tourné vers les TPS, voire pire. Et le seul projet qu’on a pu aborder « récemment » a été annulé en 2022 : il s’agissait d’un épisode en VR de Splinter Cell.

Le voyage vers Pandora va-t-il s'arrêter plus tôt que prévu ? Si James Cameron a déjà les scripts en main et une partie du quatrième opus d'Avatar en boîte, le destin de la saga la plus lucrative de l'histoire du cinéma vacille, entre la prudence de Disney et l'optimisme de la production.

Read more of this story at Slashdot.

Read more of this story at Slashdot.

Si vous avez été attentifs aux prix sur les mois de février et mars, le marché est arrivé à une certaine stabilisation de la mémoire vive. Le prix des références les plus classiques semble ne plus trop bouger. Certains types de mémoire ont reculé, d’autres n’ont pas augmenté. Le site 3DCenter annonce une moyenne de prix inchangée ces derniers mois. Ce qui fait dire à certains que la mémoire est en baisse.

C’est peut être faire preuve d’un peu d’optimisme. Si une stabilisation de la mémoire vive est nette, déclarer des prix en baisse c’est aller un peu vite en besogne. D’abord 3DCenter analyse uniquement les tarifs des revendeurs en Allemagne, ce qui n’est pas du tout une analyse générale du secteur. Les revendeurs allemands sont, comme nous, un petit marché sur la planète mémoire vive.

Et surtout, si on regarde le tableau des prix mis en avant, on se rend compte qu’il s’agit plus d’une correction de tarifs qu’autre chose. Ici la baisse la plus spectaculaire est un -15% sur le kit de 2×32 Go de DDR5/6000. Soit un des kits les plus haut de gamme du tableau et surtout un kit qui est passé de 158€ à 596€ entre juillet et mars… Le reste des baisses est situé entre -2 et -5%, des chiffres qui sont compen,sés par des +5, +7 et mêm +17% sur d’autres modules.

Cela peut se traduire facilement. Les revendeurs allemands ont augmenté leurs prix autant que possible jusqu’à un maximum et, quand un ralentissement trop net des achats s’est fait sentir, ils ont juste réduit la voilure et ajusté légèrement leurs prix. Il arrive toujours un moment où le public bloque, même lorsqu’il n’a pas vraiment le choix. Le problème lorsque le public boude une référence de ce type, c’est que vous avez des milliers et des milliers d’euros qui dorment sur une étagère. La réaction classique est donc de baisser les prix pour que le stock bouge et que vous retrouviez des liquidités.

En agrégeant les prix de différents revendeurs, on ne peut pas obtenir de tendance. Certains ont peut-être fait des promotions, d’autres mis en avant un kit de mémoire noname particulier qui est, ici, mis dans le même panier qu’un kit haut de gamme. L’évolution des tarifs est donc à prendre avec des pincettes.

On remarque également que la hausse continue encore sur les références les plus vendues du marché. Les barrettes de DDR5-5600 ont encore gagné 10% Les 16 Go ont soit perdu 2% pour la 5600, soit gagné 3% sur la 6400. Le kit le plus populaire à l’été 2025, soit le 2 x 16 Go de DDR5 est quasi stable. Au final, le tableau ne dit absolument pas que la mémoire baisse mais qu’une stabilisation de la mémoire vive semble être atteinte au global avec une toute petite hausse de 0.1%. Un équilibre qui se fait après une hausse moyenne de 440% par rapport aux prix de juillet 2025.

Il y a énormément de biais possibles dans les relevés de prix des revendeurs. Le marché des pièces détachées est un mauvais témoin des tendances de tarifs. Ce que je crois comprendre de ce tableau est assez simple. Si cela s’est passé comme en France, les revendeurs comme les grossistes et les marques ont tous tendu le fil pour essayer de monter les prix au maximum parce que les marques augmentaient sans cesse les leurs tout en baissant les disponibilités. Les grossistes en amont ont donc proposé des prix de plus en plus élevés et les revendeurs ont suivi. Affichant à leur tour ces tarifs à leurs clients. Semaine après semaine, la mémoire a ainsi augmenté pour tous ceux qui n’avaient pas de contrat spécifique, ce qui concerne probablement la grande majorité des distributeurs.

Les revendeurs n’ont pas vraiment d’autres choix que d’accepter ces hausses car, sans mémoire, ils ne peuvent plus monter de machines. Ce qui est souvent une grosse partie de leur activité. Et pour éviter de se faire dépouiller de leur mémoire vive en pièces détachées sur leur catalogue, certains ont augmenté encore plus haut la mémoire vive sur leur catalogue de manière à ce qu’elle ne soit pas accessible sans débourser une fortune. Ce qui permet de vendre des configurations apparemment moins chères ensuite au global.

Mais il arrive toujours un moment où même cette stratégie ne tient plus la route. Le tarif demandé atteint un point que personne ne veut plus franchir et les ventes s’écroulent totalement. Il faut alors rectifier le tir. C’est pour cela que l’on voit des prix en légère baisse. Soit parce qu’un autre revendeur a mis la main sur un stock moins onéreux, ce qui stoppe la hausse, soit parce que les références en stock ne partent plus du tout.

Il est possible, enfin, qu’en l’absence de tout stock, certains revendeurs jouent à la guerre des faux prix. Loin d’une stabilisation de la mémoire vive, c’est une pratique classique qui permet de mettre des bâtons dans les roues de la concurrence. Quand vous n’avez plus de visibilité à court ou moyen terme sur un produit, vous le passez en « indisponible » et vous le baissez de manière importante tout en demandant aux clients de laisser un e-mail pour être prévenus en cas de retour de stock. Cela permet de « bloquer » les ventes des concurrents et d’être présent sur les listings des sites de comparaison de tarifs. Problème, cela fausse aussi toute la mécanique d’analyse de ce genre de relevé.

Le site PCPartPicker fait le même travail de remontée des prix sur les revendeurs US. On remarque également une stabilisation de la mémoire vive ces dernières semaines sur quelques références et une hausse continue sur d’autres. Ainsi le kit hyper standard et toujours demandé de 2 x 8 Go de DDR4-3200 gagne encore quelques points entre janvier et mars. Les autres références de DDR4 sont majoritairement sur une hausse début janvier puis une stagnation voire un très léger décrochage.

Sur la DDR5, le kit classique de 2 x 16Go est également très stable après une dernière grosse phase de hausse à la mi-janvier. Les autres références suivent la même tendance, à la différence notable du kit de 2×32 Go de DDR5-5600 qui semble décroître après une même augmentation jusqu’à début février.

Il s’agit là encore d’un décrochage lié, à mon sens, plus à une autocorrection que les revendeurs se sont appliquée eux-mêmes après une dernière phase de gourmandise tarifaire. À partir d’un certain prix et peut-être face également à une certaine conjecture économico-politique, les prix ont été jugés trop élevés.

Ces kits en baisse sont toujours des solutions haut de gamme en 2 x 32 Go de DDR5. En Allemagne sur la DDR5-6000, aux US sur la DDR5-5600. Qui achète 64 Go de mémoire vive aujourd’hui ? Des kits à 700€ en Europe et 900$ aux US ? Ce sont les pros. C’est sur ces références, en général très liées à un usage intensif des machines, que les prix décrochent. S’agit-il vraiment d’un retournement de marché ou plutôt que la situation globale actuelle donne moins envie aux pros de renouveler leur parc ou de s’équiper ?

La raréfaction des pièces disponibles a également tendance à figer les prix. Quand un revendeur n’a pas de visibilité précise sur ses disponibilités, il va augmenter son prix de vente pour se « couvrir ». Et les relevés peuvent donc partir à la hausse. Quand il reçoit enfin les pièces commandées, il réajuste son tarif vers un prix plus logique, ce qui fait baisser le relevé qui avait été gonflé artificiellement. Avec des disponibilités de plus en plus compliquées, les relevés jouent ainsi au yoyo ces dernières semaines.

Si on regarde en amont des revendeurs, en examinant le prix des modules de mémoire vive sur le marché avant qu’ils ne soient intégrés dans des barrettes de mémoire vive, la tendance est également à une certaine stabilité ces dernières semaines. Je n’ai pas le droit de vous partager les graphes de DRAMeXchange mais sur les modules mémoire chez Samsung et SK Hynix c’est très net.

Je pense que nous avons atteint le point haut de ce que les datacenters IA ont accepté de payer. Et cela se voit nettement sur les références en baisse. Les barrettes de mémoire les plus denses en quantité, celles les plus prisées par les serveurs, vont à la baisse car les prix ont dû dépasser un certain seuil qui correspondait à ce qu’acceptaient de payer les géants de l’IA. Les barrettes plus classiques, destinées au marché grand public, continuent de monter parce que les chaines tournent en continu pour fabriquer les modèles les plus demandés en densité.

Parler d’une baisse me parait donc inapproprié, on est dans une phase de correction et je doute qu’elle se poursuive sans de meilleures mauvaises nouvelles contre les géants de l’intelligence artificielle. Les évènements actuels en Iran pouvant à tout moment impacter à nouveau à la hausse l’ensemble des composants.

Vous avez sans doute vu passer des articles concernant Google Research qui a annoncé un algorithme miracle baptisé TurboQuant. Ce nouveau venu est lancé avec un objectif en tête, mieux compresser la mémoire vive nécessaire aux IA pour garder leur cohérence. Cet algorithme n’a qu’un seul travail, augmenter les capacités de compression des données en mémoire pour les modèles d’IA. Avec l’idée d’avoir besoin de moins de RAM pour faire tourner des modèles gourmands tout en gardant la même précision d’exécution.

La raison pour laquelle les centres de données des acteurs majeurs de l’IA mondiale sont si voraces en mémoire vive est simple. Elle tient en deux éléments. Pour que leurs modèles soient le plus efficaces, il faut que leurs processeurs puissent accéder le plus rapidement possible à leurs modèles de données. Passer par un stockage classique, même en SSD, est souvent trop lent. L’idéal est d’agglomérer suffisamment de gigaoctets de mémoire vive pour piloter la totalité du modèle déployé. C’est pour cela que les différents LLM sont en général proposés avec des « poids » différents. Avec DeepSeek par exemple, on peut télécharger un modèle avec 7 milliards de paramètres et un autre de 67 milliards de paramètres. La mémoire nécessaire pour les deux modèles n’est pas du tout la même.

Mais l’autre élément important est la mémoire de « session ». Un espace de mémoire temporaire qui sert à agglomérer les questions et réponses d’un sujet posé. Histoire de ne pas trop tout mélanger au fur et aà mesure de l’avancée d’une session. Si vous engagez une IA pour la questionner sur un sujet, vous comptez sur le fait qu’elle restera focalisée sur celui-ci quand la conversation avance.

La promesse de TurboQuant est donc de réduire l’impact de cette seconde mémoire de session tout en augmentant la performance d’accès. C’est énorme mais cela ne touche en rien au besoin fondamental de la mémoire centrale qui va charger le LLM de base. L’annonce a évidemment fait grand bruit parce qu’en théorie, un serveur aurait besoin de moins de RAM pour un meilleur résultat avec le « simple ajout » de TurboQuant dans l’équation. Cela pourrait changer la donne et ralentir les besoins des centres d’IA sur le marché. Avec, comme espoir, une baisse tendancielle des tarifs pour tout le monde, y compris les entreprises classiques et les particuliers.

En pratique, je doute. TurboQuant va probablement changer certaines choses et modifier le comportement des centres IA qui seront compatibles avec cette technologie. Mais un retour de bâton est également possible. Si cela amène une stabilisation de la mémoire vive, cela n’entrainera pas de baisse et surtout, cela pourrait impacter fortement les marchés des processeurs, des circuits graphiques, du stockage et même de la mémoire à nouveau.

Ce type de « techno solutionnisme » a toujours un revers d’optimisation. Que va faire un centre de données avec une mémoire de session mieux compressée ? Réduire ses investissements ou augmenter ses capacités de calcul ? Vous savez probablement que la course en avant menée par les différentes IA actuellement en compétition est assez classique. Le but est d’être le premier pour rafler la mise et obtenir une situation de quasi-monopole. Seul moyen de dégager une rentabilité à terme. Ralentir ne fait donc pas partie du vocabulaire de ces entreprises et tout ce que ce nouvel algorithme de compression va faire est de leur donner envie d’investir encore plus. Si la mémoire de session est divisée par six, alors autant coller plus de processeurs pour augmenter la capacité de calcul et remplir l’espace libéré par TurboQuant. Histoire de tirer un avantage concurrentiel immédiat face aux autres IA.

Ces entreprises ont sécurisé des téraoctets de mémoire vive au prix fort et ont désormais la possibilité d’y accoler plus de stockage et de processeurs, mon humble avis est que c’est ce qu’elles vont faire. Non pas chercher à réduire la voilure en consommant moins de mémoire vive de session mais bien augmenter celle-ci en déployant plus de serveurs. Et qui dit plus de sessions et de serveurs dit également plus de besoins en mémoire globale…

Les autres sujets de Minimachines autour de la crise de la mémoire vive.

En illustration, un kit de mémoire vive de 2 x 64 Go de DDR5-8000 G.Skill Trident Z5 Royal NEO avec une finition dorée et de faux cristaux illuminés de LEDS RGB…

Une stabilisation de la mémoire vive plutôt qu’une baisse © MiniMachines.net. 2026

Read more of this story at Slashdot.

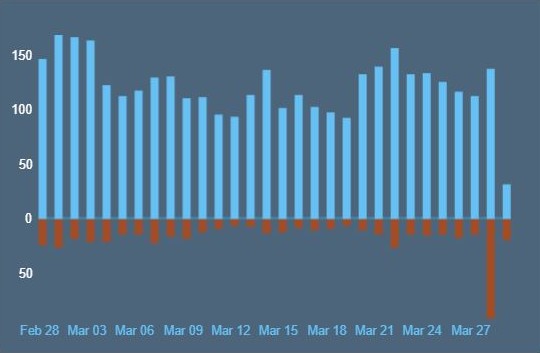

Les hausses se succèdent et l’annonce d’Intel la semaine passée est désormais reprise par AMD qui indique vouloir augmenter de 15% le prix de ses puces par rapport à l’année 2025.

Augmenter de 15% ne signifiera pas que les puces commercialisées par AMD seront vendues au détail seulement 15% plus chères. Cette augmentation aura sans doute de multiples effets en cascade. Il s’agit du prix de vente conseillé par AMD mais lors de ce genre de scénario, les relevés en magasin sont toujours assez spectaculairement plus élevés. Notamment parce que les grossistes ne changent pas forcément l’enveloppe attribuée à l’achat de puces. Avec 15% de hausse c’est 15% de puces en moins et donc moins de processeurs distribués aux détaillants. Là encore, ceux qui mettront le plus sur la table ou feront la plus grosse commande seront livrés et avec moins d’offres, les prix vont également évoluer.

Un des principaux effets de bord de cette crise des composants actuellement est que les clients retiennent leurs investissements. Entre la mémoire vive, les processeurs et le reste, les prix ont largement explosé. Autre problème, la rareté de certains produits comme la mémoire rend beaucoup d’investissements impossibles. Ce qui fait plonger de manière assez abrupte les ventes de matériel.

Les intégrateurs comme Lenovo, HP, Dell et autres vont voir leurs notes augmenter dans une même mesure tout en faisant face à une baisse de leurs ventes, ce qui va les pousser à vouloir compenser l’érosion de leur chiffre d’affaires. Non seulement les puces directement vendues en magasin vont être plus chères, mais même les machines type portables ou autres PC de bureau prémontés vont se retrouver largement au-delà des prix de 2025. Pour un acheteur, cela veut donc dire qu’il faut assumer la hausse de la mémoire vive du stockage et du processeur en plus de la hausse des coûts de transport qui vont commencer à se faire sentir avec la guerre en Iran. La note finale sur l’achat d’une machine complète sera sévère comparée à celle de 2025.

Dès la fin du mois, les tarifs d’Intel et AMD vont donc augmenter. Les délais vont également se rallonger alors que l’accent de la production des deux fabricants se réoriente toujours plus vers le monde des serveurs. On comptait une à deux semaines de délai entre la commande et la réception d’un lot de processeurs à la même période en 2025. Aujourd’hui, il faut compter sur dix à douze semaines pour le même résultat. Un délai devenu incompressible et très problématique pour les fabricants qui doivent désormais faire des paris impossibles.

Imaginez-vous devoir lancer un produit pour la rentrée des classes de septembre. En commandant des processeurs en avril, vous les recevrez en juin. Il ne vous restera que juillet et aout pour réunir les pièces, lancer la production, tester, emballer, expédier et distribuer les matériels aux détaillants. Les machines prêtes à être expédiées pour le début septembre commencent en général à être stockées chez les revendeurs dès le début du mois d’août et au pire au 15 du mois. Beaucoup d’achats sont faits pendant les courses de rentrée avec les fournitures scolaires. Cela ne laisse donc que juin et juillet pour fabriquer. Et encore, on ne compte que sur juillet que si on accepte un transport rapide par avion. Transport qui fait encore augmenter le prix des machines…

Ajoutez à cela le risque de mal se positionner niveau tarif. Si vous voulez développer un ordinateur portable pour dans 12 semaines, il faut anticiper le prix de la mémoire vive et du stockage pour cette période. Ce qui est en ce moment absolument impossible. Acheter avant une baisse de prix de la mémoire disqualifierait votre matériel, mais commander la mémoire aujourd’hui en pariant qu’elle montera encore dans les 12 semaines qui viennent est également très risqué.

Sur le marché des MiniPC, tout le monde fait grise mine. Les engins ont déjà beaucoup changé de prix. Mais aussi et surtout les composants les plus abordables ont quasiment disparu des catalogues. Impossible de mettre la main, même plus cher, sur des puces basiques chez AMD comme chez Intel. Certains se réfugient sur des puces alternatives, d’autres réduisent simplement la voilure de leurs commandes.

Et chaque semaine qui passe semble encore plus compliquer la situation.

Prix en hausse et disponibilité en baisse, le marché du processeur se complique

AMD va augmenter à son tour ses tarifs de 15% © MiniMachines.net. 2026

Dans un message publié sur Reddit, le traducteur du tchèque vers anglais qui a officié sur Kingdom Come: Deliverance 2 a annoncé s’être fait dégager comme un malpropre par la direction de Warhorse Studios. On lui aurait expliqué que son poste était devenu obsolète, et que pour « améliorer l’efficacité de l’entreprise » et « réaliser des économies », le studio allait désormais s’en remettre l’IA générative.

Une décision particulièrement ironique à la lecture des récents commentaires de Daniel Vávra, ancien directeur créatif du studio sur les deux Kingdom Come: Deliverance, qui se pignole régulièrement sur l’IA générative. Il écrivait notamment « et si cette IA tant décriée ne volait pas les emplois des développeurs, mais permettait au contraire à bien plus de gens de créer des jeux comme The Witcher 4 ? » Bon, il faut croire que pour son prochain jeu, Warhorse n’a donc pas décidé de créer un jeu comme The Witcher 4…

Read more of this story at Slashdot.

Read more of this story at Slashdot.

Cet article a été réalisé en collaboration avec Fortuneo

Connaissez-vous la World Elite CB Mastercard de Fortuneo ? Une carte bancaire haut de gamme proposée par une banque française. Mais la bonne surprise, c’est que cette carte est gratuite (sous conditions(1)).

Cet article a été réalisé en collaboration avec Fortuneo

Il s’agit d’un contenu créé par des rédacteurs indépendants au sein de l’entité Humanoid xp. L’équipe éditoriale de Numerama n’a pas participé à sa création. Nous nous engageons auprès de nos lecteurs pour que ces contenus soient intéressants, qualitatifs et correspondent à leurs intérêts.

Read more of this story at Slashdot.

L’appétit des datacenters liés au monde de l’IA est tellement vorace qu’il orchestre la production des processeurs. Intel a déjà prévenu, les prix partent à la hausse avec une augmentation annoncée de 10% de ses tarifs. Chez AMD même son de cloche, une augmentation des prix de ses puces serait en préparation.

Certains processeurs ne rentrent pas dans les MiniPC ou les portables.

La tension est très nette pour fournir suffisamment en processeurs les différents clients du marché mondial. Proposer assez de puces pour alimenter les serveurs liés à l’IA qui se construisent un peu partout sur la planète remplit un carnet de commandes déjà bien chargé. Cette exigence de livraison s’accompagne d’un atout majeur pour les serveurs : un carnet de chèques illimité. Pour être livré plus vite et sans interruption, les géants de l’IA sont prêts à payer le prix fort sans poser de questions. Encore une fois, comme pour la mémoire vive, personne ne pose la question de la rentabilité de ces investissements et les milliards coulent à flot.

En face, les constructeurs de PC qui doivent vendre leurs machines à des clients qui vont arbitrer leur achat, se retrouvent coincés. Ils ne peuvent pas payer une puce trop cher au risque de se retrouver avec un ordinateur invendable. Avec d’un côté un marché IA qui demande de plus en plus de wafers et de l’autre un marché de PC traditionnel qui fait la « fine bouche » en n’acceptant pas toutes les hausses de prix, le jeu de dominos s’enclenche dans le sens des premiers.

Cela parait peu de prime abord, mais 10% de hausse en sortie d’usine, c’est un impact important une fois en magasin. Un portable qui voit sa puce passer de 100 à 110$ à l’achat n’aura pas que 10$ de surplus une fois en rayon. D’abord ces 10% s’ajoutent aux autres augmentations de tarifs qui sont déjà là. La mémoire vive qui a explosé. Le stockage. Mais également le transport et la fabrication qui sont indexés au coût de l’énergie. L’ensemble de ce prix en pleine ascension est ensuite lui-même augmenté de la marge des différents acteurs qui ne fait pas dans la dentelle et qui additionne son propre pourcentage aux précédents. Avant que, bien entendu, les diverses taxes comme la TVA en rajoutent une couche. Le prix final des PC pour le reste de l’année 2026 risque donc d’être fort désagréable.

Vous l’avez sûrement remarqué, les tensions actuelles ne concernent pas que le tarif des processeurs. Certaines gammes sont clairement plus difficiles à obtenir et c’est notamment le cas de l’entrée de gamme. Chez AMD comme chez Intel, certaines références de puces n’ont plus de visibilité me confient plusieurs sources. Impossible de mettre la main sur certains modèles. D’autres sont disponibles si on les commande en quantité et à condition de patienter plusieurs mois avant de les obtenir. De quelques semaines de délais, on est désormais passé à plus de dix.

Un délai à rallonge qui complique encore les choses car de nombreux fabricants, gros ou petits, ne savent pas quel sera le prix de la mémoire et du stockage à l’horizon de deux mois et demi. Un vrai casse-tête pour construire ses gammes.

Quelques exemples ? Je vois ressurgir des puces étranges sur le marché des MiniPC et des portables. Si les géants du secteur ont toujours du stock, les plus petits acteurs sont obligés de fabriquer au fil de l’eau. On voit ainsi des puces AMD industrielles débarquer sur le segment du MiniPC noname. Les Ryzen V2000 par exemple. Des sauts de puces sont également faits à reculons avec des Ryzen Zen3 et même Zen2 qui reviennent sur le devant de la scène dans de « nouveaux » modèles de MiniPC.

Chez Intel même topo, les processeurs Alder Lake-N ont quasiment disparu de la circulation mais il est également difficile de trouver des Twin Lake. Les fonds de tiroir font encore un peu illusion mais plus aucune machine n’est fabriquée en quantité avec ces puces. À tel point qu’on voit ressurgir dans des MiniPC en 2026 des dinosaures. Des processeurs vieux d’il y a six ans comme les Pentium Gold de génération Tiger Lake que l’on pensait à jamais disparus.

Cela amène à une situation délétère pour le marché. D’un côté les serveurs achètent du haut de gamme à tous les prix. Ils augmentent donc les marges d’AMD et Intel sans discontinuer et se pressent pour obtenir leurs processeurs. La moindre disponibilité sur les chaînes de fabrication leur est donc désormais réservée. De l’autre, les fabricants de PC récoltent des miettes de disponibilité et négocient leurs prix. Ce qui n’amène pas les fondeurs à leur faire de cadeaux. Avec des PC dont les prix s’envolent malgré des composants en nette baisse, le public boude et les ventes baissent. Les mois passant, les marques de PC revoient leurs estimations à la baisse et les commandes de puces sont également ajustées… Ce qui libère plus de disponibilité pour les serveurs. La boucle est bouclée.

Difficile de voir une issue positive à ce scénario pour 2026 ainsi que les années à venir. La mémoire, le stockage, les processeurs et l’énergie… Tout part à la hausse sans discontinuer. Les prix vont exploser en magasin sans laisser réellement le temps au public de s’y acclimater. « Ça va trop vite » m’expliquait un responsable de marque. « Le public n’a pas eu le temps d’absorber la hausse des prix qu’on parle déjà de la suivante. »

La fin des années 2020 risque d’être une période noire pour tout le secteur informatique grand public. À part peut-être pour Apple qui risque de rafler la mise avec un MacBook Neo qui pourrait se transformer en bouée de sauvetage pour de nombreuses personnes.

Prix en hausse et disponibilité en baisse, le marché du processeur se complique © MiniMachines.net. 2026

Sans surprise, la voiture 100 % électrique co-créée par Sony et Honda ne verra pas le jour. Les deux entreprises ont annoncé l'annulation du projet.

Un peu plus d'un an après avoir lancé Sora, son modèle pour générer des vidéos intégré à une application dédiée, OpenAI annonce renoncer à la technologie, qui va même perdre son API. L'entreprise semble vouloir se reconcentrer sur ChatGPT et réduire ses coûts d'exploitation.

Read more of this story at Slashdot.

Malgré un démarrage record avec 17,37 millions de ventes en 7 mois, Nintendo observerait actuellement une baisse de la demande pour sa dernière console. Selon Bloomberg, l'entreprise a diminué la production de nouvelles Switch 2 de 30 %.

Il y a quelques jours, Monsieur S.Y. Hsu, un des principaux dirigeants d’Asus, expliquait que l’annonce du MacBook Neo était un véritable choc. En pleine crise des composants, avec une mémoire vive inaccessible et des hausses de prix en cascade, de nombreux autres acteurs du monde PC ont réagi de la même manière. Si seul un dirigeant d’Asus en a fait l’écho dans les médias, toutes les bases de toute la galaxie PC historique ont tremblé.

« Historiquement, Apple a toujours été positionné sur des prix élevés. Proposer un produit aussi abordable est un choc pour toute l’industrie. » S.Y. Hsu. Asus.

Tout le monde savait qu’Apple préparait un ordinateur « abordable ». La rumeur courait depuis plusieurs trimestres et de nombreuses fuites avaient déjà éventé la surprise. La seule inconnue, je devrais dire le seul espoir, que partageaient encore les industriels du monde PC, était le positionnement de gamme de cet engin. L’annonce d’un MacBook Neo à 599€ pour les étudiants et 699€ pour monsieur tout le monde a finalement été brutale. Ce portable se positionne sur l’entrée de gamme est le seul véritable élément de surprise qui tenait encore un peu la route au moment de l’annonce. Beaucoup d’acteurs espéraient encore une solution de gamme supérieure quelque peu bradée par Apple. Un portable qui aurait donné un peu plus de souffle au monde PC. Un monde qui ne sait plus vraiment comment répondre sur le terrain des machines les plus accessibles.

Ce choix d’Apple, porté sur l’entrée de gamme, fait donc grincer des dents. On n’a jamais vu un MacBook aussi peu cher. Ce choix tarifaire est précis, il n’est clairement pas né du hasard. Ce prix correspond à une tranche particulièrement visée par les constructeurs de PC classiques sous Windows. Il s’agit d’un budget d’entrée sur le marché. Celui que consentira un jeune couple qui s’installe. Un étudiant qui se lance dans un cursus de FAC ou d’école prépa. C’est également le montant accordé par beaucoup pour un achat informatique en général. C’est le « price point » des gens qui ont besoin d’un ordinateur mais qui ne s’intéressent pas spécialement à l’informatique. Autrement dit, un segment important du marché. Un segment qui peut potentiellement faire très mal aux concurrents sous Windows.

On comprend donc le désarroi des marques comme Asus qui, face à ce nouveau concurrent sur un segment épargné par l’ombre habituelle d’Apple, découvrent qu’ils ne sont plus à l’abri de sa concurrence. Qu’ils vont devoir faire au moins aussi bien, si ce n’est mieux. Et ça ne sera pas facile.

À gauche le EeePC de 2007. À droite le Macbook Neo de 2026

En 2007, j’étais encore dans le business, je vendais encore des PC. Je côtoyais alors les commerciaux des grandes marques de portables et leurs représentants. J’ai vécu la période de l’annonce des netbooks d’Asus. Ses fameux EeePC 701. Des engins qui se présentaient comme une alternative au monde portable traditionnel avec un tarif jamais vu alors de 299€. Chez les concurrents, j’ai vu passer toutes les étapes du deuil de leurs marges.

D’abord, le déni. Autour d’Asus5 beaucoup n’y ont pas réellement cru. Pendant longtemps, le concept de netbook est resté très nébuleux pour les autres constructeurs. Lorsque les EeePC ont été annoncés comme des prototypes, les responsables des autres marques n’ont pas voulu les voir comme des solutions réellement commerciales mais plutôt comme de la poudre aux yeux. Refusant simplement d’imaginer cette concurrence comme possible. Eux qui proposaient alors essentiellement des portables 15.6″ sous Windows deux à trois fois plus chers, ne pouvaient simplement pas croire qu’il soit commercialement viable de lancer un engin de 7 pouces sous Linux. Encore moins sous « Xandros ». Une distribution Linux totalement inconnue au bataillon. Le nombre de fois où j’ai entendu que le premier EeePC serait forcément un flop commercial s’il venait à sortir du simple fait qu’il ne soit pas livré sous Windows…

Il y a eu ensuite la colère. Je m’en souviens parfaitement parce qu’à l’époque, mon premier billet sur Blogeee.net était un paragraphe très sobre. J’annonçais juste qu’Asus France me confirmait la distribution du netbook dans l’hexagone. À la suite de cela, différents contacts professionnels m’ont demandé des informations. Le prix de l’engin les rendait tous malades. Le EeePC 701 était annoncé à 299€ TTC chez nous. Avec encore quelques traces de déni qui perduraient, j’entendais à cette annonce des responsables de gammes de PC pianoter sur leurs calculettes ou leurs clavier. Ils imaginaient l’impact d’un tel produit sur leurs propres ventes. Et, souvent, cela s’accompagnait d’une montée de colère. « Ils vont tuer le marché » était la remarque la plus courante. Avec un tel produit, Asus risquait de faire un mal profond au reste de l’industrie ainsi qu’à lui même. Un choix incompréhensible pour tous les autres acteurs car personne n’imaginait qu’Asus pourrait en tirer le moindre avantage.

La troisième étape a été une sorte de négociation technique. Du marchandage pour s’auto-réconforter et se rassurer pour l’avenir. Plusieurs marques essayaient de montrer combien il était plus intéressant de choisir leurs PC portables 15.6″ traditionnels, certes plus chers, mais ô combien plus compétents. Généralement, on cherchait à me rendre « rationnel » en mettant dans la balance la quantité de mémoire vive du EeePC. Sa capacité de stockage ridicule. Son écran « dépassé ». Son processeur « minable » ou… son absence de Windows. Un discours qui s’est poursuivi encore et encore pendant des mois. Même si pendant ce temps, les différents acteurs fourbissaient leurs réponses. Ils imaginaiejnt des portables classiques construits de manière à faire concurrence aux EeePC. Avec des prix qui baissaient mais également des capacités qui s’ajustaient pour tenter d’amortir le choc.

Lors de la sortie des tous premiers netbooks, cela a été électrique. Alors qu’Asus peinait à livrer assez d’engins pour faire face à l’énorme demande du public, alors que des forums se formaient pour indiquer aux autres internautes l’état des stocks des différents revendeurs… les constructeurs ne comprenaient plus. Ce succès a été « un vrai choc » pour certains qui ne vendaient plus grand-chose. La loi immuable des vases communicants reportant dans cet achat d’un netbook le budget normalement alloué pour un nouveau portable. Je me souviens d’un public chauffé à blanc. Tout le monde voulait voir la solution d’Asus. Toucher l’engin pour y croire. La presse ne parlait que des netbooks, la toile bruissait au son des EeePC. C’était la phase clairement dépressive de la concurrence. Dernière étape avant la conclusion de cette arrivée de la gamme EeePC sur le marché français : l’acceptation.

Une acceptation qui s’est finalement traduite par un geste simple : la copie. Les concurrents se sont tous mis à suivre l’exemple d’Asus. Acer en tête avec ses Aspire One avant d’être rapidement suivi par toutes les autres marques du marché : Dell, HP, Lenovo, MSI, Medion, Samsung… Tout le monde a fini par proposer des netbooks entre 299 et 399€. Le segment a rapidement basculé vers cette mode. En quelques trimestres, le marché du PC est passé de l’effarement général à l’embrassement pur et simple de cette nouvelle mode.

Le Macbook Neo d’Apple crée donc la surprise. C’est un « choc » pour l’industrie. Exactement comme les premiers netbooks ont été un choc pour les concurrents d’Asus. Comment réagir aujourd’hui alors qu’Apple va réussir à transformer un énorme problème en opportunité ? Peu de constructeurs ont la moindre idée de comment faire. Il faut dire que presque plus personne ne fait d’effort de réflexion autour des usages de leur public.

Asus est un bon exemple car la marque a eu des lueurs de génie par le passé. Je suis sincèrement admiratif de plusieurs de leurs idées. Celle du netbook par exemple. Un appareil qui nous parait aujourd’hui totalement désuet mais qui avait une énorme popularité alors. Pour plein de bonnes raisons. Parce qu’il répondait à des usages simples, à une curiosité et à des besoins qui naissaient. Asus a aussi été la marque capable de proposer des Transformer Book. Des engins qui ont, eux aussi, connu un énorme succès avec la même recette : un ordinateur abordable pour des utilisateurs qui n’en demandent pas plus.

Le point commun entre ces machines et le MacBook Neo est assez évident. Le succès est lié à une approche commune. Désosser la proposition classique d’un portable moderne et lui enlever les fioritures inutiles. Atteindre la proposition la plus stricte, l’usage élémentaire décrié par les experts mais réellement nécessaire au plus grand nombre. Éliminer le fantasme de la machine capable de tout faire pour se concentrer sur des compromis.

Le MacBook Neo apporte simplement l’essentiel des usages de l’informatique d’aujourd’hui dans un emballage séduisant. L’engin n’est pas parfait mais il va répondre aux besoins et aux questionnementx du grand public. Tout en effaçant la question habituelle du « meilleur choix » possible. Apple rassure, c’est une marque qui jouit d’un gros pouvoir de séduction. Transposez simplement la situation « ordinateur portable » vers d’autres gammes de produits et vous comprendrez le problème. Il y a toujours une marque qui dispose d’une aura particulière, d’une réputation qui fait consensus, qu’il s’agisse de lave-linge, de plomberie ou de champagne. Je suis certain que vous avez à l’esprit des références qui ont fait leurs preuves et qui satisferont tous ceux à qui vous les conseillerez.

Imaginez maintenant que la marque que vous aviez en tête lorsque je vous ai parlé de lave-linge propose désormais un produit efficace au prix des concurrents. Un truc simple, sans fonctions avancées généralement inutile mais qui se contente de faire son boulot bien et longtemps. Quel réflexe auriez-vous si on vous demandait conseil pour un achat ? C’est ce qu’on appelle un « No Brainer ». Un choix que l’on fait par réflexe sans faire appel très longtemps à son cerveau. Si un collègue ou un lointain cousin vous demande quel ordinateur acheter pour son entrée en FAC. Une solution simple pour suivre ses cours toute la journée ? Une demande ponctuée par le classique « J’y connais rien ». La meilleure réponse sera sans doute Apple et son MacBook Neo, surtout si vous êtes trop loin pour l’aider et vous en occuper. C’est exactement là dessus que compte Apple. Concentrer l’intérêt de sa marque sur ce nouveau segment. Là où des utilisateurs peu connaisseurs s’éparpillaient égarés entre quinze marques différentes de PC en errant dans les rayons d’un distributeur, le Neo sera un phare vers lequel tous les néophytes vont se tourner.

Les fabricants de PC sous Windows payent aujourd’hui leur manque flagrant d’intérêt pour les usages réels de leur clientèle. Ils payent également leur confiance aveugle dans un Microsoft complètement perdu. L’éditeur s’est rendu indispensable auprès de toutes les marque et les a conduit dans le mur. En proposant de cofinancer leur marketing, il a totalement transformé leur vision du marché. Aujourd’hui, les constructeurs de PC ne tentent plus de proposer des produits pour leurs utilisateurs. Ils essayent avant tout de rentrer dans les chaussures techniques imposées par Microsoft.

Cela fait maintenant plusieurs années que toute la production PC tourne autour de l’utilisation de Copilot, une IA locale dont tout le monde se fout. Microsoft a bien tenté de l’imposer au chausse pied à chaque utilisateur. En vain, Copilot avait 18.8% de parts de marché en juillet 2025. Un chiffre artificiellement gonflé par les abonnements gratuits liés à l’écosystème Windows. Il s’est réduit de 39% en quelques mois pour passer à 11.5% de parts de marché en janvier. Les chiffres sont terribles pour Microsoft . Avec un utilisateur qui n’a pas d’autres accès que Copilot comme IA, le taux d’adoption est de 68.8%. Mais dès que vous ajoutez ChatGPT dans la balance, cela tombe à 18%. Si vous additionnez Gemini au mix des choix possibles alors le choix de Copilot passe à 8%.

Avec un système qui permet de pousser en avant, souvent avec la même sollicitude qu’un gaveur d’oie, son IA vers 450 millions d’utilisateurs de Windows, Microsoft est encore à la traine. Seul un utilisateur sur 10 préfère le truc amené sur un plateau avec le système. La drôle d’impression de voir le match Internet Explorer, Chrome et Firefox se répéter encore et encore.

Le problème de cette politique c’est qu’elle a conduit les constructeurs de PC suivre aveuglément Microsoft dans son délire. Copilot par-ci, Copilot par là. Au fur et à mesure que le système d’exploitation se pourrissait de l’intérieur, les fabricants habitaient son cadavre. Tentant de faire croire à l’intérêt d’une offre IA dont ils justifiaient fort mal les usages. Entre le dégout de certains pour l’IA en général et la volonté d’un choix spécifique d’une IA indépendante qui fonctionne, l’effet sur le public a été dévastateur.

Depuis des années, on ne voit rien de véritablement pertinent se dégager de l’IA locale. Microsoft joue des coudes pour tenter de rattraper son retard sur les services concurrents. Imposant à tous une touche de clavier Copilot qui ne sert pourtant qu’à un utilisateur sur 10 dans le meilleur des cas. Windows exige désormais des fonctionnalités spécifiques avec des puces embarquant un NPU dont une minorité va se servir. Les utilisateurs se sont fait forcer la main sur des paris esthétiques d’interface et de design au dépend de leur véritable intérêt : impossible de trouver certaines diagonales avec une connectique classique. L’important est de proposer une ligne fine. Je ne parlerais pas de Windows 11 dont la qualité a baissé au fil des mois après avoir été imposé par Microsoft en mettant au rebut des machines encore fonctionnelles. Un système qui devient épouvantable, perclus de bugs, avec des menus illisibles et l’apparition de résultats plus publicitaires qu’utiles.

Alors oui, certains constructeurs proposent des nouveautés, des évolutions techniques. Mais ce sont souvent des effets de manche sans grand intérêt pour le public. Un écran qui se déroule ? Un pavé tactile un peu plus grand, la multiplication d’enceintes, l’apparition de LEDs de toutes les couleurs, en pagaille et même au dos des écrans de portable. Des fonctions biométriques en double, en triple même. La disparition des connecteurs du quotidien au profit de solutions peu utiles aux utilisateurs grand public. Qui en France sait réellement tirer parti d’un Wi-Fi7 ou d’un Ethernet 2.5 Gigabit ? Une minorité. Les lignes bougent beaucoup plus lentement que ce que le marché aime à nous faire croire.

Un gros bonbon rose

Se poser cinq minutes et se rendre compte que proposer un engin sobre et efficace, construit autour d’usages réels, semble être devenu impossible. Il faut de l’IA. Il faut des fonctions gadget. Il faut de l’esbrouffe et des LEDs parce qu’il semble impossible de réinventer la roue. Puisqu’on ne peut pas techniquement faire mieux que les concurrents en se battant avec les mêmes armes alors on va travailler sur d’autres sujets. Le pari fait par Asus en 2007 avec le Netbook était de se dire : « construisons un PC qui réponde à quelques usages précis et utiles identifiés dans ceux du grand public. » Du traitement de texte, de la navigation Web, des e-mails et quelques autres trucs multimédia. Rien d’autre.

Le MacBook Neo répond aux mêmes besoins, mis à jour à la sauce 2026. Que fait un utilisateur lambda avec un ordinateur personnel aujourd’hui ? Du web, des emails, des travaux bureautiques et du multimédia. La marque a évidemment ajouté à cette base les éléments modernes nécessaires tout en collant aux usages promis par son système d’exploitation. Les outils fournis par défaut par Apple pour gérer la vidéo UltraHD, fabriquer de la musique, dessiner, retoucher, apprendre, créer, tous sont là et la puce embarquée saura les piloter sans problème.

On me parle d’un écran au rabais. Je ne sais pas dans quel monde les gens qui disent cela vivent. Regardez la tête des PC portables à ce niveau de prix. Certains ont une dalle OLED mais au détriment de tout le reste de la machine. Ceux qui proposent un tout assez homogène et qualitatif n’ont pas d’écran haut de gamme, loin de là. Il est certain que le Neo sera moins bien loti qu’un Macbook Air ou Pro niveau qualité d’affichage. Mais est-ce une surprise ? Et surtout, est-ce que l’écran « au rabais » sera moins bon ? Non, il sera parfait pour tous les usages visés. Encore une fois, Apple ne promet pas une machine de travail professionelle.

On me parle d’absence de clavier rétro-éclairé. De mémoire trop limitée. D’écran qui ne propose pas du 240 Hz. De l’impossibilité de lancer des jeux 3D modernes, de Chromebooks bien moins cher, de connectique limitée… Si ce dernier point est vrai, le reste m’apparâit à des années lumière des usages réels du grand public. Monsieur et madame Toutlemonde qui entrent dans un magasin d’info. Une de ces enseignes de Zone Commerciale qui propose d’un côté des grilles pain et de l’autre des PC, ne vont pas chercher des machines capables de faire x milliers de points à un benchmarks. Pas plus qu’ils ne s’intéressent à la présence d’un clavier RGB ou un Wi-Fi7. Leur principal objectif est d’avoir une machine solide, rassurante et pas trop compliquée à comprendre pour un budget ferme. Le Neo y répond admirablement bien là où la concurrence a bien du mal à mettre en avant son offre. C’est pour cela que c’est un choc.

Un MacBook Neo très réparable selon iFixit

Évidemment, la situation de ces derniers mois est compliquée pour les fabricants de PC qui ne savent pas comment se sortir de la situation actuelle. La pénurie de composants, l’augmentation généralisée des tarifs. Tout cela crée de nombreux problèmes pour un marché en pleine panique.

Et c’est bien tout le souci aujourd’hui. Parce qu’Apple est en train de transformer ce qui aurait dû être un véritable cauchemar en une réussite marketing exemplaire. Il y a quelques semaines vous avez pu lire dans la presse des titres évoquant un Apple aux abois face à un Samsung qui faisait de bonnes affaires. La marque à la pomme aurait accepté de payer le prix demandé par Samsung pour sa mémoire vive. Sans marchander et sans sourciller.

Contrairement aux autres fabricants, Apple a dans ses coffres une fortune colossale. Réellement colossale. Et la marque s’est servi de cette fortune pour assurer sa production. Elle l’a certes payée cher, très cher auprès de Samsung mais elle a assuré une disponibilité pour les mois à venir. Le fabricant ne manquera pas de mémoire vive pour ses smartphones, ses tablettes et ses PC.

Il est évident qu’Apple ne gagnera pas autant d’argent avec son MacBook Neo dans les mois qui viennent qu’avec les autres portables de sa gamme. Mais une chose est sûre, la marque va proposer un nouveau standard de prix et de fonctionnalités. Un standard qui sera fiable et efficace et face auquel les constructeurs de PC vont devoir se mesurer.

Asus est désemparé parce qu’il se retrouve comme ses concurrents. Face à une offre ayant une grosse popularité à un prix plancher. Un ordinateur qui fera le boulot avec un matériel interne déjà amorti, un système optimisé par Apple, indépendamment d’un éditeur tiers. Et comment faire face ? Microsoft commence tout juste à réagir en annonçant se pencher sur le chantier de la gourmandise en mémoire de Windows 11. En se demandant enfin si le gavage de l’utilisateur à coup de Copilot était une bonne idée. Cela fait des années que les constructeurs de PC ne pensent qu’en augmentant la performance de leur machines pour justifier des tarifs qui ne bougent pas. Comme si on avait besoin chaque année d’alourdir un marteau pour enfoncer le même clou. Apple les prend à revers avec un produit plus accessible et tout le monde panique.

Que va faire Apple avec le MacBook Neo ? D’abord faire connaître MacOS à une toute nouvelle génération d’utilisateurs. Jeunes actifs, professionnels ayant besoin d’une machine pour des usages simples, étudiants, lycéens, propriétaires d’un iPhone, utilisateurs de la marque à la recherche d’une machine de voyage. Une véritable moisson de gens qui vont découvrir ou redécouvrir MacOS sur un engin fiable pendant les prochaines années. L’engin est clairement un produit d’appel, facilement réparable et il jouera pour la marque le rôle d’une campagne de communication. Neo veut dire nouveau et il faut bien le comprendre comme « nouveau client » et pas comme « nouveau portable.

L’engin ne sera pas qu’un VRP pour le système d’Apple, ce sera également un étrier pour s’engager plus fermement dans son ecosystème. Si une formation initiale est faite sur un OS, il est toujours difficile d’en changer ensuite. Les premiers pas sur un Neo conduiront sans doute à un Air ou un Pro. L’important ici est de faire adopter MacOS.

Pendant que l’industrie du PC cherchera peut être enfin a proposer des ordinateurs orientés vers de vrais usages et pas sur des idées fantasmées d’IA ou de débauche de gigahertz, pendant que Microsoft fera pénitence sur ses errements copilotés, pendant que la mémoire vive et le stockage continueront d’assécher le marché, Apple va ratisser de nouveaux clients. Et avec ce prix d’appel, la marque va ratisser très large… Jusqu’à la probable apparition d’un Neo de seconde génération.

Asus et les fabricants de PC, les yeux pris dans les phares du Macbook Neo © MiniMachines.net. 2026