AI Act : l’Union européenne accorde un répit aux industriels

Un omnibus qui roule pour l'industrie de l'IA

Un pas en avant, deux pas en arrière. La mise en œuvre des mesures inscrites dans l’AI Act européen continue de danser la gigue, avec le report de plusieurs dispositifs ; en revanche, les protections contre les deepfakes non consensuels et les apps permettant de dénuder des personnes sont renforcées.

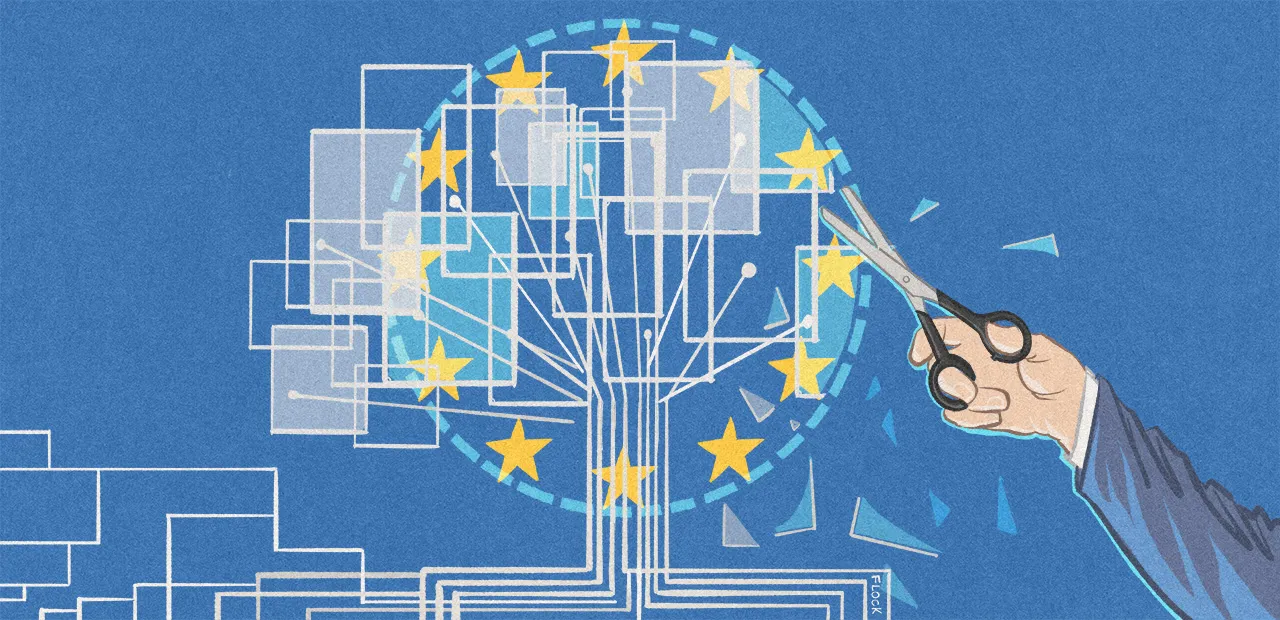

L’AI Act est entré en application en février 2025. Son objectif : « promouvoir l’adoption d’une IA axée sur l’humain et digne de confiance ». Difficile de s’opposer à une telle lettre de mission, mais la portée et la mise en œuvre des différents dispositifs du texte européen restent sujettes à modification… et même à des reculs.

Le Parlement européen et le Conseil de l’UE sont ainsi tombés d’accord sur l’omnibus dédié au numérique proposé par la Commission européenne en novembre dernier. Il a pour objet de « simplifier » les régulations pesant sur les entreprises. Plusieurs mesures, qui concernent l’implémentation du règlement sur l’IA, auraient été influencées par des « oligarques de la tech », comme le dénonçaient en début d’année des organisations spécialisées dans la surveillance des lobbies.

Le calendrier de l’AI Act bousculé

L’accord annoncé ce jeudi 7 mai modifie deux dates limites. Les règles applicables aux systèmes d’IA utilisés dans les domaines à haut risque (biométrie, infrastructures critiques, éducation, emploi, migration, droit d’asile, contrôle aux frontières) entreront en vigueur à compter du 2 décembre 2027. Soit 16 mois de délai, puisque la précédente date avait été fixée au 2 août 2026. Quant aux systèmes intégrés dans des appareils comme des jouets ou des ascenseurs, les règles ne s’appliqueront qu’à compter du 2 août 2028.

« Ce calendrier progressif doit permettre de s’assurer que les normes techniques et les autres outils d’accompagnement seront en place avant l’entrée en application des règles », écrit la Commission. Pas question de parler de reculade, Bruxelles cherche plutôt à faire valoir son pragmatisme : « Avec des règles plus simples et plus favorables à l’innovation, nous facilitons l’innovation sans abaisser les exigences en matière de sécurité », affirme ainsi Henna Virkkunen, vice-présidente de la Commission en charge de la Souveraineté technologique.

De nombreuses entreprises du secteur font pression sur l’exécutif européen pour adoucir l’AI Act, en particulier face aux États-Unis et à la Chine qui avancent très rapidement. Le 4 mai, en plein débat sur l’omnibus, Airbus, Mistral AI, Nokia ou encore ASML ont ainsi signé une lettre ouverte (une de plus) déplorant « des règles étouffantes, inutilement complexes et souvent redondantes, qui rendent extrêmement difficile le fait de suivre le rythme des avancées technologiques ».

Dont acte : en plus de ces reports, l’accord prévoit également « des règles simplifiées et une gouvernance plus claire ». Des avantages accordés à des PME vont s’étendre aux entreprises de taille intermédiaire. Des clarifications ont été apportées sur l’articulation entre l’AI Act et d’autres législations européennes sur la sécurité des produits afin d’éviter les doublons. Les fournisseurs d’IA auront accès à des « bacs à sable » réglementaires pour tester leurs solutions.

Les instances européennes en ont également profité pour intégrer des renforcements de la protection contre les apps de deepfakes non consensuels : l’accord interdit ainsi les systèmes IA qui génèrent du contenu à caractère sexuel explicite sans consentement et des images sexualisées d’enfants. Une réponse aux exactions de Grok en début d’année.

Dans le détail, cette interdiction s’appliquera à la mise sur le marché de systèmes IA ayant pour but de créer de tels contenus, ou qui n’ont pas mis en place de mesures de sécurité pour empêcher la création de ce type de contenus. Les entreprises auront jusqu’au 2 décembre 2026 pour se mettre en conformité.

La loi retarde également l’application des obligations de marquage numérique (« watermarking» en VO) des contenus générés par l’IA au 2 décembre 2026 (au lieu du 2 février 2027, comme le prévoyait la proposition de la Commission, et du 2 août 2026 comme initialement adopté dans l’AI Act), censées permettre de détecter et de retracer les contenus générés par IA.

Il reste désormais au Parlement européen et au Conseil d’adopter formellement cet accord, ce qui devrait être fait avant le 2 août.